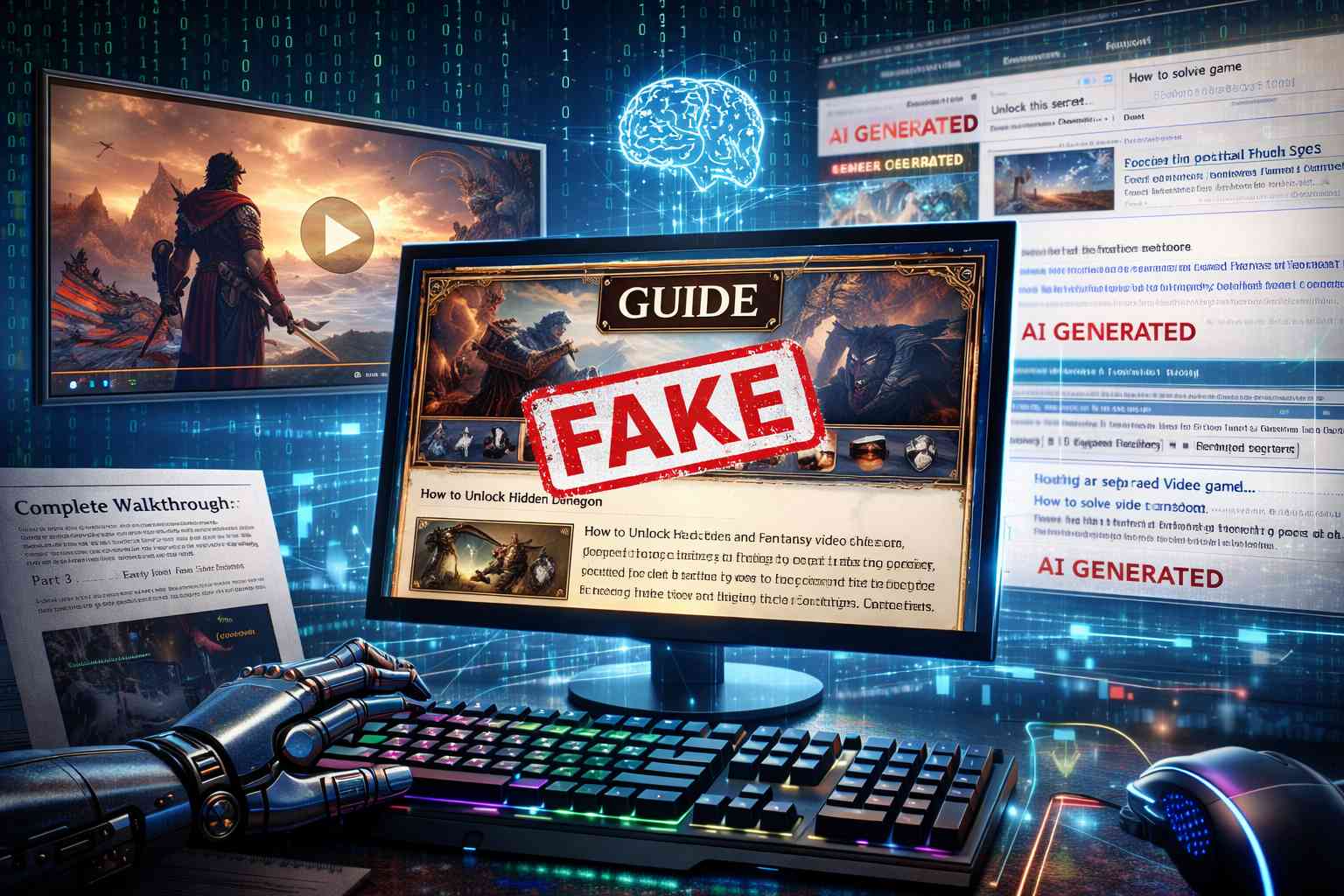

Il settore dell’editoria digitale specializzata nel gaming sta affrontando una trasformazione problematica legata alla diffusione massiva di contenuti generati da sistemi di intelligenza artificiale, che si manifesta in modo particolare nella pubblicazione prematura di guide strategiche per titoli non ancora disponibili sul mercato. Questo fenomeno tecnico poggia sull’utilizzo di Large Language Models addestrati per sintetizzare informazioni provenienti da dataset eterogenei, inclusi trailer, comunicati stampa e speculazioni della community, trasformandoli in testi che mimano la struttura di un tutorial professionale. La velocità di produzione di questi algoritmi permette a siti web a bassa autorevolezza di saturare i motori di ricerca con articoli ottimizzati per la SEO, intercettando il traffico organico degli utenti che cercano informazioni su meccaniche di gioco ancora coperte da segreto industriale o semplicemente non ancora implementate dagli sviluppatori.

Dal punto di vista dell’architettura dell’informazione, queste guide automatizzate presentano lacune tecniche profonde dovute alla natura probabilistica dei modelli GPT o simili. Poiché l’intelligenza artificiale non ha accesso diretto al codice del software né può effettuare sessioni di test empirico, il contenuto generato è spesso il risultato di un’allucinazione semantica o di una rielaborazione di dati obsoleti riferiti a capitoli precedenti della medesima saga. Il sistema identifica le parole chiave più rilevanti associate a un videogioco imminente e costruisce attorno ad esse istruzioni plausibili ma prive di fondamento tecnico, come spiegazioni su come sbloccare aree inesistenti o soluzioni a puzzle che non sono presenti nella versione definitiva del gioco. Questo processo di “scraping” e ricombinazione testuale avviene in frazioni di secondo, permettendo la creazione di interi portali dedicati alla guida strategica che precedono di settimane il lancio ufficiale del prodotto.

L’impatto di questa pratica sulla qualità dell’informazione digitale è significativo, poiché altera l’accuratezza dei risultati di ricerca e penalizza il giornalismo tecnico basato sull’esperienza diretta. Quando un utente interagisce con queste guide fasulle, si trova di fronte a un paradosso informativo in cui la forma del testo appare professionale e analitica, ma la sostanza tecnica è nulla. Questa dinamica è alimentata da algoritmi di indicizzazione che, in assenza di contenuti reali prodotti da umani (i quali devono attendere la pubblicazione del gioco per scrivere), privilegiano la freschezza del dato e la pertinenza delle parole chiave, premiando involontariamente le fabbriche di contenuti AI. La mancanza di una verifica umana nel ciclo di pubblicazione di questi siti rende difficile per i lettori meno esperti distinguere tra una procedura tecnica verificata e una sequenza di istruzioni generate casualmente per scopi puramente pubblicitari.

La sfida per il futuro dell’informazione videoludica risiede dunque nella capacità dei motori di ricerca di implementare filtri di qualità capaci di distinguere la competenza derivata dall’interazione uomo-macchina (il gioco giocato) dalla semplice elaborazione linguistica. Mentre l’intelligenza artificiale può essere uno strumento prezioso per la traduzione o la sintesi di note tecniche reali, il suo utilizzo per l’invenzione di procedure operative su software non ancora rilasciati rappresenta una deriva tecnologica che mette a rischio l’affidabilità dei database di conoscenza collettiva. Il settore si trova ora costretto a sviluppare nuovi standard di certificazione per i contenuti editoriali, dove la prova della prova — ovvero la dimostrazione che una guida è stata scritta sulla base di un’esperienza di gioco effettiva — diventerà il principale criterio di valore per contrastare l’inflazione di testi sintetici privi di utilità pratica.