È come se il motore di ricerca si fosse tolto un velo: fino a poco tempo fa, Google restituiva risposte essenzialmente testuali — definizioni, link, brevi spiegazioni. Oggi, compie un passo decisivo verso un’esperienza più immersiva, visiva: introduce la modalità “AI Mode” con supporto alle risposte tramite immagini. In altre parole, quando cerchi qualcosa che può essere mostrato, non solo spiegato, Google non si limiterà più a parole, ma ti mostrerà esempi visivi, fotografie, schizzi: un’interazione che vuole assomigliare a “parlare con un amico che ti mostra le cose”, non solo ti dice.

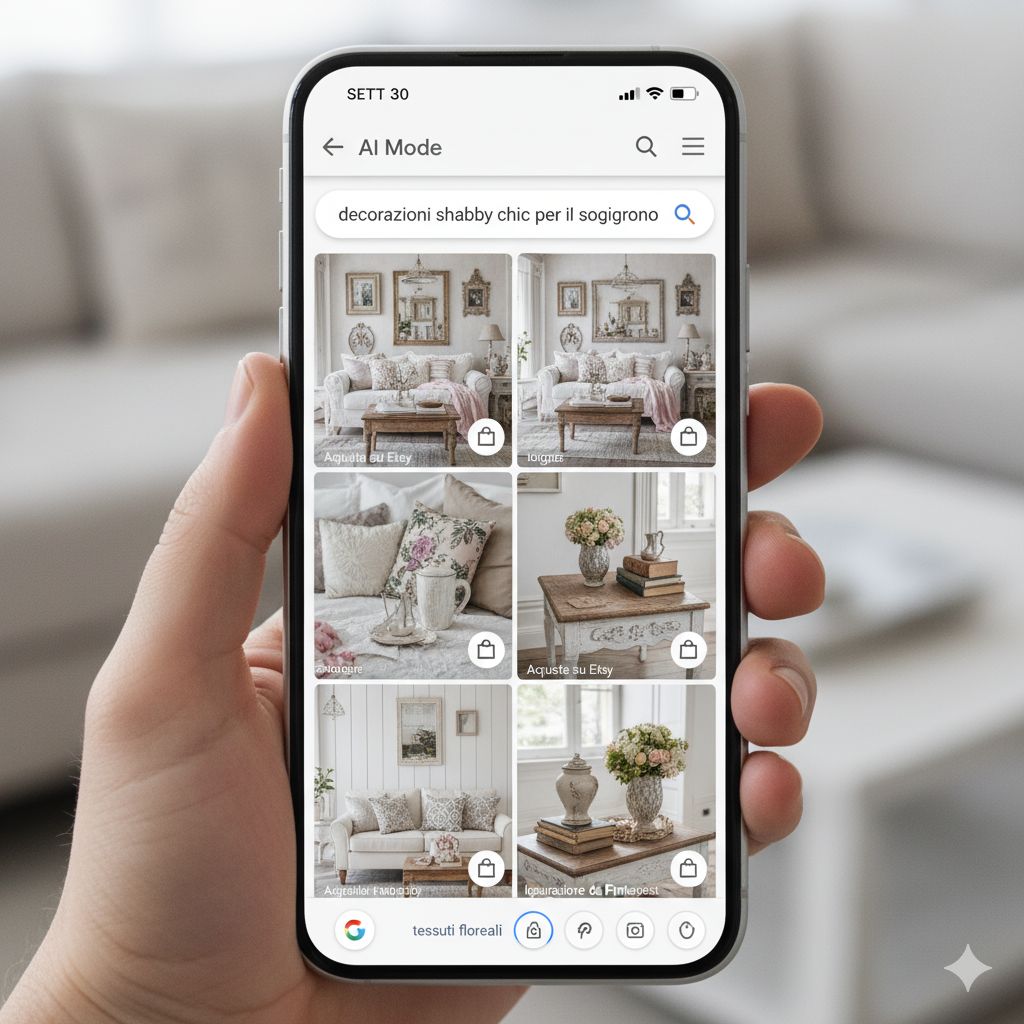

L’aggiornamento è stato annunciato da Google il 30 settembre (data locale), e parte negli Stati Uniti in inglese, con l’obiettivo di espandersi poi in altri Paesi e lingue. L’idea è che, in molti casi — pensate a “ispirazione per arredare una stanza”, “modelli di scarpe retrò”, “idee per outfit estivi” — è più utile vedere che leggere. Ora si potrà digitare richieste come “decorazioni shabby chic per il soggiorno” o “idee di giardini con piante grasse” e ottenere non solo una serie di risultati testuali, ma una galleria visiva correlata, affinabile con comandi successivi.

Questa modalità va oltre i classici filtri di ricerca per colore, forma o marca: combina immagine e linguaggio naturale. Puoi caricare una foto, o fare una richiesta vaga, e Google risponderà con immagini selezionate in base al contesto e all’intento percepito. Se vuoi, puoi poi affinare la ricerca con uno stile diverso, una texture più audace o un colore specifico, e il sistema risponderà adeguando la selezione visiva sul momento.

Dietro questa capacità intuitiva c’è una serie di tecnologie che lavorano insieme: il riconoscimento dell’immagine, sistemi di embedding visivi, ranking multimodale che combina segnali testuali e visivi, e meccanismi per integrare i risultati di ricerca classici con quelli visivi in modo coerente. Il tutto deve avvenire con latenza accettabile — non vorresti aspettare troppo quando digiti una domanda.

Un dettaglio interessante è che le immagini mostrate avranno link attivi: cioè, se un’immagine di sneakers ti colpisce, puoi cliccarla e arrivare direttamente al sito che la propone in vendita. In questo modo, Google intende non solo facilitare la scoperta visiva, ma anche abbreviare il percorso tra ispirazione e acquisto.

Inoltre, l’integrazione passa anche per tecnologie già conosciute come Google Lens: combinare riconoscimento dell’immagine con descrizione, estrazione di dettagli e suggerimenti correlati. Immagina di scattare la foto di un vaso antico: l’“AI Mode” potrà rispondere mostrandoti modelli simili, complementi in stile coerente, magari suggerendo dove acquistarlo o come abbinarlo all’arredamento.

Questa funzione non è un’aggiunta marginale: segna una tappa nella trasformazione stessa del motore di ricerca. Non più semplice mappatura tra domanda e sito, ma un dialogo visivo, che comprende quando “vedere” è preferibile a “leggere”. Mentre il riconoscimento vocale e i sistemi conversazionali (come i chatbot) hanno già aggiunto una dimensione “parlata” alla ricerca, adesso entra in gioco anche la dimensione “visiva integrata”.