La capacità di aggiornare correttamente le proprie conoscenze quando emergono nuove informazioni rappresenta uno dei problemi più complessi nello sviluppo dei sistemi di intelligenza artificiale basati su modelli linguistici di grandi dimensioni. Sebbene questi modelli abbiano dimostrato notevoli capacità nel generare testo e rispondere a domande, diversi studi recenti indicano che il loro comportamento nei contesti interattivi, dove le informazioni vengono fornite gradualmente, è ancora lontano dagli standard ideali definiti dalla teoria probabilistica. Una ricerca pubblicata da Google Research introduce un nuovo approccio denominato “Bayesian teaching”, progettato per insegnare ai modelli linguistici a ragionare in modo più simile ai sistemi bayesiani e ad aggiornare le proprie credenze in maniera più coerente quando ricevono nuovi dati.

Nel contesto dell’intelligenza artificiale, l’aggiornamento delle credenze si riferisce alla capacità di un sistema di modificare le proprie ipotesi o previsioni quando acquisisce nuove informazioni. Nei sistemi decisionali tradizionali, il modello matematico più noto per descrivere questo processo è l’inferenza bayesiana, una metodologia statistica che stabilisce come aggiornare una probabilità iniziale, chiamata “prior”, trasformandola in una nuova probabilità, detta “posterior”, alla luce di nuove evidenze. Questo principio è ampiamente utilizzato in campi come la statistica, la robotica e l’apprendimento automatico per modellare il modo in cui un agente razionale dovrebbe adattare le proprie convinzioni man mano che osserva nuovi dati.

I ricercatori di Google hanno osservato che i modelli linguistici contemporanei, nonostante le loro prestazioni elevate in molte attività, spesso non seguono questo comportamento ideale. In particolare, quando devono inferire preferenze o caratteristiche dell’utente attraverso più interazioni successive, tendono a stabilizzare rapidamente le proprie ipotesi e a non aggiornare in modo significativo le proprie previsioni dopo le prime informazioni ricevute. Questo fenomeno viene descritto come una sorta di “plateau decisionale”, in cui il modello smette di migliorare le proprie previsioni nonostante riceva ulteriori segnali informativi.

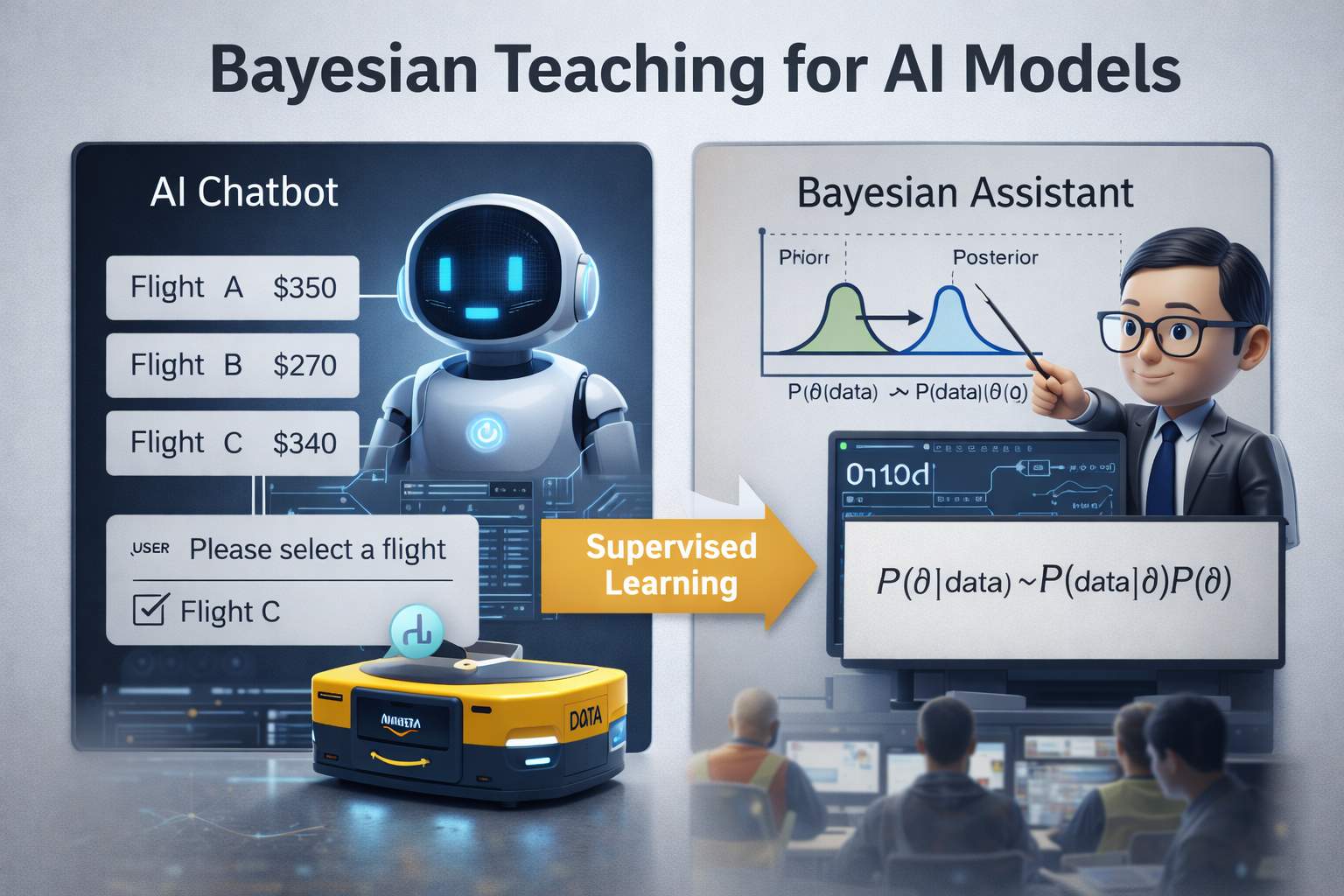

Per analizzare questa limitazione, i ricercatori hanno progettato una serie di esperimenti in cui diversi modelli linguistici dovevano svolgere compiti di raccomandazione basati su interazioni iterative con un utente simulato. Un esempio utilizzato nello studio riguarda un sistema di suggerimento di voli: il modello deve proporre una delle opzioni disponibili e, dopo ogni suggerimento, osserva quale scelta viene effettivamente effettuata dall’utente. Sulla base di queste scelte successive, il sistema dovrebbe progressivamente inferire le preferenze dell’utente, ad esempio se privilegia il prezzo più basso, la durata del viaggio o la compagnia aerea.

I risultati iniziali hanno mostrato che i modelli linguistici standard non riescono a sfruttare pienamente queste informazioni sequenziali. Dopo la prima o la seconda interazione, le loro raccomandazioni tendono a stabilizzarsi e non migliorano significativamente con l’arrivo di ulteriori dati. Questo comportamento indica una limitata capacità di aggiornamento probabilistico delle credenze, una funzione che invece è fondamentale per qualsiasi sistema che operi in ambienti dinamici o interattivi.

Per affrontare questo problema, i ricercatori hanno introdotto la tecnica denominata “Bayesian teaching”. Invece di addestrare il modello direttamente sulle risposte corrette, il sistema viene fine-tuned osservando le interazioni tra un utente e un assistente basato su un modello bayesiano ottimale. Questo assistente, chiamato “Bayesian Assistant”, rappresenta il comportamento teoricamente ideale di un agente che aggiorna le proprie credenze seguendo rigorosamente le regole dell’inferenza bayesiana.

Durante l’addestramento, il modello linguistico non riceve semplicemente l’indicazione della risposta corretta, ma osserva il processo decisionale del sistema bayesiano mentre tenta di inferire le preferenze dell’utente. In alcuni casi l’assistente bayesiano formula anche ipotesi che si rivelano errate, specialmente nelle prime fasi dell’interazione quando l’incertezza è elevata. Tuttavia, queste ipotesi rappresentano comunque il miglior tentativo possibile sulla base delle informazioni disponibili in quel momento. Secondo i ricercatori, proprio questo comportamento probabilistico realistico costituisce un segnale di apprendimento più efficace rispetto a un sistema che fornisce sempre la risposta corretta.

I risultati degli esperimenti mostrano che i modelli linguistici addestrati con questa metodologia migliorano significativamente la propria capacità di aggiornare le credenze nel corso delle interazioni. Nei test condotti dai ricercatori, i modelli fine-tuned attraverso il Bayesian teaching hanno raggiunto livelli di accuratezza nelle raccomandazioni fino all’81%, mostrando un comportamento molto più vicino a quello del modello bayesiano teorico rispetto alle versioni standard dei modelli linguistici.

Un aspetto particolarmente interessante dello studio riguarda la capacità di generalizzazione. I modelli addestrati attraverso l’osservazione del comportamento bayesiano non migliorano solo nel compito specifico utilizzato per l’addestramento, ma dimostrano prestazioni superiori anche in compiti diversi che richiedono ragionamento probabilistico. Nei test condotti dai ricercatori, i modelli hanno mostrato miglioramenti anche in scenari come la raccomandazione di hotel e l’assistenza negli acquisti online, contesti più complessi e difficili da modellare con sistemi probabilistici espliciti.

Questo risultato suggerisce che i modelli linguistici possono apprendere strategie di ragionamento generale osservando sistemi simbolici o probabilistici più strutturati. In altre parole, invece di implementare direttamente complessi algoritmi bayesiani all’interno dei modelli neurali, è possibile insegnare ai modelli a imitare il comportamento di questi algoritmi attraverso tecniche di apprendimento supervisionato. Questo approccio rappresenta una forma di “distillazione del ragionamento”, in cui un sistema neurale apprende strategie decisionali osservando un modello teoricamente ottimale.

Le implicazioni di questa ricerca sono particolarmente rilevanti per lo sviluppo di sistemi AI destinati a interagire con gli utenti in modo continuativo. Applicazioni come assistenti digitali, sistemi di raccomandazione, agenti conversazionali e piattaforme di supporto decisionale richiedono infatti la capacità di costruire e aggiornare modelli delle preferenze e delle intenzioni degli utenti nel corso del tempo. Se i modelli linguistici riusciranno a incorporare in modo più efficace strategie di aggiornamento probabilistico, potrebbero diventare strumenti molto più affidabili in contesti in cui le decisioni devono essere adattate dinamicamente a informazioni incomplete o in evoluzione.

Il lavoro di Google Research evidenzia anche una tendenza crescente verso l’integrazione tra approcci simbolici e modelli neurali. L’idea di combinare modelli matematici strutturati con reti neurali profonde non è nuova, ma negli ultimi anni ha acquisito nuova rilevanza nel tentativo di migliorare le capacità di ragionamento dei sistemi generativi.

Il metodo del Bayesian teaching rappresenta un esempio concreto di questa convergenza tra paradigmi. Invece di scegliere tra modelli simbolici e modelli neurali, i ricercatori mostrano come sia possibile utilizzare il primo come guida per addestrare il secondo. Se questo approccio verrà esteso ad altri tipi di ragionamento, potrebbe contribuire a ridurre alcune delle principali limitazioni dei modelli linguistici attuali, avvicinandoli a sistemi di intelligenza artificiale capaci non solo di generare testo plausibile, ma anche di ragionare in modo più coerente e adattivo nel tempo.