L’integrazione dell’intelligenza artificiale nei servizi conversazionali sta portando le aziende tecnologiche ad affrontare responsabilità sempre più complesse, soprattutto quando i sistemi interagiscono con utenti in situazioni emotivamente critiche. Google ha annunciato l’introduzione di nuove funzionalità di supporto alla salute mentale nel proprio assistente AI Gemini, decisione maturata dopo il coinvolgimento dell’azienda in una causa legale collegata al suicidio di un utente. L’iniziativa rappresenta un passaggio significativo nell’evoluzione delle politiche di sicurezza dei modelli conversazionali, con l’obiettivo di rafforzare i meccanismi di protezione e prevenzione.

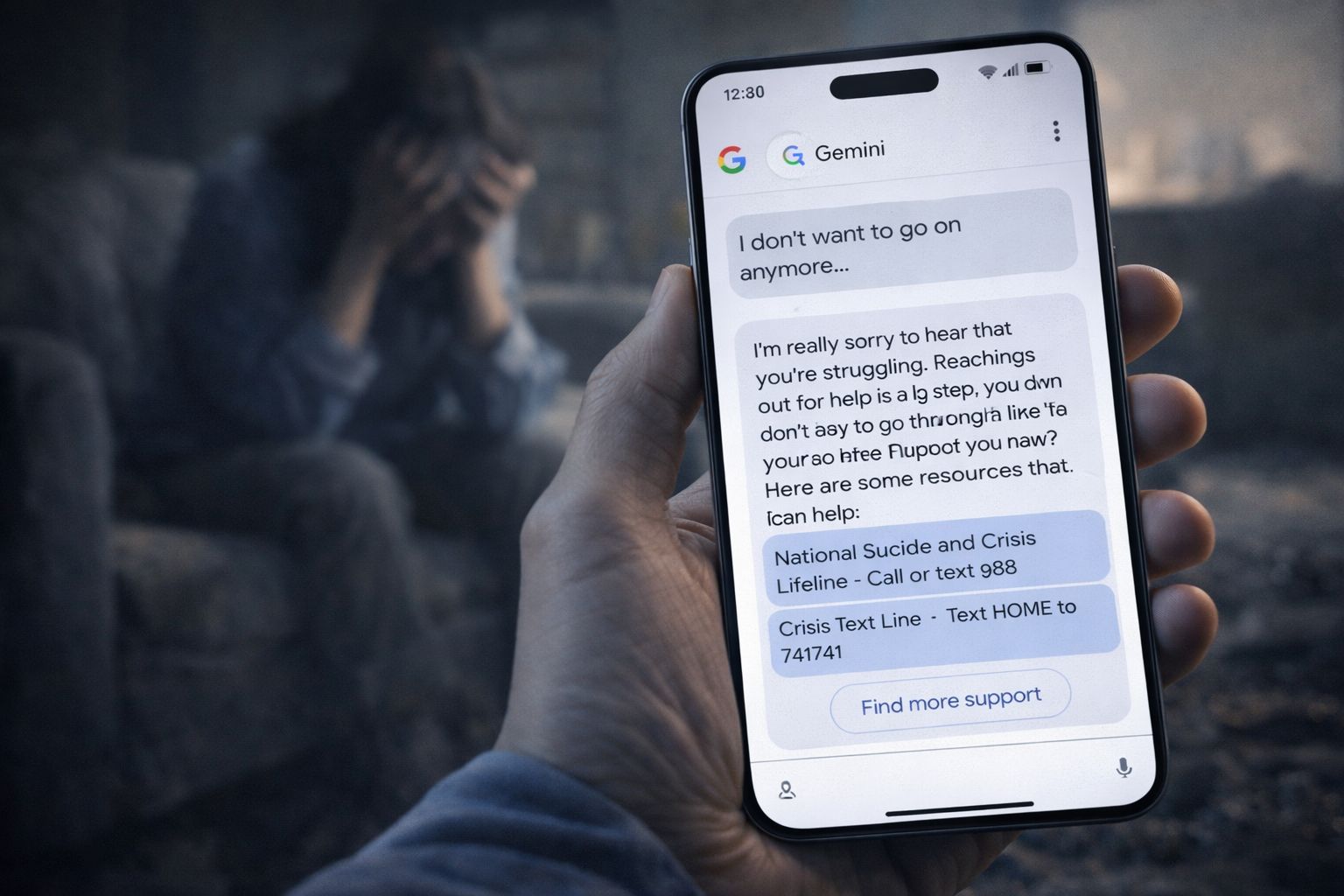

Google ha aggiornato Gemini introducendo strumenti progettati per riconoscere segnali di disagio psicologico nelle conversazioni e fornire risposte orientate al supporto. L’azienda ha spiegato che le modifiche sono state implementate dopo un contenzioso legale legato al comportamento del sistema in una situazione di rischio. L’obiettivo è rendere l’assistente più prudente e capace di indirizzare gli utenti verso risorse adeguate quando emergono contenuti sensibili o potenzialmente pericolosi.

L’aggiornamento si basa su un rafforzamento dei sistemi di rilevamento semantico. I modelli vengono addestrati a identificare espressioni linguistiche associate a stati emotivi critici, come ideazione suicidaria o forte distress psicologico. Quando il sistema rileva tali segnali, attiva risposte specifiche che privilegiano messaggi di supporto e suggeriscono il contatto con professionisti o linee di assistenza. Questo approccio mira a ridurre il rischio che l’AI fornisca risposte inappropriate o interpretabili come incoraggiamento a comportamenti dannosi.

L’introduzione di questi strumenti evidenzia una tendenza crescente nella progettazione delle AI conversazionali. I modelli non sono più valutati solo per accuratezza e utilità, ma anche per la capacità di gestire situazioni sensibili in modo responsabile. Questo implica l’integrazione di meccanismi di sicurezza multilivello, che includono filtri semantici, linee guida comportamentali e sistemi di escalation verso risorse esterne. In questo scenario, la sicurezza diventa parte integrante dell’architettura del modello.

Il contesto legale che ha preceduto l’aggiornamento ha contribuito a evidenziare le criticità legate all’uso dell’intelligenza artificiale in ambito emotivo. Le conversazioni con assistenti AI possono assumere un ruolo significativo per alcuni utenti, soprattutto in momenti di vulnerabilità. La possibilità che il sistema venga percepito come interlocutore empatico aumenta la necessità di garantire risposte prudenti e orientate alla sicurezza. L’adozione di strumenti dedicati alla salute mentale rappresenta quindi una risposta alle nuove responsabilità emergenti.

L’aggiornamento non introduce solo nuove risposte, ma modifica il comportamento complessivo del sistema. Gemini è ora progettato per evitare suggerimenti interpretati come soluzioni definitive a problemi personali e per promuovere invece il contatto con supporto umano qualificato. Questo cambiamento riflette un approccio più conservativo, in cui l’AI funge da ponte verso risorse professionali piuttosto che da sostituto del supporto umano.