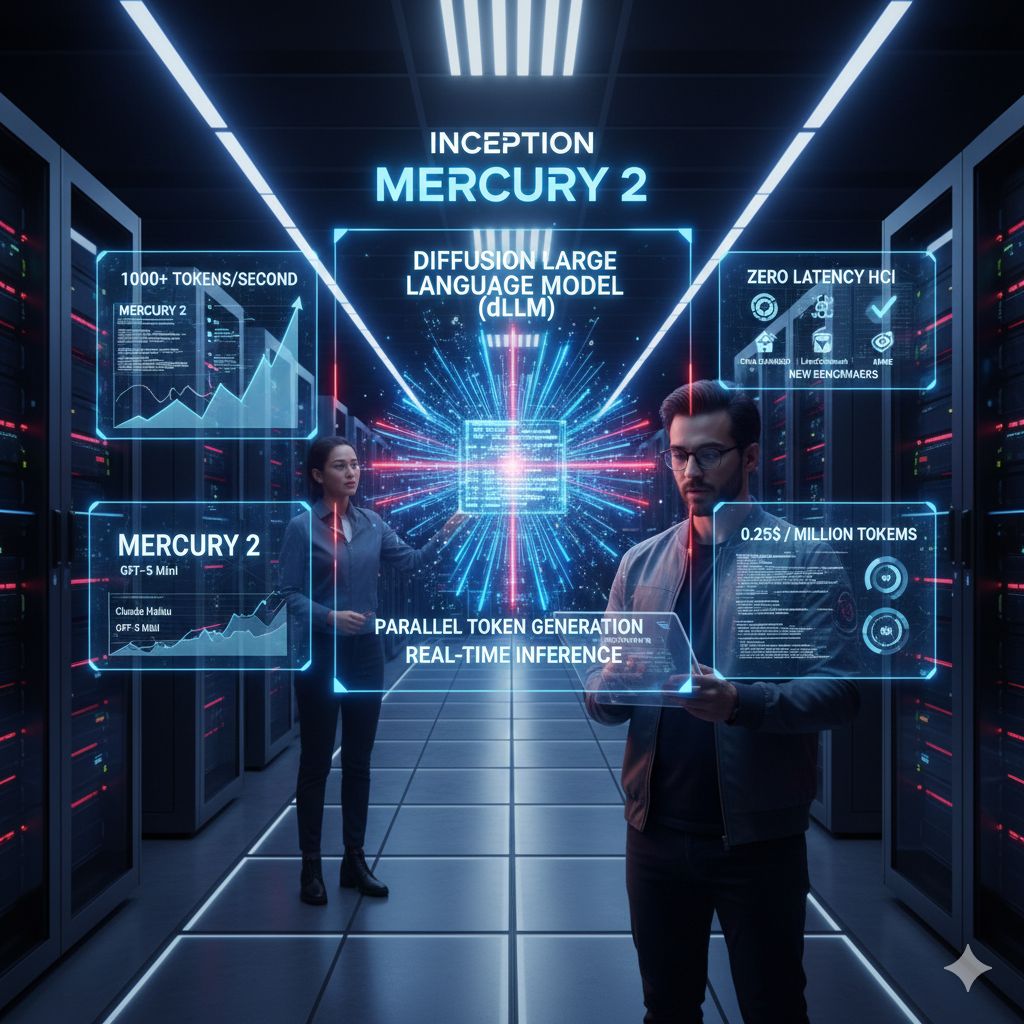

L’evoluzione delle architetture dei modelli linguistici di grandi dimensioni sta attraversando una fase di profonda trasformazione, segnata dal superamento dei limiti intrinseci dei sistemi autoregressivi tradizionali. In questo contesto, il rilascio di Mercury 2 da parte di Inception rappresenta una pietra miliare tecnologica, introducendo nel mercato enterprise il concetto di Diffusion Large Language Model (dLLM) applicato all’inferenza in tempo reale. A differenza dei modelli convenzionali, che generano i token in modo sequenziale uno dopo l’altro, la struttura a diffusione di Mercury 2 adotta un approccio radicalmente diverso, raffinando l’output attraverso processi paralleli che partono da approssimazioni rumorose. Questo cambio di paradigma architettonico permette di abbattere drasticamente i tempi di generazione, posizionando il modello come una soluzione di frontiera per tutte le applicazioni in cui la latenza rappresenta il principale collo di bottiglia operativo.

La superiorità tecnica di Mercury 2 emerge con chiarezza analizzando le prestazioni ottenute sull’infrastruttura hardware di ultima generazione, in particolare sui chip NVIDIA Blackwell. La piattaforma ha dimostrato la capacità di generare oltre mille token al secondo, una velocità che supera di oltre dieci volte quella dei modelli leader della concorrenza, come Claude Haiku 4.5 o GPT-5 Mini. Questa accelerazione non è semplicemente il frutto di una maggiore potenza di calcolo, ma deriva dall’efficienza algoritmica della struttura dLLM, che consente aggiornamenti paralleli dei token anziché una scansione lineare. Tale caratteristica rende Mercury 2 lo strumento ideale per flussi di lavoro ad alta intensità interattiva, come la programmazione assistita e l’editing in tempo reale, dove ogni minima interruzione o ritardo nella risposta può compromettere la concentrazione e la produttività dello sviluppatore.

Oltre alla pura velocità di output, l’innovazione di Inception si estende alla qualità del ragionamento e delle capacità analitiche. Nonostante la natura “leggera” associata alla velocità, Mercury 2 ha stabilito nuovi parametri di riferimento nei test GPQA-Diamond per il ragionamento logico, nel LiveCodeBench per la codifica e nell’AIME per le competenze matematiche, superando modelli di riferimento come Gemini 3 Flash e GPT-5 Nano. Questo equilibrio tra rapidità e intelligenza è particolarmente critico nei cicli degli agenti autonomi, dove una singola attività può richiedere decine di chiamate di inferenza concatenate. Ridurre la latenza di ogni singolo passaggio non significa solo risparmiare tempo complessivo, ma permette di aumentare il numero di iterazioni e passaggi logici eseguibili nello stesso arco temporale, elevando sensibilmente la qualità e l’accuratezza del risultato finale prodotto dall’agente.

Un altro ambito di applicazione fondamentale riguarda l’interazione uomo-macchina (HCI) e le pipeline di ricerca aziendale basate su sistemi RAG (Retrieval-Augmented Generation). Nell’interazione vocale, la capacità di Mercury 2 di produrre inferenze con una latenza ridotta fino a tredici volte rispetto agli standard attuali permette di simulare una conversazione naturale, priva di quelle pause artificiali che solitamente caratterizzano gli assistenti digitali. Sul fronte della ricerca aziendale, il modello facilita l’implementazione di sistemi di ricerca “multi-hop” e di riclassificazione dei dati senza che i ritardi di riepilogo gravino sul budget temporale o economico dell’organizzazione. Con un costo estremamente competitivo fissato a 0,25 dollari per milione di token in input e 0,75 dollari in output, Mercury 2 si propone come un’alternativa sostenibile e ad alte prestazioni per le imprese che necessitano di scalare le proprie capacità di intelligenza artificiale.

Il sostegno finanziario e tecnico ricevuto da figure chiave del settore e da colossi come Microsoft e NVIDIA conferma la validità della tecnologia dLLM come complemento necessario alle attuali architetture basate sui Transformer. La capacità di gestire trascrizioni in tempo reale e processi di pulizia dei dati con una rapidità finora mai raggiunta apre la strada a nuove frontiere nell’intelligenza artificiale conversazionale e nei sistemi di supporto alle decisioni. In definitiva, Mercury 2 non si configura solo come un aggiornamento prestazionale, ma come una dimostrazione pratica di come l’integrazione tra architetture software innovative e infrastrutture hardware dedicate possa ridefinire i limiti della velocità e dell’efficienza nel campo dell’intelligenza artificiale generativa per il mercato globale.