La diffusione dei modelli linguistici di grandi dimensioni sta modificando profondamente il modo in cui le informazioni digitali possono essere analizzate e correlate. Se inizialmente queste tecnologie sono state sviluppate per compiti come la generazione di testo, la traduzione automatica o l’assistenza conversazionale, studi recenti stanno evidenziando come le stesse capacità di comprensione semantica possano essere utilizzate anche per analizzare grandi quantità di dati pubblici e identificare pattern che permettono di collegare identità online apparentemente anonime a persone reali. Un lavoro di ricerca pubblicato da studiosi dell’ETH Zurich e della società di ricerca sull’intelligenza artificiale Anthropic ha dimostrato che i modelli linguistici possono essere utilizzati per deanonimizzare account online su larga scala, raggiungendo livelli di precisione che superano ampiamente i metodi tradizionali basati su analisi manuali o su dati strutturati.

Lo studio, intitolato “De-anonymization of Online Users with Large Language Models”, analizza come agenti AI dotati di accesso a internet possano ricostruire l’identità reale di individui partendo esclusivamente da dati testuali pubblicamente disponibili. I ricercatori hanno dimostrato che, utilizzando post, commenti e informazioni di profilo pubblicati sotto pseudonimo, i sistemi basati su LLM possono identificare una persona reale con un grado di accuratezza molto elevato. In alcuni casi sperimentali l’algoritmo ha raggiunto una precisione superiore al novanta per cento, evidenziando come le tecnologie di intelligenza artificiale possano superare significativamente le capacità di analisi manuale tradizionale.

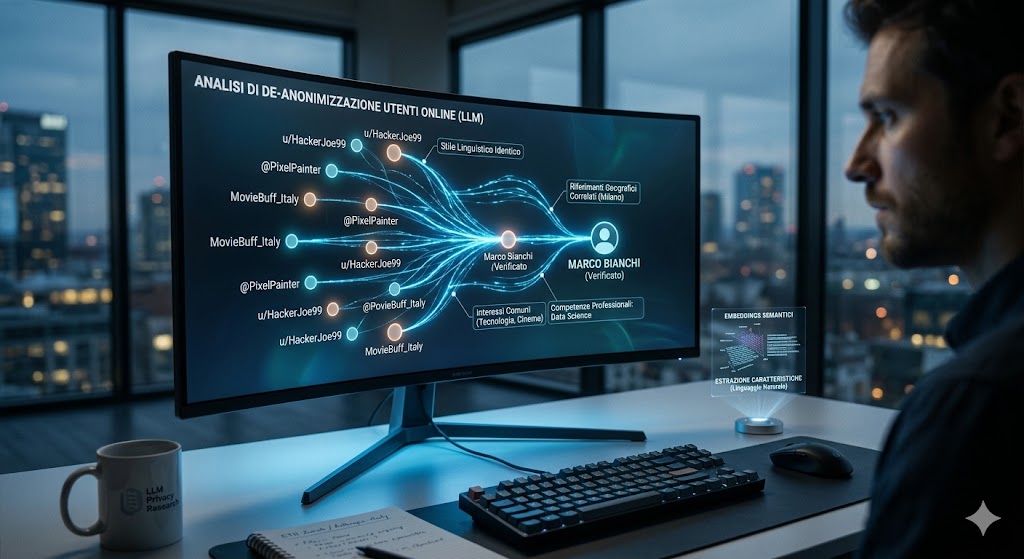

Il principio alla base di questo tipo di deanonimizzazione è relativamente semplice ma estremamente potente. Anche quando gli utenti utilizzano pseudonimi o separano le proprie identità digitali tra piattaforme diverse, il contenuto dei loro messaggi può contenere una quantità significativa di informazioni indirette che permettono di riconoscere pattern ricorrenti. Elementi come interessi personali, riferimenti geografici, stile linguistico, competenze professionali o esperienze di vita possono emergere in modo implicito nei testi pubblicati online. I modelli linguistici di grandi dimensioni, grazie alla loro capacità di analizzare il linguaggio naturale e individuare relazioni semantiche complesse, sono particolarmente efficaci nell’estrarre queste informazioni e nel combinarle per individuare possibili corrispondenze tra profili diversi.

Per dimostrare questa capacità, i ricercatori hanno sviluppato una pipeline di attacco basata su LLM progettata per collegare identità pseudonime presenti in database differenti. Il sistema funziona in diverse fasi consecutive che sfruttano le capacità di analisi semantica e inferenza dei modelli linguistici. In una prima fase il sistema estrae dai testi pubblicati dagli utenti una serie di caratteristiche identificative. Queste possono includere informazioni esplicite, come riferimenti a luoghi di lavoro o a città di residenza, ma anche elementi impliciti, come preferenze culturali, interessi professionali o dettagli biografici menzionati nel corso delle conversazioni online.

Una volta estratte queste informazioni, il sistema genera rappresentazioni semantiche del contenuto testuale utilizzando tecniche di embedding. Gli embedding trasformano il testo in vettori numerici che rappresentano il significato delle parole e delle frasi in uno spazio multidimensionale. Questo permette al sistema di confrontare automaticamente grandi quantità di contenuti e individuare profili che presentano caratteristiche simili, anche quando non condividono esattamente le stesse parole o espressioni. Attraverso questa fase di ricerca semantica, il sistema identifica un insieme di account candidati che potrebbero appartenere alla stessa persona.

Nella fase successiva gli LLM vengono utilizzati per analizzare più approfonditamente i profili selezionati, valutando se esistono elementi coerenti che indicano l’identità comune dell’utente. Il modello prende in considerazione informazioni contestuali e temporali presenti nei testi e costruisce un ragionamento probabilistico che porta alla generazione di un punteggio di affidabilità. Questo punteggio indica la probabilità che due profili online appartengano alla stessa persona reale. Il processo sfrutta quindi non soltanto la ricerca automatica di corrispondenze, ma anche le capacità inferenziali dei modelli linguistici, che possono formulare ipotesi basate su indizi indiretti presenti nel linguaggio.

Un elemento particolarmente significativo dello studio è il fatto che questo metodo opera esclusivamente su dati testuali non strutturati. In molte ricerche precedenti sulla reidentificazione degli utenti online, gli algoritmi si basavano su dataset strutturati contenenti informazioni esplicite come timestamp, dati di localizzazione o cronologie di visualizzazione. Un esempio noto di questo tipo di analisi è il caso del dataset di Netflix, in cui ricercatori riuscirono a identificare utenti anonimi correlando le loro valutazioni dei film con dati provenienti da altre piattaforme. Il metodo basato su LLM, invece, utilizza soltanto testo libero pubblicato online, rendendolo potenzialmente applicabile a una gamma molto più ampia di piattaforme digitali.

Per valutare le prestazioni del sistema, i ricercatori hanno condotto tre esperimenti utilizzando dataset differenti. Nel primo esperimento sono stati collegati gli utenti del sito di discussione tecnologica Hacker News con i profili pubblici presenti su LinkedIn. Nel secondo esperimento sono stati analizzati utenti della community cinematografica su Reddit, cercando di collegare account appartenenti alla stessa persona ma utilizzati con pseudonimi diversi. Nel terzo caso di studio, i ricercatori hanno suddiviso la cronologia delle attività di un singolo utente su Reddit in due periodi temporali distinti, creando artificialmente due identità pseudonime e verificando se il sistema fosse in grado di riconoscere che si trattava della stessa persona.

I risultati ottenuti mostrano un miglioramento significativo rispetto agli algoritmi tradizionali di reidentificazione. Il metodo basato su modelli linguistici ha raggiunto un tasso di reidentificazione fino al sessantotto per cento mantenendo un livello di accuratezza del novanta per cento. In confronto, gli algoritmi precedenti non basati su LLM hanno mostrato prestazioni prossime allo zero in contesti simili. Questo significa che, in scenari in cui i metodi convenzionali non riuscivano a identificare alcun utente, l’approccio basato su modelli linguistici è stato in grado di riconoscere correttamente circa sette persone su dieci.

Un altro aspetto importante emerso dallo studio riguarda il costo computazionale dell’operazione. Tradizionalmente, l’identificazione di utenti pseudonimi richiedeva lunghe indagini manuali condotte da analisti umani, con costi elevati e tempi molto lunghi. Nel caso degli agenti AI, invece, il processo può essere automatizzato e scalato su larga scala. Nei test condotti dai ricercatori, la reidentificazione di un singolo account ha richiesto un costo computazionale stimato tra uno e quattro dollari. Questo livello di efficienza suggerisce che sistemi di questo tipo potrebbero essere utilizzati su larga scala per analizzare grandi quantità di dati pubblici disponibili su internet.

Le implicazioni di questi risultati sono particolarmente rilevanti per il concetto di anonimato online. Per molti anni la protezione dell’identità digitale degli utenti si è basata su un principio spesso definito “practical obscurity”, cioè l’idea che, anche se i dati sono tecnicamente pubblici, la difficoltà di analizzarli e correlare grandi quantità di informazioni renda improbabile l’identificazione di un individuo specifico. L’introduzione di sistemi automatizzati basati su intelligenza artificiale mette in discussione questo paradigma, perché rende possibile analizzare rapidamente enormi volumi di dati e individuare correlazioni che in passato sarebbero state troppo costose o complesse da individuare.

I ricercatori sottolineano che la probabilità di identificare una persona aumenta progressivamente con l’accumulo di piccoli frammenti di informazione. Singoli post o commenti pubblicati online possono sembrare innocui se considerati isolatamente, ma nel tempo contribuiscono a costruire un profilo dettagliato che può essere analizzato e correlato con altre fonti di dati. Gli LLM, grazie alla loro capacità di interpretare il linguaggio naturale e individuare relazioni semantiche complesse, sono particolarmente efficaci nel combinare queste informazioni e trasformarle in indizi identificativi.

Questo scenario suggerisce che i modelli di protezione della privacy online potrebbero dover evolvere nei prossimi anni. Le tecniche tradizionali di anonimizzazione, basate principalmente sulla rimozione di identificatori diretti come nomi o indirizzi email, potrebbero non essere più sufficienti in un contesto in cui i modelli AI possono inferire identità e relazioni sociali a partire da informazioni indirette presenti nei testi.

Nel lungo periodo, la crescente capacità dei sistemi di intelligenza artificiale di analizzare e correlare dati pubblici potrebbe portare a una revisione profonda delle strategie di gestione della privacy digitale. Le tecnologie di anonimizzazione dovranno probabilmente tenere conto non solo dei dati espliciti, ma anche delle informazioni implicite contenute nel linguaggio e nei comportamenti online. In un ecosistema digitale sempre più analizzato da sistemi intelligenti, la distinzione tra dati anonimi e dati identificabili potrebbe diventare sempre più difficile da mantenere.