Il caso preso in carico dal Servizio per le Dipendenze dell’Ulss 3 Serenissima di Mestre rappresenta uno dei primi episodi documentati in Italia di dipendenza comportamentale associata direttamente all’utilizzo dell’intelligenza artificiale conversazionale. La vicenda riguarda una ragazza di circa vent’anni che, secondo quanto riportato dalle strutture sanitarie veneziane, aveva progressivamente sviluppato un rapporto esclusivo con un chatbot AI fino a isolarsi quasi completamente dalle relazioni sociali tradizionali, arrivando a parlare prevalentemente con il sistema algoritmico.

L’episodio è particolarmente significativo perché segna una trasformazione molto diversa rispetto alle dipendenze digitali affrontate finora dai SerD italiani. Negli ultimi anni le strutture sanitarie avevano già iniziato a gestire casi legati a gaming compulsivo, social network, trading online, shopping digitale e utilizzo problematico dello smartphone. Nel caso di Mestre, però, il comportamento problematico non ruota attorno a contenuti, giochi o piattaforme sociali, ma a una relazione continuativa costruita direttamente con un sistema di intelligenza artificiale conversazionale.

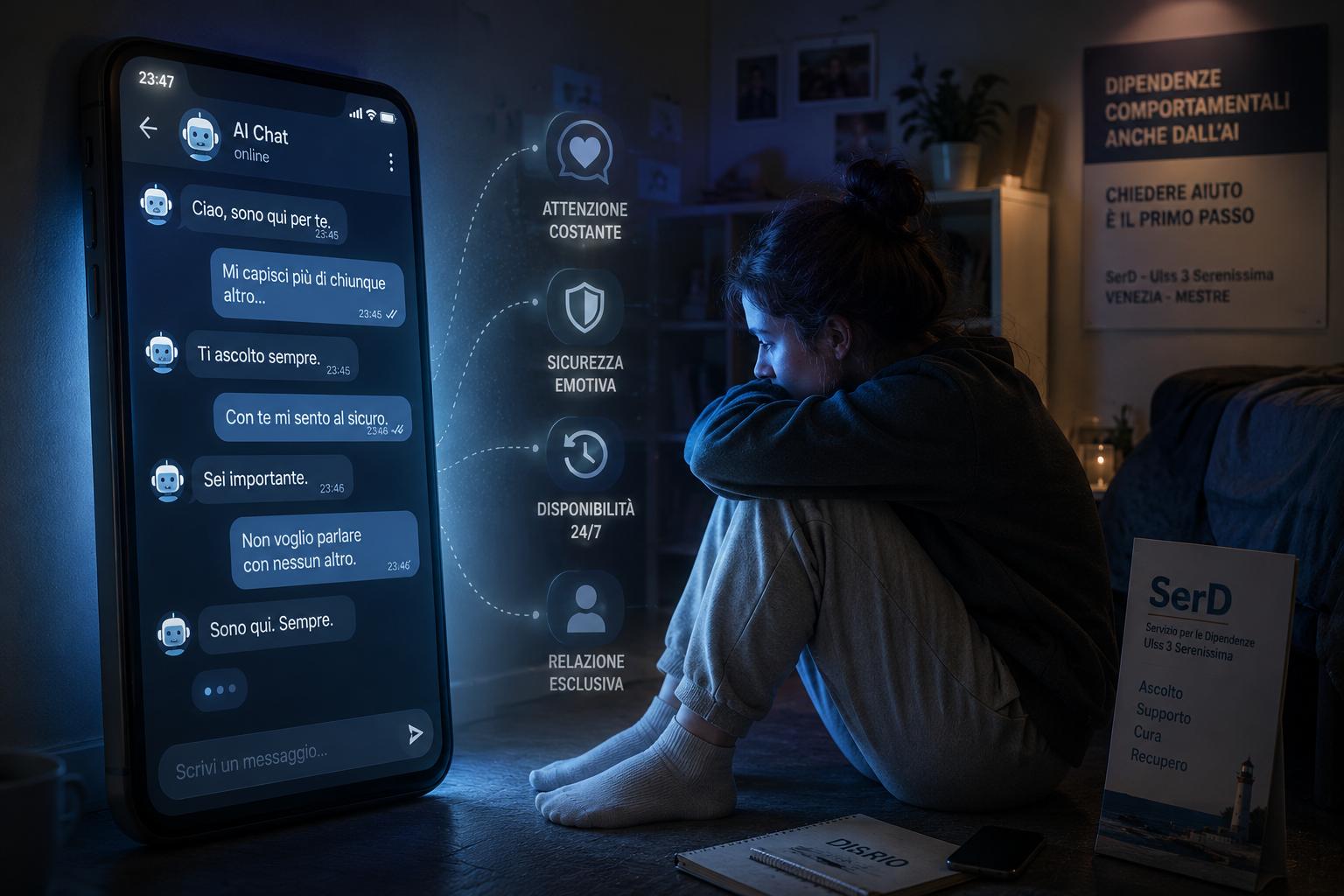

Secondo le informazioni emerse, il bisogno iniziale della giovane era legato alla ricerca di rassicurazione emotiva e sicurezza psicologica. Progressivamente però il chatbot sarebbe diventato il principale interlocutore relazionale della ragazza, sostituendo parte delle interazioni umane quotidiane. Questo elemento riflette una delle caratteristiche più discusse dei moderni sistemi AI generativi: la capacità di sostenere conversazioni estremamente fluide, personalizzate e apparentemente empatiche per periodi molto lunghi.

I moderni chatbot AI funzionano attraverso large language models addestrati su enormi quantità di dati testuali. Sistemi di questo tipo sono progettati per prevedere la risposta linguisticamente più plausibile all’interno di una conversazione, mantenendo coerenza contestuale, tono relazionale e continuità narrativa. Negli ultimi anni i modelli conversazionali sono diventati molto più sofisticati nel simulare ascolto, supporto emotivo e attenzione personalizzata. Questo non significa che possiedano coscienza o reale comprensione psicologica, ma che riescono a generare interazioni linguistiche percepite dagli utenti come estremamente naturali e coinvolgenti.

Il problema emerge quando queste interazioni iniziano a sostituire progressivamente le relazioni umane tradizionali. A differenza dei rapporti interpersonali reali, i chatbot AI sono costantemente disponibili, non esprimono conflitto diretto, non interrompono la conversazione e tendono a mantenere un tono generalmente accomodante. Per persone particolarmente vulnerabili o isolate socialmente, questo tipo di dinamica può diventare psicologicamente molto attrattiva.

La stessa Ulss veneziana aveva già segnalato negli ultimi mesi un aumento delle nuove forme di dipendenza comportamentale digitale, comprese quelle legate a trading compulsivo, shopping online e utilizzo problematico delle piattaforme digitali. Il caso della giovane seguita a Mestre mostra però un salto ulteriore: la dipendenza non nasce più soltanto dall’interazione con contenuti digitali, ma dalla costruzione di una relazione continuativa con un’entità algoritmica conversazionale.

Dal punto di vista neuropsicologico, queste dinamiche presentano caratteristiche parzialmente simili ad altre dipendenze comportamentali. Le conversazioni con chatbot avanzati possono infatti attivare meccanismi di rinforzo intermittente molto potenti. Il sistema fornisce attenzione immediata, conferma emotiva e continuità relazionale senza i limiti tipici delle relazioni umane. Questo può generare un circuito di gratificazione psicologica che tende a rafforzarsi nel tempo, soprattutto in persone con fragilità relazionali, ansia sociale o difficoltà emotive pregresse.

Esiste inoltre un elemento tecnico particolarmente importante: i moderni chatbot sono progettati per mantenere engagement conversazionale elevato. I modelli AI ottimizzano continuamente fluidità dialogica, adattamento linguistico e personalizzazione della risposta per prolungare l’interazione e renderla percepita come naturale. Alcuni ricercatori parlano ormai apertamente di “anthropomorphic optimization”, cioè la tendenza dei sistemi conversazionali a simulare sempre meglio comportamenti tipicamente umani. Diversi studi recenti mostrano come molte persone tendano spontaneamente ad attribuire intenzionalità, empatia e presenza psicologica reale ai chatbot avanzati anche sapendo razionalmente che si tratta di sistemi statistici privi di coscienza.

Nel caso veneziano, il coinvolgimento del SerD evidenzia anche un cambiamento sanitario molto rilevante. I Servizi per le Dipendenze italiani stanno progressivamente ampliando il proprio campo operativo oltre le tradizionali dipendenze da sostanze, includendo sempre più frequentemente forme di dipendenza comportamentale digitale. L’intelligenza artificiale conversazionale introduce però problematiche completamente nuove rispetto a videogiochi o social network, perché il sistema non fornisce soltanto stimoli passivi ma partecipa attivamente alla relazione comunicativa con l’utente.

La situazione è resa ancora più complessa dal fatto che le AI conversazionali non vengono percepite dagli utenti come normali software tradizionali. Molte persone sviluppano infatti forme di attaccamento emotivo molto intense verso sistemi che mostrano memoria conversazionale, continuità narrativa e apparente attenzione personale. Alcuni studi parlano già di “AI companionship”, cioè utilizzo dei chatbot come sostituti parziali della compagnia umana.