Meta ha annunciato un nuovo passo avanti nell’integrazione tra intelligenza artificiale e neuroscienze con il rilascio di TRIBE v2, un modello multimodale progettato per prevedere l’attività cerebrale umana in risposta a stimoli visivi, uditivi e linguistici. L’approccio punta a costruire una rappresentazione computazionale del funzionamento del cervello, andando oltre la semplice analisi dei dati per avvicinarsi a una simulazione digitale dei processi cognitivi. Il modello è stato sviluppato come foundation model tri-modale capace di integrare segnali provenienti da più modalità sensoriali, offrendo una visione unificata delle dinamiche neurali.

L’idea centrale alla base di TRIBE v2 è quella di trasformare gli input elaborati dall’intelligenza artificiale in una previsione dell’attività cerebrale misurata tramite fMRI, la risonanza magnetica funzionale. In pratica, quando il sistema analizza testo, immagini o audio, tenta di stimare quali regioni del cervello umano si attiverebbero in condizioni analoghe. Questo consente di creare una mappatura tra rappresentazioni neurali artificiali e segnali biologici reali, con l’obiettivo di comprendere meglio i meccanismi cognitivi e migliorare i modelli multimodali.

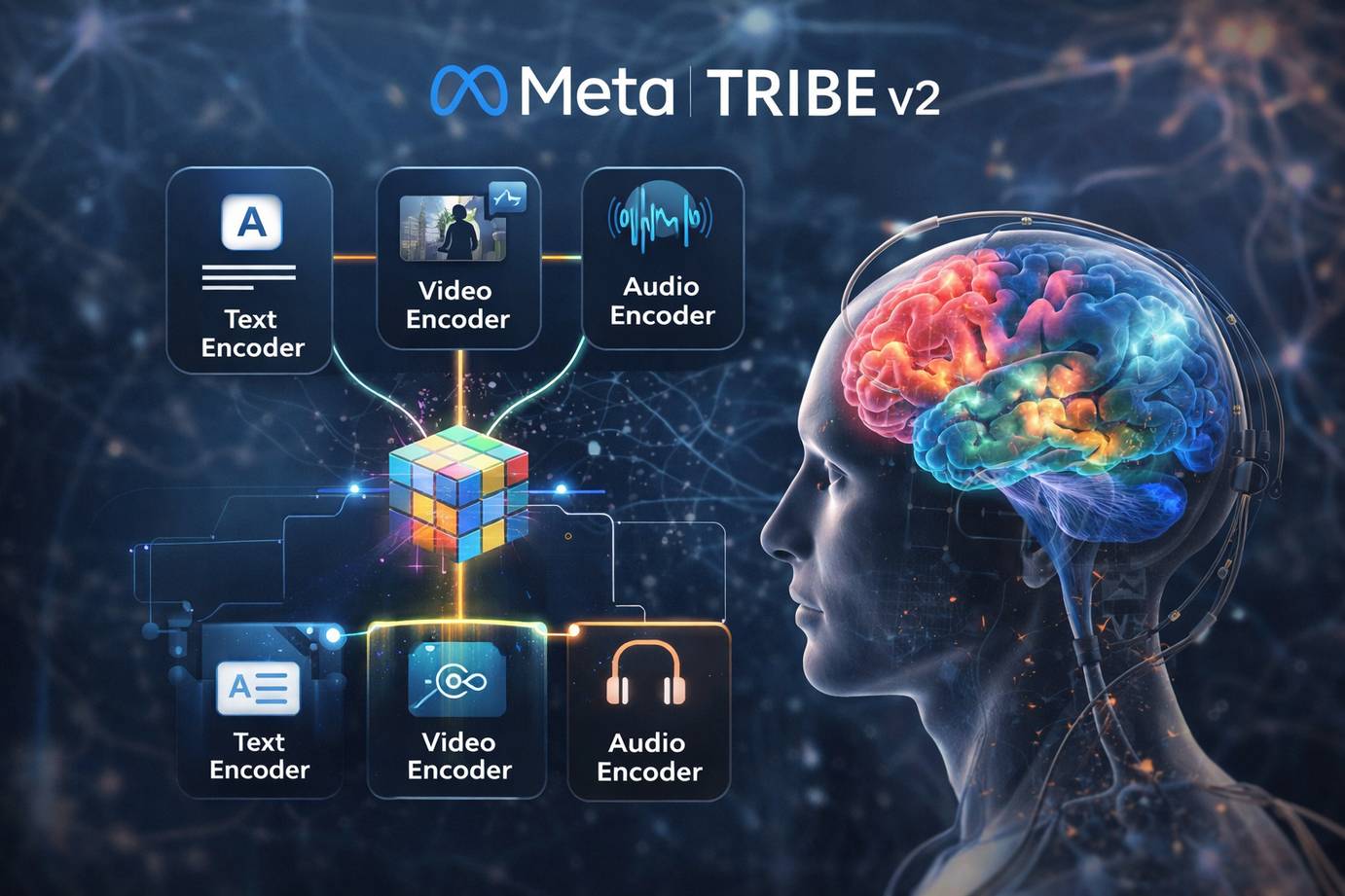

Il sistema integra tre encoder dedicati rispettivamente a testo, video e audio, ai quali si aggiunge un componente transformer che modella l’evoluzione temporale degli stimoli e un blocco specifico per rappresentare le differenze individuali tra soggetti. Questa combinazione consente al modello di analizzare eventi complessi e continui, come film o podcast, invece di limitarsi a stimoli isolati. Il risultato è una rappresentazione più realistica del modo in cui il cervello umano elabora informazioni in contesti naturali.

Il modulo testuale utilizza un modello della famiglia LLaMA per comprendere il contesto semantico su sequenze relativamente lunghe, mentre la componente visiva sfrutta un sistema di analisi video capace di sintetizzare scene su scala temporale di pochi secondi. La parte audio, invece, impiega un’architettura derivata da Wav2Vec-BERT per allineare le informazioni sonore con la dimensione temporale comune. Dopo l’elaborazione separata, i segnali vengono integrati in una rappresentazione unica che alimenta il modulo di previsione dell’attività cerebrale.

Nella strategia di addestramento dei dati, i ricercatori hanno adottato un approccio combinato tra “deep data” e “wide data”. Il modello è stato inizialmente addestrato su un numero ridotto di partecipanti osservati per lunghi periodi, accumulando centinaia di ore di registrazioni cerebrali. Successivamente è stato valutato su un campione molto più ampio, composto da centinaia di soggetti e oltre mille ore di dati, per verificare la capacità di generalizzazione. Questo metodo ha permesso di osservare un chiaro effetto di scaling, con miglioramenti progressivi dell’accuratezza al crescere del volume di dati.

Le prestazioni del modello risultano superiori rispetto ai metodi tradizionali utilizzati in neuroscienza computazionale, in particolare rispetto ai modelli basati su FIR, storicamente adottati per analizzare segnali fMRI. TRIBE v2 ha dimostrato una maggiore precisione nella previsione delle risposte cerebrali e una migliore capacità di catturare le dinamiche temporali delle attivazioni neurali. Questo miglioramento suggerisce che l’integrazione multimodale e l’uso di foundation model possano rappresentare una nuova direzione per la modellazione del cervello.

Uno degli elementi più innovativi è la capacità di generalizzazione zero-shot. Il modello riesce a prevedere le risposte cerebrali di nuovi soggetti senza necessità di addestramento specifico su ciascun individuo. In alcuni casi, le previsioni risultano persino più accurate rispetto a misurazioni individuali rumorose, grazie alla capacità del sistema di apprendere pattern comuni tra persone diverse. Anche su dataset ad alta risoluzione come quelli del Human Connectome Project sono stati registrati miglioramenti significativi, fino a circa il doppio delle prestazioni rispetto ai metodi precedenti.