Nuovo software sviluppato per migliorare la protesi robotica

I nuovi software sono stati sviluppati dai ricercatori della North Carolina State University per migliorare le protesi robotiche o gli esoscheletri. Il nuovo software è in grado di essere integrato con l’hardware esistente, garantendo una camminata più sicura e più naturale su diversi terreni.

L’articolo è intitolato ” Previsione del contesto ambientale per le protesi degli arti inferiori con quantificazione dell’incertezza. “È stato pubblicato in IEEE Transactions on Automation Science and Engineering.

Edgar Lobaton è coautore del documento. È professore associato di ingegneria elettrica e informatica all’università.

“Le protesi robotiche degli arti inferiori devono eseguire comportamenti diversi in base al terreno su cui camminano gli utenti”, afferma Lobaton. “Il framework che abbiamo creato consente all’intelligenza artificiale nelle protesi robotizzate di prevedere il tipo di terreno su cui gli utenti faranno un passo, quantificare le incertezze associate a tale previsione e quindi incorporare tale incertezza nel suo processo decisionale.”

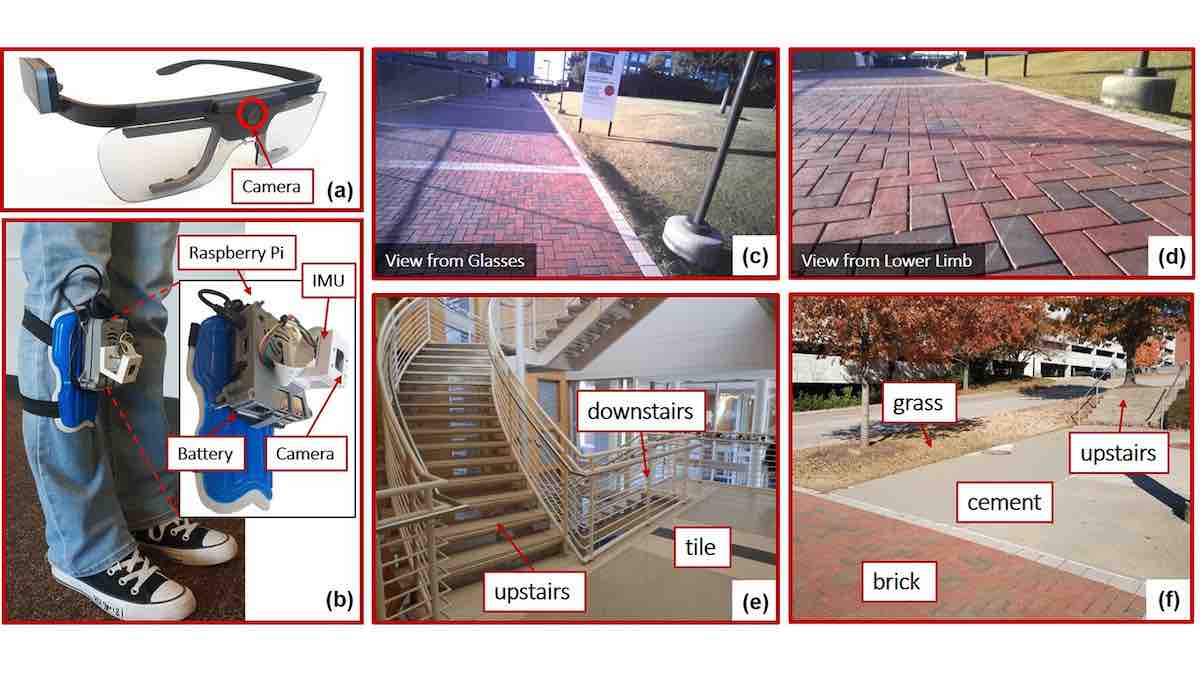

C’erano sei diversi terreni su cui i ricercatori si sono concentrati, ognuno dei quali ha richiesto aggiustamenti nel comportamento di una protesi robotica. Erano piastrelle, cemento, mattoni, erba, “sopra” e “sotto”.

Boxuan Zhong è l’autore principale del documento e un dottorato di ricerca. laureato nello stato NC.

“Se il grado di incertezza è troppo elevato, l’intelligenza artificiale non è costretta a prendere una decisione discutibile – potrebbe invece avvisare l’utente che non ha abbastanza fiducia nelle sue previsioni per agire, o potrebbe essere automaticamente “modalità”, dice Zhong.

Incorporazione di elementi hardware e software

Il nuovo framework si basa sull’incorporazione di elementi hardware e software e viene utilizzato con qualsiasi esoscheletro robotico dell’arto inferiore o dispositivo protesico robotico.

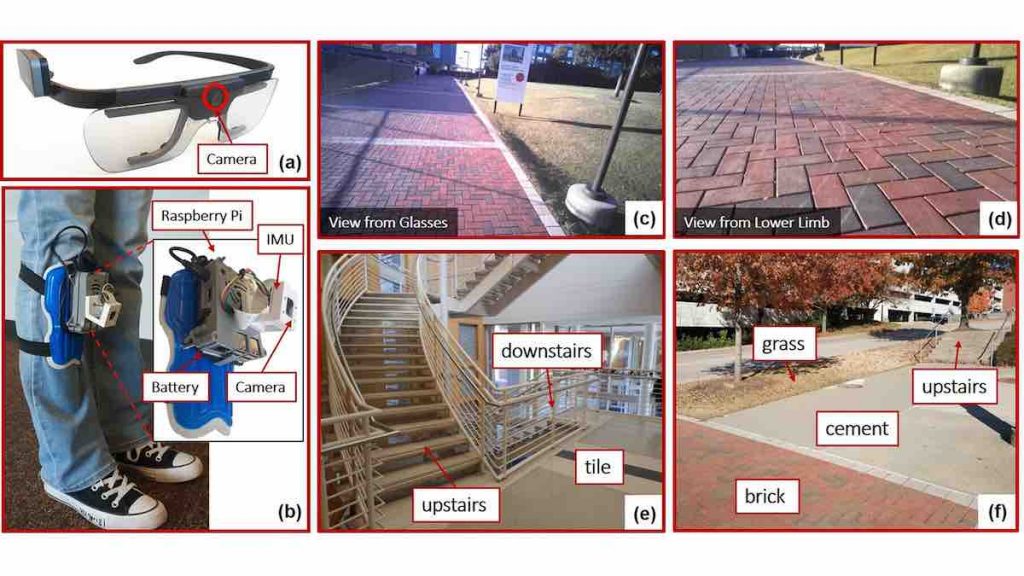

Un nuovo aspetto di questo framework è una fotocamera come un altro componente hardware. Nello studio, le telecamere sono state indossate sugli occhiali e sono state posizionate sulla protesi dell’arto inferiore. I ricercatori hanno quindi osservato come l’IA è stata in grado di utilizzare i dati di visione artificiale dei due diversi tipi di telecamere, prima separatamente e poi insieme.

Helen Huang è coautrice dell’articolo. È la distinta professore di ingegneria biomedica della famiglia Jackson presso il Dipartimento congiunto di ingegneria biomedica presso NC State e l’Università della Carolina del Nord a Chapel Hill.

“L’integrazione della visione artificiale nel software di controllo per la robotica indossabile è una nuova ed entusiasmante area di ricerca”, afferma Huang. “Abbiamo scoperto che l’utilizzo di entrambe le fotocamere funzionava bene, ma richiedeva una grande potenza di elaborazione e potrebbe essere proibitivo in termini di costi. Tuttavia, abbiamo anche scoperto che l’uso della sola fotocamera montata sull’arto inferiore ha funzionato abbastanza bene, in particolare per le previsioni a breve termine, come ad esempio come sarebbe il terreno per il prossimo passo o due ”.

Secondo Lobaton, il lavoro è applicabile a qualsiasi tipo di sistema di apprendimento profondo.

“Abbiamo trovato un modo migliore per insegnare ai sistemi di apprendimento profondo come valutare e quantificare l’incertezza in un modo che consenta al sistema di incorporare l’incertezza nel suo processo decisionale”, afferma Lobaton. “Questo è certamente rilevante per le protesi robotiche, ma il nostro lavoro qui potrebbe essere applicato a qualsiasi tipo di sistema di apprendimento profondo.”

Formazione del sistema AI

Per addestrare il sistema di intelligenza artificiale, le telecamere sono state posizionate su partecipanti abili, che si sono quindi spostati in diversi ambienti interni ed esterni. Il passo successivo è stato quello di fare in modo che un individuo con amputazione degli arti inferiori navigasse negli stessi ambienti indossando le telecamere.

“Abbiamo scoperto che il modello può essere trasferito in modo appropriato in modo che il sistema possa operare con soggetti di diverse popolazioni”, afferma Lobaton. “Ciò significa che l’IA ha funzionato bene anche se è stata addestrata da un gruppo di persone e utilizzata da qualcuno diverso.”

Il prossimo passo è testare il framework in un dispositivo robotico.

“Siamo entusiasti di integrare la struttura nel sistema di controllo per il lavoro di protesi robotiche – questo è il passo successivo”, afferma Huang.

Il team lavorerà anche per rendere il sistema più efficiente, richiedendo meno input e elaborazione dei dati visivi.