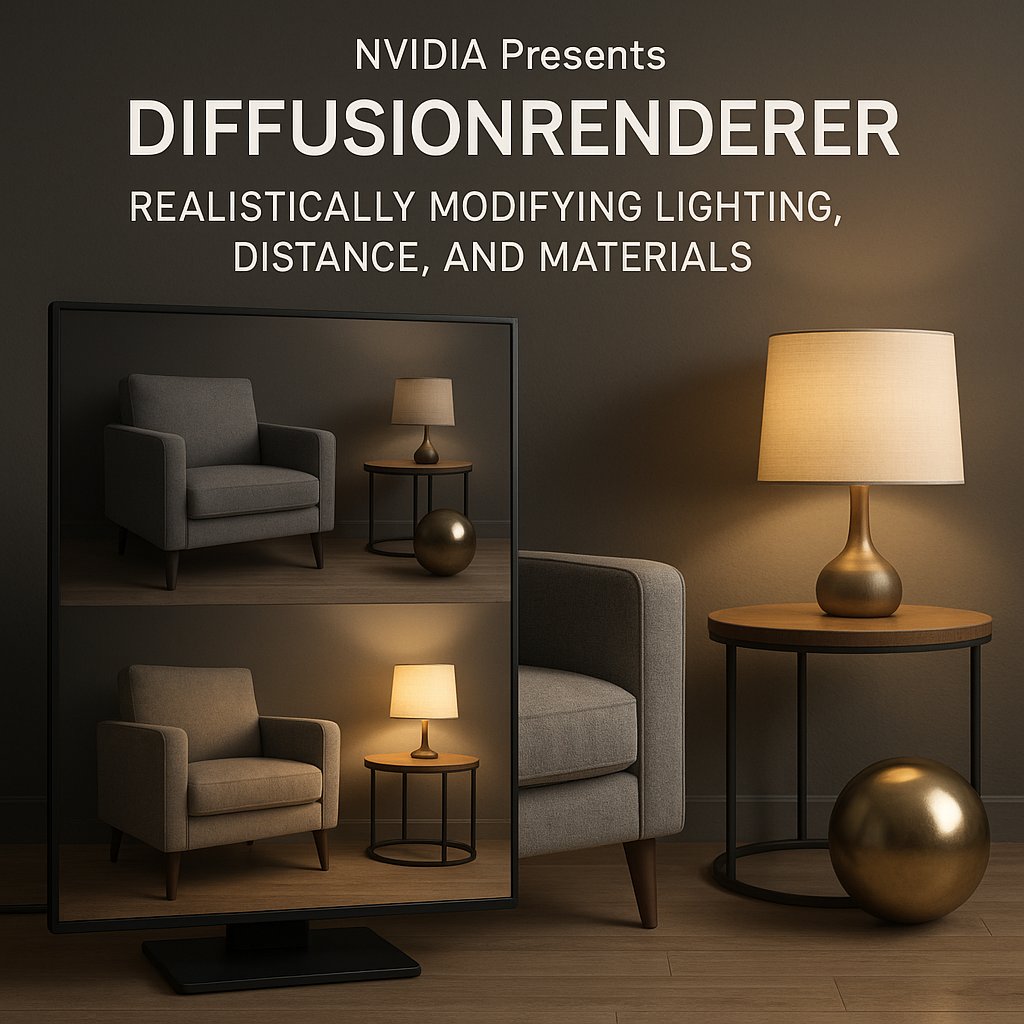

NVIDIA ha recentemente presentato una tecnologia innovativa nel campo del rendering neurale: il DiffusionRenderer. Questo modello avanzato permette di modificare in modo realistico l’illuminazione, la distanza e i materiali all’interno di un video, utilizzando dati limitati provenienti da immagini esistenti. Sviluppato in collaborazione con l’Università di Toronto, il Vector Institute e l’UIUC, il DiffusionRenderer rappresenta un significativo passo avanti rispetto ai tradizionali metodi di rendering fisicamente basato (PBR), superando le limitazioni legate alla necessità di dati 3D accurati.

Il DiffusionRenderer combina due processi distinti del rendering neurale: il rendering inverso e quello diretto. Il primo analizza un’immagine per estrarre informazioni nascoste, come la geometria, la profondità, i colori e i materiali degli oggetti presenti. Il secondo utilizza queste informazioni per applicare modifiche, come la variazione dell’illuminazione o l’inserimento di nuovi oggetti, generando immagini fotorealistiche. Questa combinazione consente di modificare scene reali con un alto grado di realismo, senza la necessità di modelli 3D complessi.

Per addestrare il DiffusionRenderer, i ricercatori hanno utilizzato un vasto set di dati composto da 150.000 video sintetici e 15.100 video del mondo reale. I video sintetici sono stati creati combinando oggetti 3D ad alta risoluzione, illuminazione HDR e materiali realistici, fornendo informazioni precise per l’addestramento. Per i video reali, sono stati generati automaticamente dati di scena utilizzando il rendering inverso, che ha appreso dai dati sintetici. Questo approccio ha permesso di ridurre il divario tra i dati sintetici e quelli reali, migliorando la capacità del modello di generalizzare a scenari del mondo reale.

Il DiffusionRenderer ha dimostrato di superare i metodi esistenti in vari compiti di rendering, come la riilluminazione, l’editing dei materiali e l’inserimento di oggetti virtuali. È stato in grado di riprodurre effetti ottici complessi, come ombre, riflessi e interriflessioni, anche in scene complesse con più oggetti. Questo lo rende uno strumento potente per applicazioni nei settori della pubblicità, del cinema, dei videogiochi e della robotica.

Il DiffusionRenderer rappresenta un’evoluzione significativa nel campo del rendering neurale, offrendo un flusso di lavoro integrato che consente ai creatori di comprendere, modificare e rigenerare immagini con facilità. La sua capacità di lavorare con dati limitati e di generare risultati fotorealistici apre nuove possibilità per la creazione di contenuti video, democratizzando l’accesso a tecnologie avanzate di rendering. Con ulteriori sviluppi e ottimizzazioni, il DiffusionRenderer potrebbe diventare uno strumento standard nell’industria della grafica computazionale.