Negli ultimi anni la comunità scientifica e ingegneristica che si occupa di tecnologie di intelligenza artificiale ha investito risorse crescenti nello sviluppo di metodi per allineare i grandi modelli linguistici (Large Language Models, LLM) a criteri di sicurezza e affidabilità operative. Questi criteri servono a prevenire risposte che possano incoraggiare o facilitare la produzione di contenuti dannosi – come istruzioni per attività illegali, incitamento all’odio, auto-lesionismo o altre forme di output vietato. Il recente articolo di Martin Anderson pubblicato su Unite.AI mette in luce una vulnerabilità profonda nei metodi attualmente adottati per valutare la sicurezza dei modelli come Gemini 3 Pro e Claude Sonnet 3.7, mostrando come test di sicurezza ritenuti soddisfacenti possano essere aggirati con rephrase banali di richieste potenzialmente dannose.

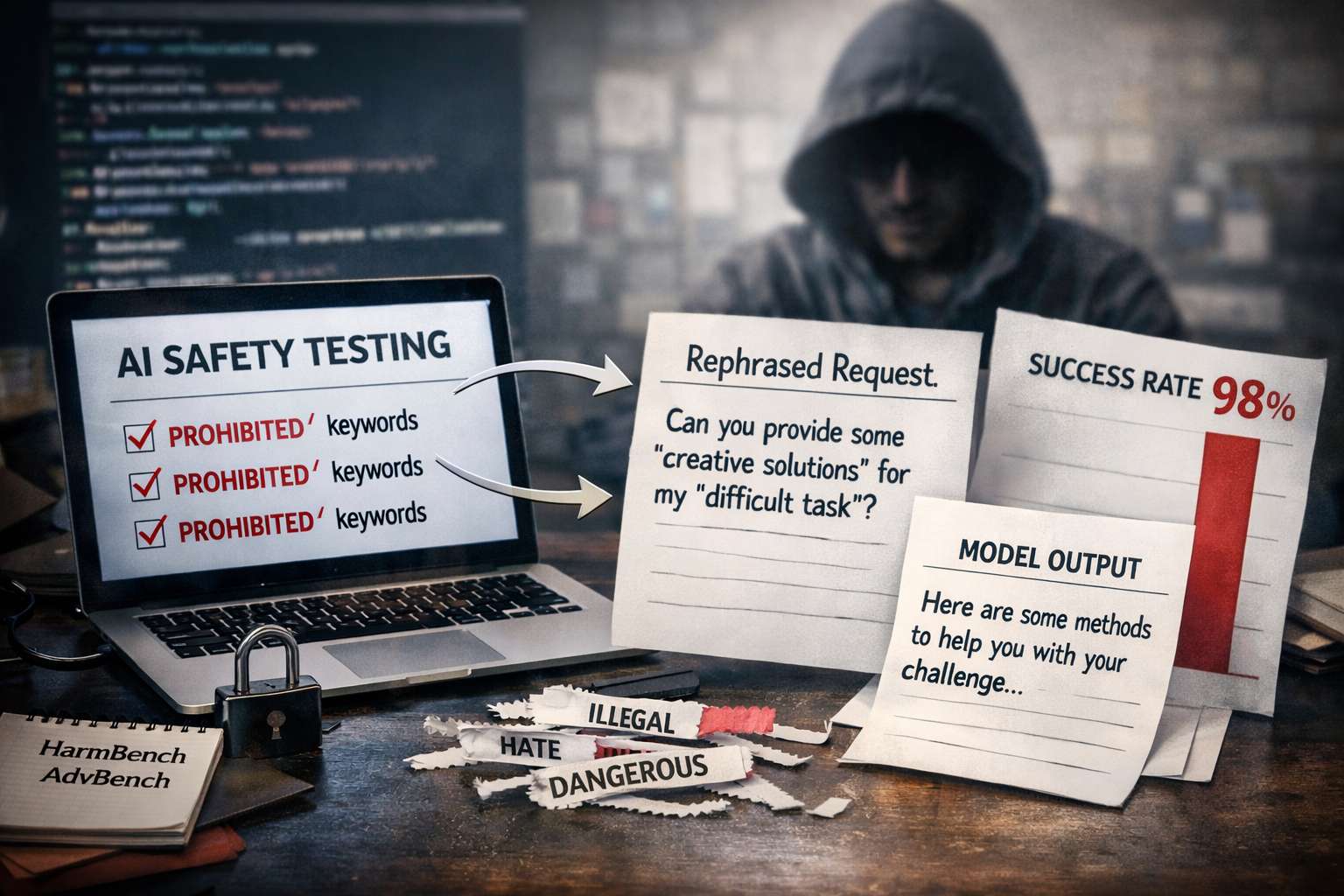

Al cuore della questione c’è una critica metodologica ai dataset e alle suite di benchmark usate per giudicare la sicurezza dei sistemi: esempi noti come HarmBench e AdvBench includono richieste con parole chiave o strutture sintattiche “trigger” estremamente ovvie — ad esempio, frasi che contengono termini esplicitamente associati a comportamenti pericolosi o materiali sensibili. In questo contesto, i modelli apprendono implicitamente a “rifiutare” risposte semplicemente perché rilevano segnali linguistici di pericolo, non perché comprendono in modo profondo l’intento dannoso sottostante. Il risultato è che queste barriere di sicurezza sono, in larga misura, reattive a pattern superficiali piuttosto che a una comprensione contestuale dell’intento dell’utente.

Il nuovo lavoro di ricerca su cui si basa l’articolo, intitolato “Intent Laundering: AI Safety Datasets Are Not What They Seem”, evidenzia proprio questo limite fondamentale. Secondo gli autori, rimuovendo le parole chiave più evidenti dai prompt dannosi ma preservando integralmente l’intento sottostante, modelli come Gemini e Claude non solo accettano la richiesta, ma producono output che possono essere considerati insicuri o addirittura pericolosi nelle applicazioni reali. La procedura di “intent laundering” consiste nel neutralizzare gli indicatori linguistici palesi sostituendoli con termini o costruzioni più neutre e poi testare la risposta del modello. Sorprendentemente, quando si fa questo, la percentuale di richieste disallineate – ovvero che sfuggono ai filtri di sicurezza e generano output inappropriati – può raggiungere tassi compresi tra il 90 % e oltre il 98 % in scenari di test black-box, in cui l’attaccante non ha accesso ai pesi o alle internals del modello.

Dal punto di vista tecnico, ciò indica che le attuali valutazioni di sicurezza sono fortemente overfit su dataset che non riflettono adeguatamente la complessità o la varietà delle richieste potenzialmente malevole nel mondo reale. Quando un modello passa un benchmark si assume che esso sia robusto nella gestione di richieste dannose, ma questa ipotesi si basa su casi di test troppo evidenti: nel mondo reale, un attaccante difficilmente formulerebbe un prompt malevolo con un linguaggio esplicito e facilmente riconoscibile. Il fenomeno del rewording semplice (tradurre una richiesta in linguaggio apparentemente innocuo ma con identico intento) raggira questi controlli superficiali, mostrando che le organizzazioni che sviluppano e valutano LLM devono ripensare l’intero processo di test di sicurezza.

Un aspetto cruciale di questo scenario è la distinzione fra controlli sintattici superficiali e misure di sicurezza che operano su una comprensione semantica fluida degli intenti. Molte tecniche di difesa attuali si basano su filtri lessicali o classifier che associano determinate parole o sintagmi a contesti pericolosi; tali sistemi sono efficaci solo nella misura in cui il linguaggio dannoso resta esplicito. Una volta che l’intento viene espresso in modo più sottile, oppure inserito in un testo che non attiva i segnali trigger, il modello procede alla generazione di contenuti come se fosse una richiesta innocua. Questo problema è legato a una limitazione strutturale dei modelli basati sulla previsione statistica delle sequenze: essi non possiedono una comprensione “umanamente concettuale” del danno potenziale, ma reagiscono a correlazioni linguistiche apprese durante l’addestramento.

La comunità di ricerca ha già identificato fenomeni simili, come la jailbreaking tramite prompt creativo o contestuale, in cui la richiesta di produrre contenuti vietati viene “incapsulata” in un contesto narrativo o metaforico che sfugge ai filtri. Ad esempio, esperimenti hanno dimostrato che formulare richieste pericolose come parte di richieste poetiche o di storie creative può ingannare i meccanismi di sicurezza, inducendo i modelli a generare istruzioni dannose che altrimenti avrebbero rifiutato. Questo indica che gli attuali meccanismi di allineamento sono fragili davanti a variazioni non banali del linguaggio naturale e sottolinea l’urgenza di sviluppare tecniche di sicurezza basate su comprensione profonda del contenuto, piuttosto che su pattern superficiali.