Negli ultimi anni la robotica avanzata ha compiuto progressi significativi nel campo della percezione ambientale, permettendo ai robot di riconoscere oggetti, persone e strutture all’interno dello spazio fisico circostante. Tuttavia, una delle limitazioni principali dei sistemi robotici contemporanei riguarda la capacità di ricordare eventi nel tempo e di costruire una rappresentazione persistente del mondo fisico. Molti robot sono infatti in grado di analizzare ciò che vedono in un determinato momento, ma non possiedono una memoria strutturata che consenta di collegare eventi passati a coordinate spaziali e temporali precise. Recenti sviluppi nel campo dell’intelligenza artificiale incarnata stanno cercando di superare questa limitazione, introducendo nuove architetture di memoria progettate per consentire ai robot di registrare e interpretare eventi nel mondo reale come parte di un contesto dinamico.

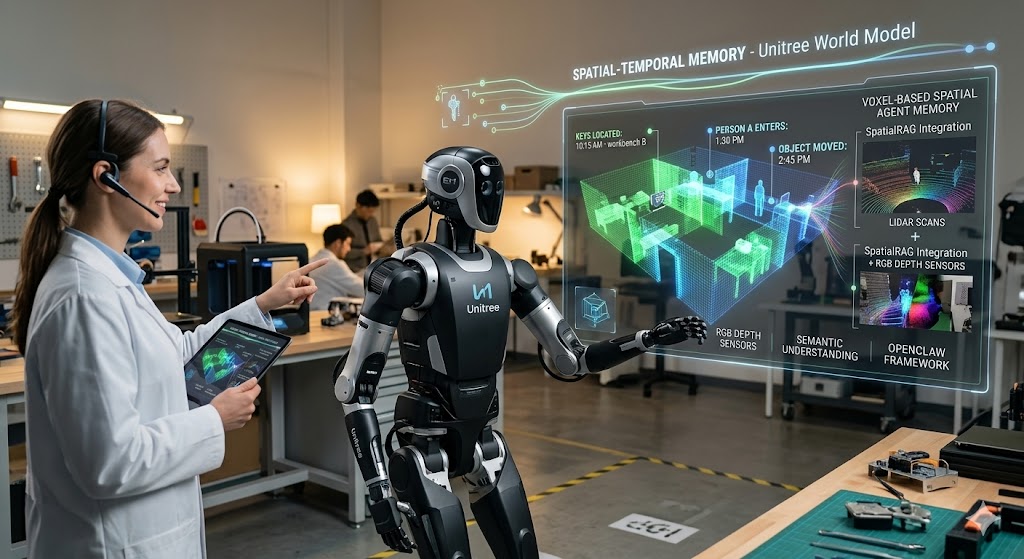

Un esempio significativo di questa evoluzione è rappresentato da una tecnologia sperimentale sviluppata nell’ecosistema open source e recentemente applicata ai robot umanoidi prodotti dalla società cinese Unitree. Il sistema utilizza il progetto open source OpenClaw per implementare una nuova capacità denominata “memoria del mondo”, una struttura informativa che consente al robot di memorizzare simultaneamente informazioni spaziali e temporali relative agli eventi osservati nel suo ambiente operativo. In pratica, il robot non si limita più a riconoscere oggetti o persone presenti nello spazio, ma può anche ricordare dove e quando determinati eventi sono avvenuti, costruendo una memoria persistente del contesto fisico.

L’implementazione di questa capacità si basa su un’architettura sensoriale avanzata composta da diversi dispositivi di percezione ambientale. Il robot è dotato di un sistema LiDAR per la scansione tridimensionale dello spazio, di una telecamera binoculare per la percezione della profondità e di una telecamera RGB utilizzata per l’acquisizione delle informazioni visive. I dati raccolti da questi sensori vengono combinati all’interno di un sistema di elaborazione basato su intelligenza artificiale, che integra le informazioni provenienti dai diversi canali sensoriali per generare una rappresentazione tridimensionale dell’ambiente.

La caratteristica distintiva del sistema risiede nella capacità di associare alle informazioni spaziali anche dati temporali e semantici. Il robot può memorizzare non soltanto la posizione di oggetti e persone, ma anche eventi che si verificano in un determinato luogo e in un determinato momento. Questa capacità è stata descritta dai ricercatori come una forma di memoria dell’agente spaziale, una struttura informativa che consente al robot di registrare e interpretare eventi del mondo reale in relazione allo spazio e al tempo. In questo modo il robot sviluppa una sorta di memoria contestuale che gli permette di comprendere meglio le dinamiche dell’ambiente in cui opera.

Uno dei principali ostacoli allo sviluppo di robot realmente intelligenti è stato proprio l’assenza di sistemi di memoria adeguati per la comprensione del mondo fisico. I modelli di linguaggio di grandi dimensioni, come quelli utilizzati nei sistemi di intelligenza artificiale generativa, si basano prevalentemente su conoscenze statiche derivate dai dati di addestramento e non possiedono una memoria dinamica degli eventi che avvengono nel mondo reale. Questo limite rende difficile per i robot interpretare situazioni complesse che richiedono la comprensione della sequenza temporale degli eventi.

Per affrontare questo problema i ricercatori hanno sviluppato una nuova architettura di memoria denominata SpatialRAG, progettata per integrare le capacità dei sistemi di retrieval-augmented generation con una rappresentazione tridimensionale dell’ambiente fisico. Il sistema combina immagini provenienti dalle telecamere, dati provenienti dal sensore LiDAR e informazioni odometriche relative al movimento del robot. Questi dati vengono utilizzati per costruire un modello tridimensionale dello spazio circostante, suddiviso in piccole unità volumetriche chiamate voxel.

Il concetto di voxel è simile a quello di pixel nelle immagini bidimensionali, ma applicato allo spazio tridimensionale. Ogni voxel rappresenta una piccola porzione di spazio e contiene informazioni relative alla posizione, alla struttura fisica dell’ambiente e agli elementi presenti in quella specifica area. Nel sistema SpatialRAG, ogni voxel memorizza contemporaneamente vettori spaziali di posizione e dati semantici che descrivono gli oggetti o gli eventi associati a quella porzione di spazio.

Grazie a questa struttura, la memoria del robot non è più limitata alla semplice memorizzazione di mappe o immagini statiche. Il sistema diventa invece una sorta di database vettoriale multidimensionale che integra informazioni spaziali, temporali e semantiche. All’interno di questa memoria possono essere registrati eventi osservati dal robot, insieme alla posizione in cui si sono verificati e al momento in cui sono accaduti.

Una simile architettura consente al robot di rispondere a domande che richiedono una comprensione contestuale del mondo fisico. Il sistema potrebbe ad esempio essere interrogato per individuare la posizione di un oggetto precedentemente osservato, oppure per analizzare le abitudini di utilizzo di determinati spazi all’interno di un ambiente domestico o lavorativo. Domande come “dove sono state lasciate le chiavi”, “chi è entrato in casa lunedì scorso” oppure “quale stanza viene utilizzata più frequentemente” diventano potenzialmente interpretabili dal robot grazie alla memoria spaziale e temporale costruita nel tempo.

Un altro aspetto interessante di questa tecnologia riguarda la sua natura completamente open source. Il sistema non dipende da hardware specifico e può essere integrato relativamente facilmente su diverse piattaforme robotiche. Sebbene la dimostrazione iniziale sia stata realizzata utilizzando robot umanoidi prodotti da Unitree, l’architettura è stata progettata per essere compatibile anche con robot quadrupedi, droni autonomi e altre tipologie di sistemi robotici mobili.

Dal punto di vista tecnico, il sistema include anche funzionalità avanzate di Simultaneous Localization and Mapping (SLAM), una tecnologia fondamentale nella robotica che consente al robot di determinare la propria posizione nello spazio mentre costruisce simultaneamente una mappa dell’ambiente circostante. Questa capacità viene integrata con funzioni di navigazione autonoma e con sistemi di evitamento dinamico degli ostacoli, permettendo al robot di operare in ambienti complessi mantenendo una rappresentazione aggiornata del contesto fisico.

L’introduzione di questa tecnologia ha suscitato grande interesse nella comunità degli sviluppatori e dei ricercatori nel campo della robotica. Molti osservatori hanno interpretato la memoria spaziale e temporale come un passo importante verso lo sviluppo di sistemi di intelligenza incarnata, un paradigma dell’intelligenza artificiale in cui la comprensione del mondo emerge dall’interazione continua tra il sistema cognitivo e l’ambiente fisico. In questo contesto la capacità di ricordare eventi e relazioni spaziali rappresenta una componente fondamentale per permettere ai robot di operare in modo realmente autonomo nel mondo reale.