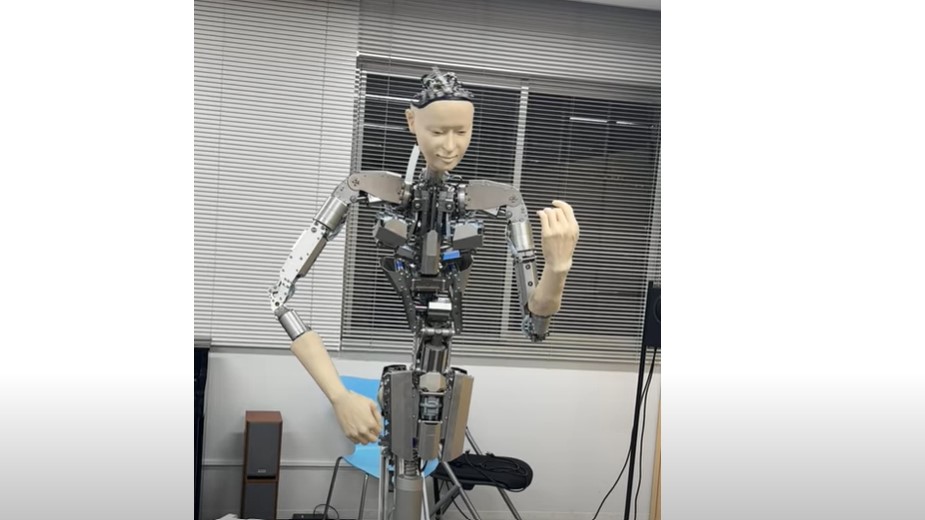

Gli scienziati dell’Università di Tokyo hanno raggiunto un risultato straordinario collegando il modello LLM (Large Language Model) GPT-4 di OpenAI a un robot umanoide di nome Alter3, come riportato in un recente articolo pubblicato. Questa innovativa connessione ha permesso al robot di comprendere istruzioni in linguaggio naturale in modo così efficace da controllare i suoi movimenti e gesti.

Il team di ricerca dell’Università di Tokyo ha dimostrato che Alter3 può adottare pose e comportamenti complessi, come scattarsi un selfie, suonare la chitarra o persino fingere di essere un fantasma, tutto in risposta a comandi espressi in linguaggio naturale. Ciò avviene senza la necessità di una programmazione esplicita per ciascun movimento, in modo simile a come il modello GPT-4, che alimenta anche ChatGPT, è in grado di comprendere e rispondere alle descrizioni delle persone in vari termini.

Questa innovazione da parte degli scienziati colma un’importante lacuna nelle interazioni conversazionali con i robot fisici. In genere, tali interazioni richiedono un controllo preciso del movimento basato su codice specializzato e hardware dedicato. Tuttavia, i ricercatori dell’Università di Tokyo hanno tradotto comandi ad alto livello in istruzioni che Alter3 può eseguire autonomamente. Il robot può apprendere i movimenti in modo intuitivo, passando da azioni semplici a gesti coordinati più complessi. Gli utenti possono guidare le pose di Alter3 e persino aiutarlo a eseguire sfumature come diversi passi di danza.

Il sistema sfrutta il modello GPT-4 per interpretare istruzioni, come ad esempio “fingi di essere un fantasma,” e le traduce in una serie di comandi in codice Python eseguiti da Alter3. Sebbene la mobilità attuale di Alter3 si limiti ai gesti delle braccia a causa della parte inferiore del corpo fissa, il team di ricerca crede che questa tecnica possa essere adattata con facilità ad altri androidi. Questo progresso rappresenta un passo avanti significativo nella capacità dei robot umanoidi di interpretare istruzioni conversazionali e rispondere in modo contestuale attraverso espressioni facciali e comportamenti fisici realistici.

Va notato che questo esperimento non è il primo ad unire LLM e robot. Nvidia ha recentemente utilizzato GPT-4 per sviluppare un sistema di addestramento AI chiamato Eureka, che consente ai robot di apprendere e svolgere compiti più velocemente rispetto ai metodi tradizionali, attraverso algoritmi di ricompensa autogenerati. Inoltre, Alter3 non è il primo robot a beneficiare dei modelli OpenAI, poiché ingegneri del settore hanno integrato ChatGPT in robot “Spot” di Boston Dynamics e hanno collegato l’intelligenza artificiale all’API vocale sintetica di Google. Questo ha permesso ai cani robot di comprendere e rispondere a domande e comandi pronunciati in modo informale, rappresentando un ulteriore progresso nell’integrazione dell’IA nella robotica.