In un’epoca in cui l’Intelligenza Artificiale generativa è diventata onnipresente nella scrittura e nella produzione di contenuti, è cresciuta esponenzialmente la necessità di strumenti capaci di discernere l’origine di un testo: è stato scritto da un umano o da una macchina? Questa necessità ha portato alla rapida diffusione dei cosiddetti AI detector, software basati sull’apprendimento automatico, impiegati specialmente nel mondo accademico e editoriale per prevenire l’uso improprio dei Large Language Model (LLM) come ChatGPT o Gemini. Tuttavia, un esperimento virale di risonanza mondiale ha messo in luce una profonda e ironica vulnerabilità di questi strumenti, utilizzando un testo che per definizione non può essere artificiale: la Dichiarazione di Indipendenza degli Stati Uniti d’America.

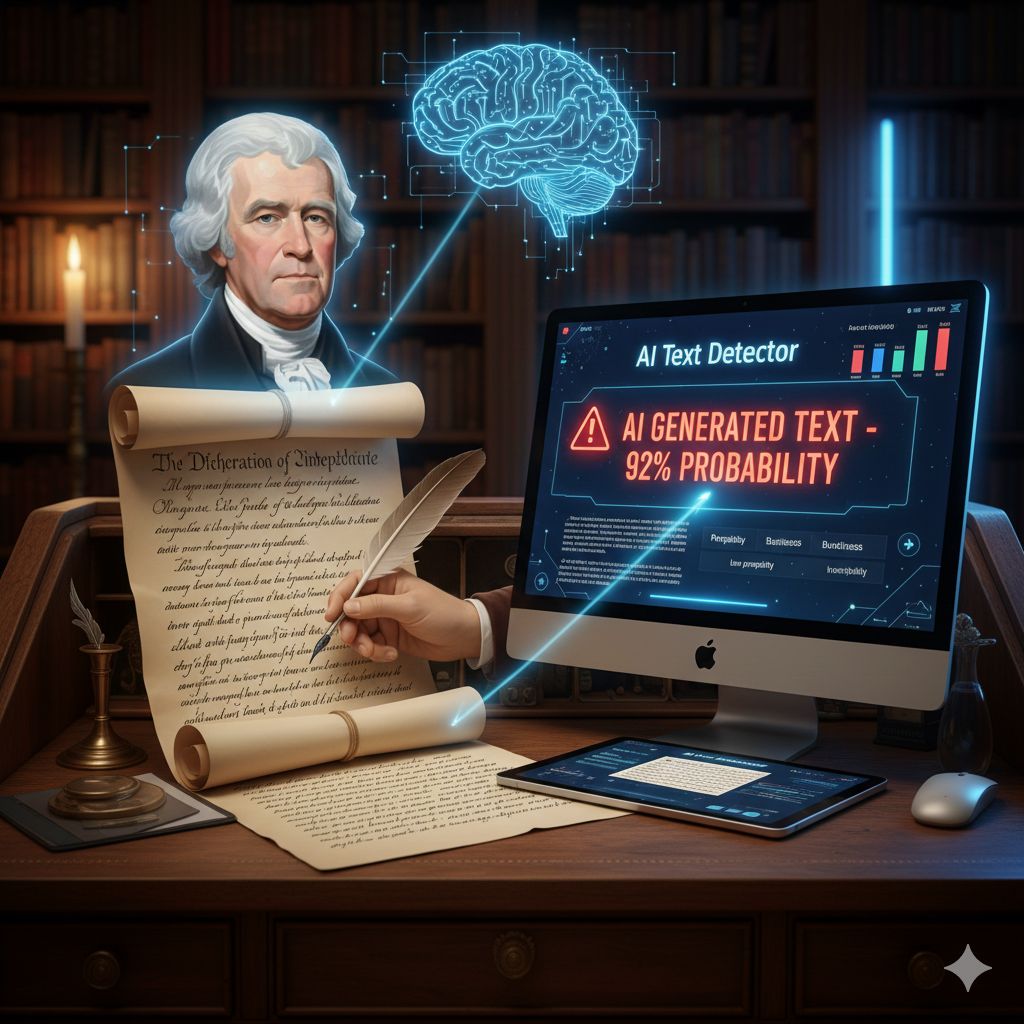

L’esperimento, condotto da diversi ricercatori, giornalisti e utenti online, ha previsto l’inserimento di passaggi del documento del 1776 in vari rilevatori AI disponibili sul mercato. Il risultato, spesso condiviso sui social media con incredulità e sconcerto, è stato sorprendente e inequivocabile: la Dichiarazione di Indipendenza, pilastro della storia democratica occidentale, veniva segnalata con percentuali altissime, talvolta superiori al 90%, come testo generato dall’Intelligenza Artificiale. Questo paradosso storico ha trasformato l’incidente in un caso studio globale, evidenziando le limitazioni intrinseche della tecnologia di detection.

Per comprendere l’errore, è necessario analizzare come funzionano questi rilevatori. Essi non “leggono” il contenuto come farebbe un essere umano, comprendendo il tono o il contesto storico, ma si basano sull’analisi statistica di due metriche principali: la perplessità e la burstiness. La perplessità misura la complessità e l’imprevedibilità del testo: un punteggio basso suggerisce che la frase è altamente probabile e, quindi, “facile” da generare per un modello AI. La burstiness misura la variazione nella lunghezza e nella struttura delle frasi; la scrittura umana tende a essere irregolare, mentre l’AI, almeno nelle sue iterazioni iniziali, spesso produce un testo con una uniformità e una coerenza statistica eccessiva.

Il testo della Dichiarazione di Indipendenza, con la sua prosa solenne, la sua struttura cerimoniale e la sua precisione grammaticale tipica della retorica del XVIII secolo, ricade inaspettatamente proprio in questa trappola. La linguistica formale e prevedibile di un documento ufficiale e legalistico presenta un’uniformità e una mancanza di “casualità” o “slancio” emotivo personale che gli attuali modelli di AI detector sono addestrati a riconoscere come un segno distintivo della generazione automatica. Paradossalmente, ciò che è stato scritto da una delle menti più brillanti dell’epoca moderna con estrema cura e precisione, viene letto da un algoritmo come troppo perfetto e, quindi, artificiale.

Questo clamoroso errore solleva implicazioni etiche e pratiche estremamente serie, specialmente nel settore dell’istruzione e della ricerca. L’incidente della Dichiarazione di Indipendenza è la prova lampante dell’alto tasso di falsi positivi a cui sono soggetti questi strumenti. Vi è il rischio concreto e documentato che studenti o professionisti, autori di testi originali ma redatti con uno stile molto formale, tecnico o statisticamente “corretto,” vengano ingiustamente accusati di aver fatto ricorso all’IA.

La lezione che emerge con forza da questo dibattito è che i rilevatori di AI sono, nella migliore delle ipotesi, solo strumenti ausiliari basati su un calcolo probabilistico, non arbitri definitivi della verità. La loro affidabilità è costantemente messa in discussione, anche perché sono strutturalmente destinati a inseguire lo sviluppo dei modelli AI che tentano di identificare, rimanendo sempre un passo indietro. L’episodio della Dichiarazione di Indipendenza serve dunque come un monito per istituzioni e aziende: non si può affidare l’integrità della valutazione e della fiducia a una tecnologia che etichetta come falso un documento storico fondamentale, sottolineando la necessità di affiancare l’analisi algoritmica con il giudizio critico umano.