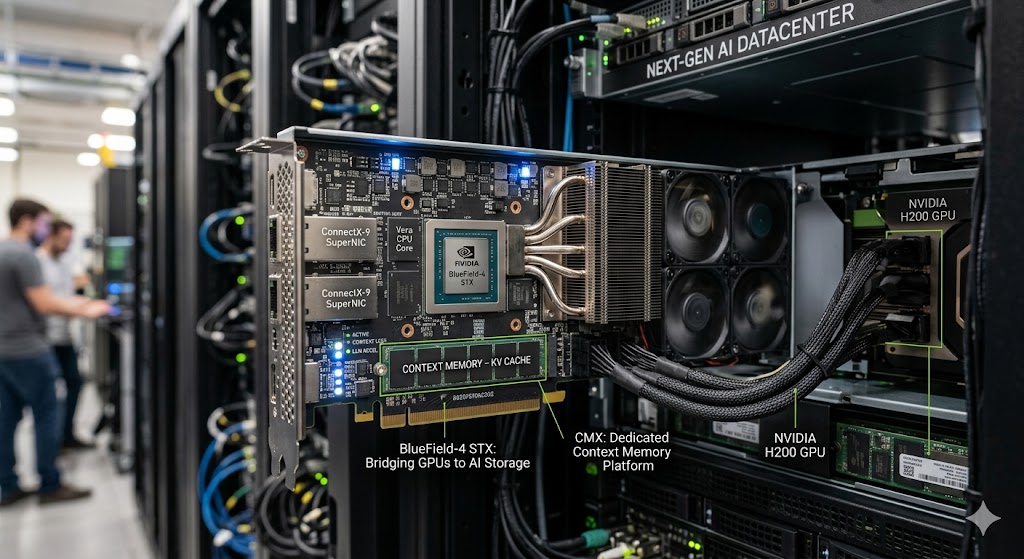

Il passaggio da modelli statici a sistemi agentici capaci di ragionamento multi-step ha messo in luce un collo di bottiglia strutturale che non risiede più soltanto nella potenza di calcolo pura delle GPU, ma nella capacità del sistema di gestire la persistenza e il recupero dei dati contestuali. La recente introduzione dell’architettura di riferimento NVIDIA BlueField-4 STX rappresenta una risposta ingegneristica precisa a questa sfida, proponendo l’inserimento di uno strato di memoria contestuale dedicato tra le unità di elaborazione grafica e lo storage tradizionale. Questo approccio mira a risolvere il problema della latenza nella gestione della cache key-value, ovvero l’insieme dei calcoli intermedi che un modello linguistico di grandi dimensioni deve conservare per evitare di ricalcolare l’intero contesto a ogni fase di inferenza. Quando un agente IA opera su sessioni prolungate o attraverso chiamate a strumenti esterni, la dimensione di questa cache cresce esponenzialmente, rendendo i percorsi di archiviazione convenzionali basati su CPU inadeguati a sostenere il throughput richiesto.

L’architettura BlueField-4 STX si basa sull’integrazione di processori ottimizzati per lo storage che combinano i core CPU Vera di NVIDIA con la tecnologia di rete ConnectX-9 SuperNIC. Il cuore dell’innovazione risiede nella creazione di una piattaforma denominata CMX, un sistema di archiviazione della memoria di contesto che estende virtualmente la memoria della GPU. Invece di costringere i dati a un lungo viaggio verso i dischi o attraverso i bus di sistema gestiti dalle CPU generiche, l’STX permette di mantenere la cache key-value in uno stato di alta disponibilità e bassa latenza. Questo spostamento di paradigma consente di ottenere incrementi prestazionali dichiarati fino a cinque volte nel throughput dei token e una velocità doppia nell’ingestione dei dati rispetto alle infrastrutture tradizionali. L’efficienza energetica risulta altrettanto impattante, con una riduzione dei consumi stimata in quattro volte, poiché l’elaborazione dei dati di storage viene scaricata dal processore centrale direttamente sull’unità di elaborazione dati programmabile.

Dal punto di vista del software, l’ecosistema viene supportato dall’espansione della piattaforma DOCA, che ora include il componente DOCA Memo. Questa aggiunta fornisce agli sviluppatori e ai fornitori di storage gli strumenti necessari per programmare e ottimizzare il comportamento dei processori BlueField-4 specificamente per i carichi di lavoro dell’intelligenza artificiale. La programmabilità è un elemento cruciale, poiché permette di adattare il livello di memoria contestuale alle esigenze specifiche di diversi modelli e flussi di lavoro agentici, garantendo che lo storage non sia più un’entità passiva ma una componente attiva e intelligente della fabbrica dell’IA. Attraverso questa sinergia tra hardware dedicato e software programmabile, NVIDIA sta definendo un nuovo standard per i data center di prossima generazione, dove la gestione della memoria di lavoro dell’IA diventa una funzione di rete e storage integrata.

L’impatto di questa tecnologia si estende a tutto l’ecosistema dei fornitori di infrastrutture, che stanno già adottando l’architettura STX per sviluppare sistemi di archiviazione nativi per l’IA. Grandi nomi del settore e fornitori di cloud specializzati vedono in questo strato di memoria contestuale il tassello mancante per scalare l’inferenza complessa a livello aziendale. Non si tratta più solo di possedere le GPU più veloci, ma di garantire che tali processori non rimangano inattivi in attesa dei dati. Con la disponibilità dei primi sistemi basati su questa architettura prevista per la seconda metà del 2026, il settore si prepara a una trasformazione dove lo storage smette di essere un semplice archivio di massa per diventare il supporto fondamentale della memoria operativa dell’intelligenza artificiale, permettendo agli agenti digitali di mantenere coerenza e velocità anche nelle operazioni più lunghe e articolate.