L’integrazione massiva di modelli linguistici di grandi dimensioni nella produttività quotidiana ha generato una risposta tecnologica reattiva basata sugli strumenti di AI detection, i quali tuttavia mostrano oggi limiti strutturali preoccupanti nel distinguere la prosa umana da quella sintetica. Questi software operano principalmente attraverso metriche probabilistiche note come perplessità e burstiness, analizzando quanto un testo sia prevedibile o monotono nella sua struttura sintattica.

Il problema fondamentale risiede nel fatto che gli studenti, specialmente quelli che seguono linee guida accademiche rigide o che scrivono in una lingua non nativa, tendono a produrre testi con un basso grado di perplessità, portando gli algoritmi a classificare erroneamente il lavoro originale come generato da macchine. Questa deriva tecnica sta trasformando gli strumenti di monitoraggio in fonti di “allucinazioni di rilevamento”, dove la regolarità grammaticale viene scambiata sistematicamente per un’impronta digitale algoritmica.

La fragilità di questi sistemi emerge con forza quando messi a confronto con diverse tipologie di scrittura tecnica o altamente formalizzata. Molti rilevatori di AI sono stati addestrati su dataset che non riflettono adeguatamente le sfumature della scrittura accademica autentica, la quale spesso richiede una precisione lessicale e una ripetitività di termini chiave che il software interpreta come segnali di generazione artificiale.

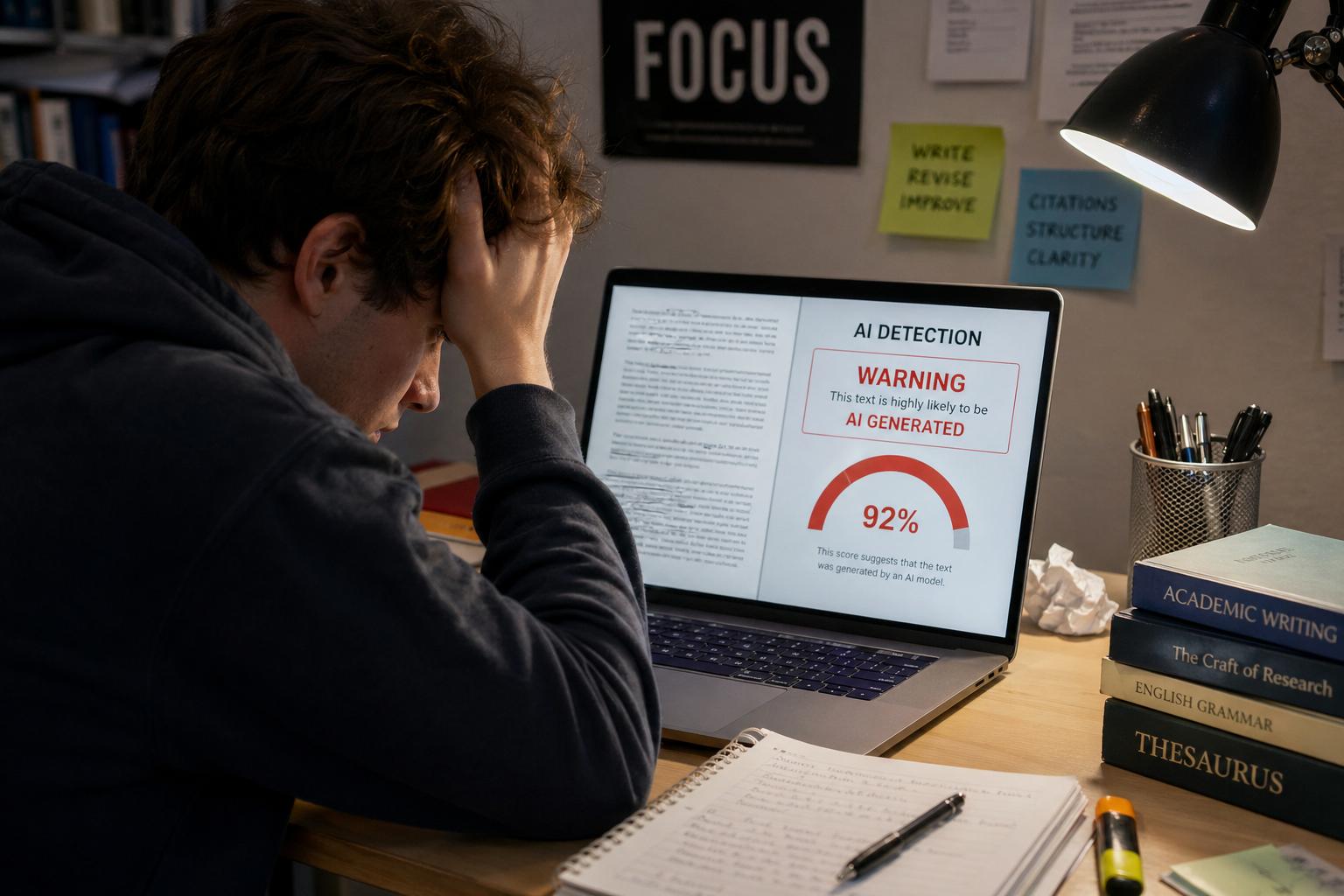

Di conseguenza, si sta verificando un fenomeno paradossale: più uno studente cerca di essere chiaro, strutturato e conforme ai requisiti formali di una consegna, più aumenta la probabilità che il suo elaborato venga segnalato come sospetto. Questo crea un ambiente di incertezza pedagogica in cui l’accuratezza del rilevamento è spesso paragonabile al caso, rendendo le sanzioni disciplinari basate esclusivamente su tali report tecnicamente indifendibili.

Un ulteriore livello di complessità tecnica riguarda l’incapacità dei rilevatori di adattarsi all’evoluzione dei modelli di linguaggio come GPT-4 o Claude, che sono ormai in grado di variare la propria “temperatura” e lo stile di scrittura per mimare la varianza umana. Mentre i modelli generativi diventano più sofisticati nel generare testi naturali, gli strumenti di rilevamento faticano a tenere il passo, rimanendo ancorati a euristiche che penalizzano la semplicità e la linearità del linguaggio umano.

Gli esperti del settore sottolineano che il tasso di falsi positivi è particolarmente elevato tra gli studenti non madrelingua, la cui scrittura, pur essendo originale, può risultare meno variata e più aderente a strutture standardizzate, venendo così ingiustamente etichettata come sintetica dai modelli di classificazione.