L’integrazione dell’intelligenza artificiale generativa all’interno di Google Foto sta trasformando la galleria multimediale da semplice archivio statico a ecosistema dinamico per la manipolazione dell’immagine personale. La nuova funzionalità ispirata al concetto di guardaroba virtuale non rappresenta soltanto un’aggiunta estetica, ma si fonda su un’architettura complessa che sfrutta la segmentazione semantica avanzata per identificare e isolare ogni singolo elemento del vestiario presente nelle immagini dell’utente. A differenza dei sistemi di riconoscimento oggetti tradizionali, questa tecnologia non si limita a etichettare un capo d’abbigliamento, ma esegue una mappatura volumetrica che ne estrae la texture, la cadenza del tessuto e le proprietà riflettenti, permettendo al software di comprendere come quel determinato materiale interagisce con la luce e con la postura del corpo umano registrata nello scatto originale.

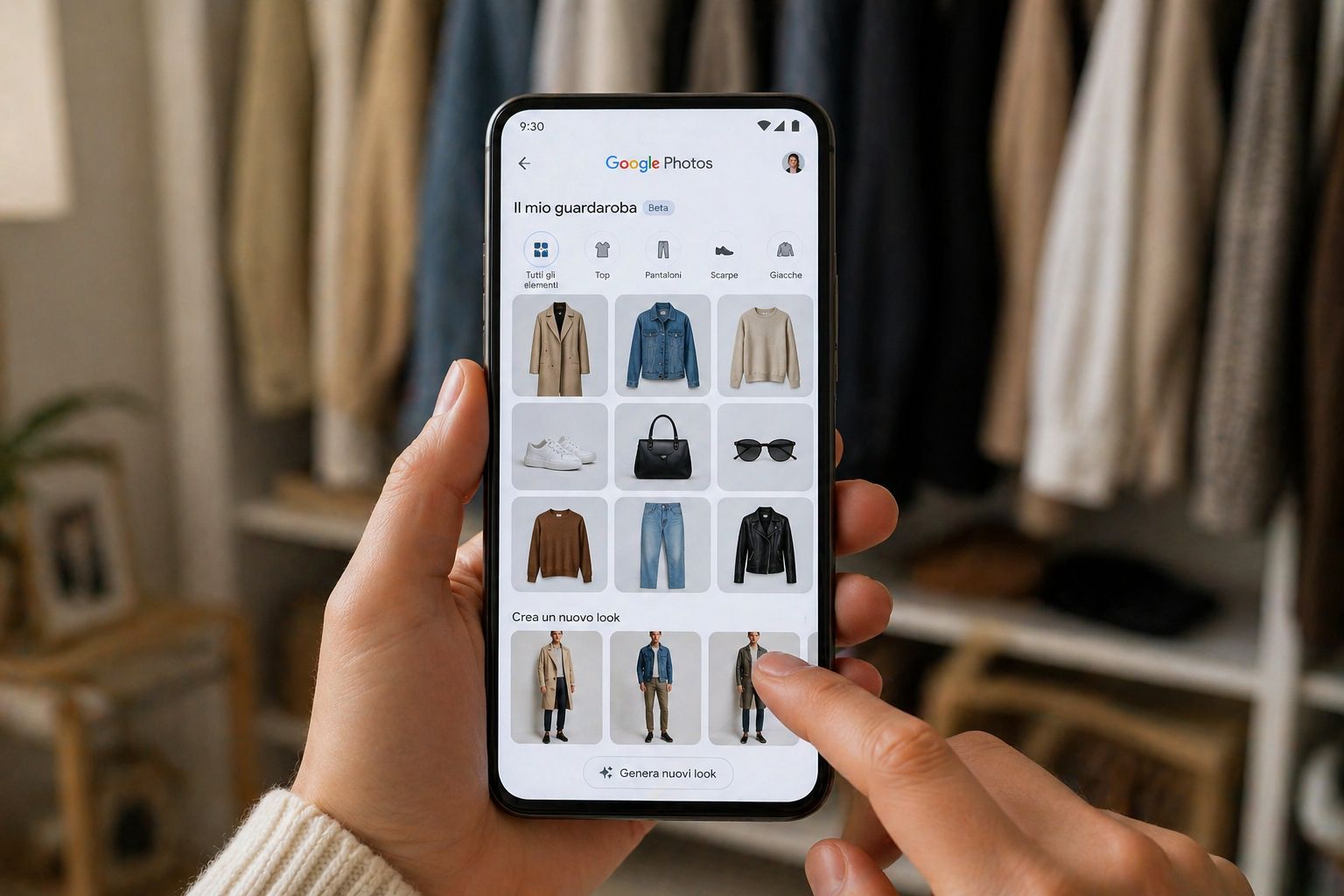

Il cuore di questa innovazione risiede nella capacità di Google di applicare modelli di diffusione latente per ricontestualizzare gli indumenti in ambienti digitali neutri o su nuovi modelli fisici. Questo processo richiede una precisione millimetrica nella gestione dei bordi e delle occlusioni: l’algoritmo deve infatti essere in grado di separare correttamente un cappotto da una camicia sottostante, mantenendo l’integrità visiva di entrambi gli elementi. Una volta digitalizzato, il capo d’abbigliamento cessa di essere un semplice insieme di pixel piatti per diventare un asset vettoriale arricchito da metadati stilistici. Questo passaggio permette all’utente di comporre outfit inediti attingendo dalla propria storia fotografica, superando i limiti della memoria visiva e automatizzando la catalogazione del proprio stile personale attraverso un’analisi silente e costante dei file caricati sul cloud.

Oltre alla pura componente di rendering, il sistema introduce un’intelligenza predittiva che analizza le abitudini estetiche dell’utente per suggerire abbinamenti basati sulla teoria del colore e sulla compatibilità delle forme. Questa analisi avviene attraverso una pipeline di elaborazione che bilancia il carico computazionale tra il dispositivo locale e l’infrastruttura server di Google. Mentre la fase di individuazione e ritaglio iniziale può essere gestita dalle unità di elaborazione neurale presenti negli smartphone moderni per garantire una risposta immediata, la generazione di anteprime ad alta fedeltà che simulano il “fitting” dei capi richiede la potenza di calcolo del cloud. Il risultato finale è un’interfaccia utente fluida che permette di visualizzare scenari ipotetici di vestizione con un realismo che fino a pochi anni fa era riservato esclusivamente alla post-produzione cinematografica professionale, segnando un punto di rotta definitivo verso l’uso dell’intelligenza artificiale come assistente quotidiano alla persona.