Nel dibattito contemporaneo sull’intelligenza artificiale, poche espressioni vengono utilizzate con la stessa frequenza di “human-in-the-loop”. La formula viene ormai presentata come garanzia implicita di sicurezza, responsabilità ed eticità dei sistemi AI, soprattutto nei contesti più delicati come istruzione, sanità, finanza, cybersecurity, sorveglianza e automazione decisionale. L’idea alla base del concetto è apparentemente semplice: un essere umano rimane all’interno del processo operativo dell’algoritmo, supervisionandone il comportamento e mantenendo il controllo finale sulle decisioni. Tuttavia, proprio questa apparente semplicità sta iniziando a essere messa fortemente in discussione.

La crescente diffusione di modelli generativi e sistemi agentici autonomi sta infatti mostrando come la presenza di un umano nel processo non rappresenti automaticamente una reale forma di controllo. In molti casi il cosiddetto “human-in-the-loop” rischia di diventare una struttura puramente simbolica, utilizzata soprattutto per trasferire responsabilità legali e reputazionali dagli algoritmi agli operatori umani, senza che questi ultimi possano realmente comprendere o governare il comportamento del sistema. Questo slittamento concettuale sta trasformando l’intera questione da problema tecnico a problema strutturale di governance dell’automazione intelligente.

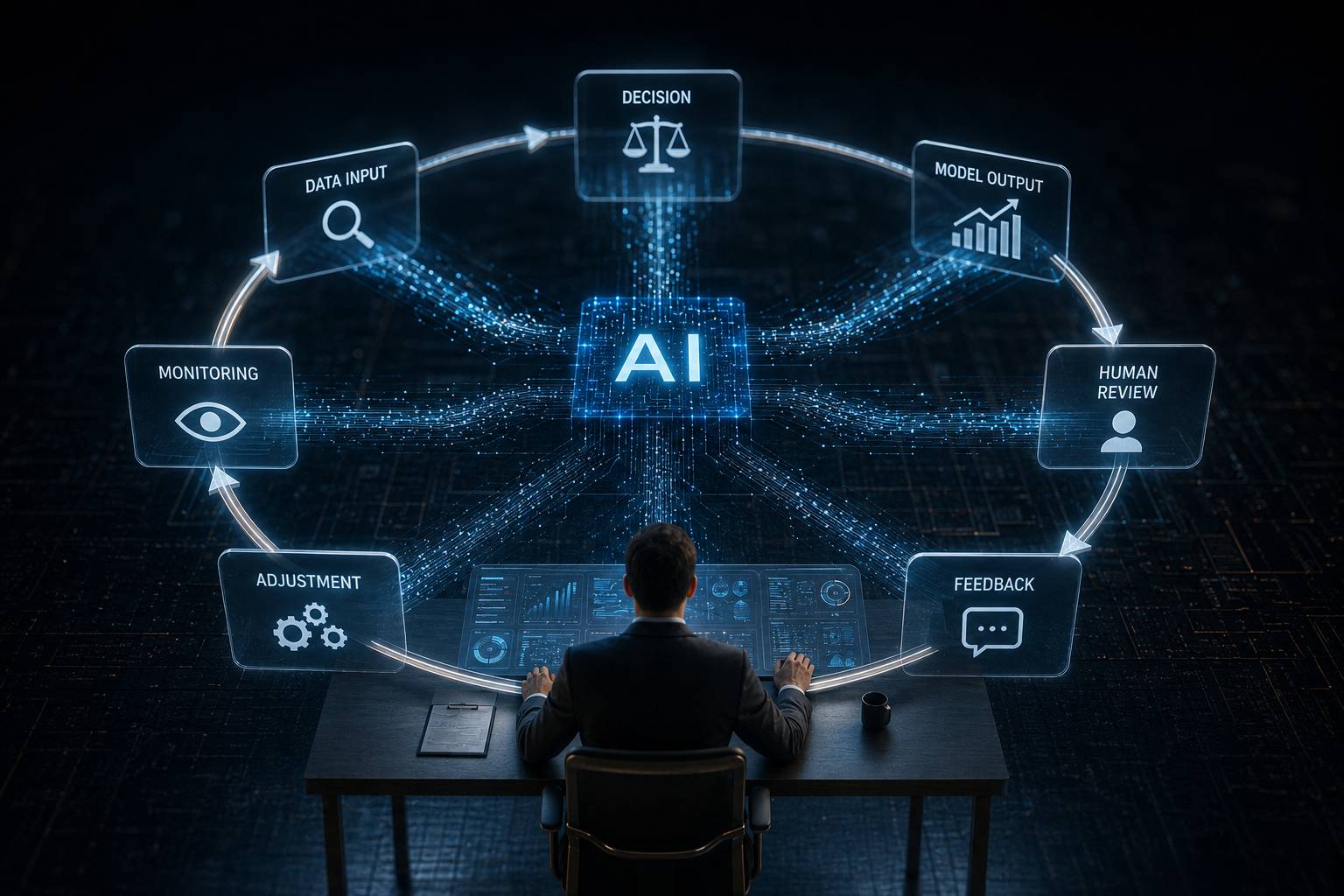

Storicamente il paradigma HITL nasce nel machine learning classico come metodologia operativa per migliorare accuratezza e qualità dei modelli. Gli esseri umani intervengono durante la fase di training, labeling, validazione o correzione degli output, fornendo feedback continui al sistema. Nei primi contesti applicativi questo approccio aveva un ruolo pragmatico ben definito: compensare i limiti statistici degli algoritmi e ridurre il rischio di errore in assenza di dataset sufficientemente completi. Nei sistemi di computer vision, elaborazione linguistica o classificazione documentale, l’intervento umano serviva principalmente a correggere ambiguità o casi eccezionali che il modello non riusciva a interpretare correttamente.

Con l’evoluzione dei large language models e dei sistemi agentici autonomi, però, il significato del termine si è progressivamente ampliato. Oggi il “human-in-the-loop” viene utilizzato come principio etico generale per rassicurare utenti, governi e aziende sul fatto che l’AI non operi completamente fuori controllo. Il problema è che questa rassicurazione si scontra con una realtà tecnica molto più complessa. In numerosi sistemi contemporanei, l’essere umano non controlla realmente il processo decisionale, ma interviene soltanto alla fine della catena operativa, spesso con tempi insufficienti, informazioni incomplete o impossibilità concreta di comprendere il ragionamento interno del modello.

Questo fenomeno emerge in modo particolarmente evidente nei sistemi AI ad alta automazione. Quando un algoritmo genera centinaia o migliaia di decisioni in tempi estremamente ridotti, il supervisore umano tende progressivamente a trasformarsi in semplice validatore passivo. Si crea così il fenomeno definito “automation bias”: l’operatore inizia ad assumere automaticamente che il sistema abbia ragione, limitandosi a confermare gli output senza reale analisi critica. Il paradosso è che la presenza dell’umano, teoricamente inserita per aumentare sicurezza e responsabilità, può finire per ridurre ulteriormente la qualità del controllo effettivo.

Nel settore educativo questa dinamica è già molto evidente. I nuovi sistemi AI utilizzati per correzione automatica, tutoring personalizzato e valutazione scolastica dichiarano spesso di mantenere il docente “nel loop”. In realtà, in numerosi casi, l’insegnante interviene soltanto nei casi che il modello stesso considera incerti o problematici. Questo significa che l’algoritmo decide autonomamente quali decisioni meritino supervisione umana e quali no. La conseguenza è un trasferimento implicito dell’autorità pedagogica dal docente al sistema statistico. Alcuni studi recenti sul tema dell’AI educativa parlano apertamente di rischio di “automated abdication”, cioè progressiva delega automatizzata delle responsabilità cognitive e decisionali agli algoritmi.

La questione diventa ancora più delicata nei contesti ad alto rischio come sanità, giustizia o sistemi militari autonomi. In teoria la presenza di un supervisore umano dovrebbe impedire decisioni dannose o non etiche. In pratica, però, la crescente complessità dei modelli rende sempre più difficile comprendere realmente perché un sistema abbia prodotto una determinata decisione. Il problema non riguarda soltanto la correttezza tecnica dell’output, ma la possibilità stessa di attribuire responsabilità morali e giuridiche. Se il supervisore umano non dispone degli strumenti cognitivi per comprendere il funzionamento del sistema, la sua presenza rischia di diventare puramente formale.

Un ulteriore elemento critico riguarda la cosiddetta “illusione di controllo”. Molte architetture AI moderne vengono progettate in modo tale da lasciare formalmente all’umano il potere di approvare o rifiutare le decisioni, ma all’interno di processi operativi talmente rapidi e complessi da rendere impossibile un controllo autentico. In questi casi l’essere umano diventa sostanzialmente un meccanismo di deresponsabilizzazione normativa: il sistema può essere definito “supervisionato” pur operando di fatto in autonomia quasi completa. Questo problema è particolarmente discusso anche nel settore della guida autonoma e delle armi intelligenti, dove la presenza teorica dell’operatore umano non sempre corrisponde a una reale capacità di intervento.

La discussione contemporanea si sta quindi spostando verso un paradigma molto più ampio: non basta più inserire un umano nel processo, ma occorre ridefinire completamente il rapporto tra persone e sistemi intelligenti. Alcuni ricercatori stanno proponendo il concetto di “human-machine teaming”, in cui uomo e AI collaborano come soggetti complementari anziché come semplice supervisore e macchina subordinata. Altri parlano invece di “society-in-the-loop”, cioè sistemi progettati non solo per rispondere a singoli operatori umani, ma per incorporare valori sociali, pluralismo culturale e meccanismi collettivi di governance.

Questa evoluzione teorica nasce anche da un problema sempre più evidente nei modelli linguistici avanzati: l’allineamento dei valori. I sistemi AI non sono neutrali; incorporano inevitabilmente bias culturali, politici, linguistici ed economici derivanti dai dati di addestramento, dalle scelte architetturali e dalle preferenze dei team di sviluppo. In questo contesto, la semplice supervisione umana non garantisce automaticamente imparzialità o correttezza etica. Anzi, se i supervisori operano all’interno dello stesso framework culturale che ha prodotto il modello, il rischio è la cristallizzazione di valori dominanti e la progressiva esclusione di prospettive minoritarie o divergenti.

L’intero concetto di “human-in-the-loop” sta quindi attraversando una trasformazione radicale. Da semplice metodologia tecnica per migliorare accuratezza e affidabilità dei modelli, sta diventando uno dei principali terreni di scontro filosofico, politico e normativo dell’intelligenza artificiale contemporanea. La domanda non è più soltanto se un umano debba restare nel processo decisionale, ma quale tipo di potere reale debba avere, quanto possa comprendere il sistema e fino a che punto sia possibile mantenere responsabilità autenticamente umane in ambienti dominati da automazione cognitiva avanzata.

Nel prossimo ciclo evolutivo dell’AI, il vero nodo non sarà probabilmente la capacità dei modelli di sostituire l’uomo, ma la progressiva difficoltà dell’uomo stesso nel mantenere una posizione realmente centrale all’interno di sistemi sempre più autonomi, opachi e cognitivamente superiori in domini specifici.