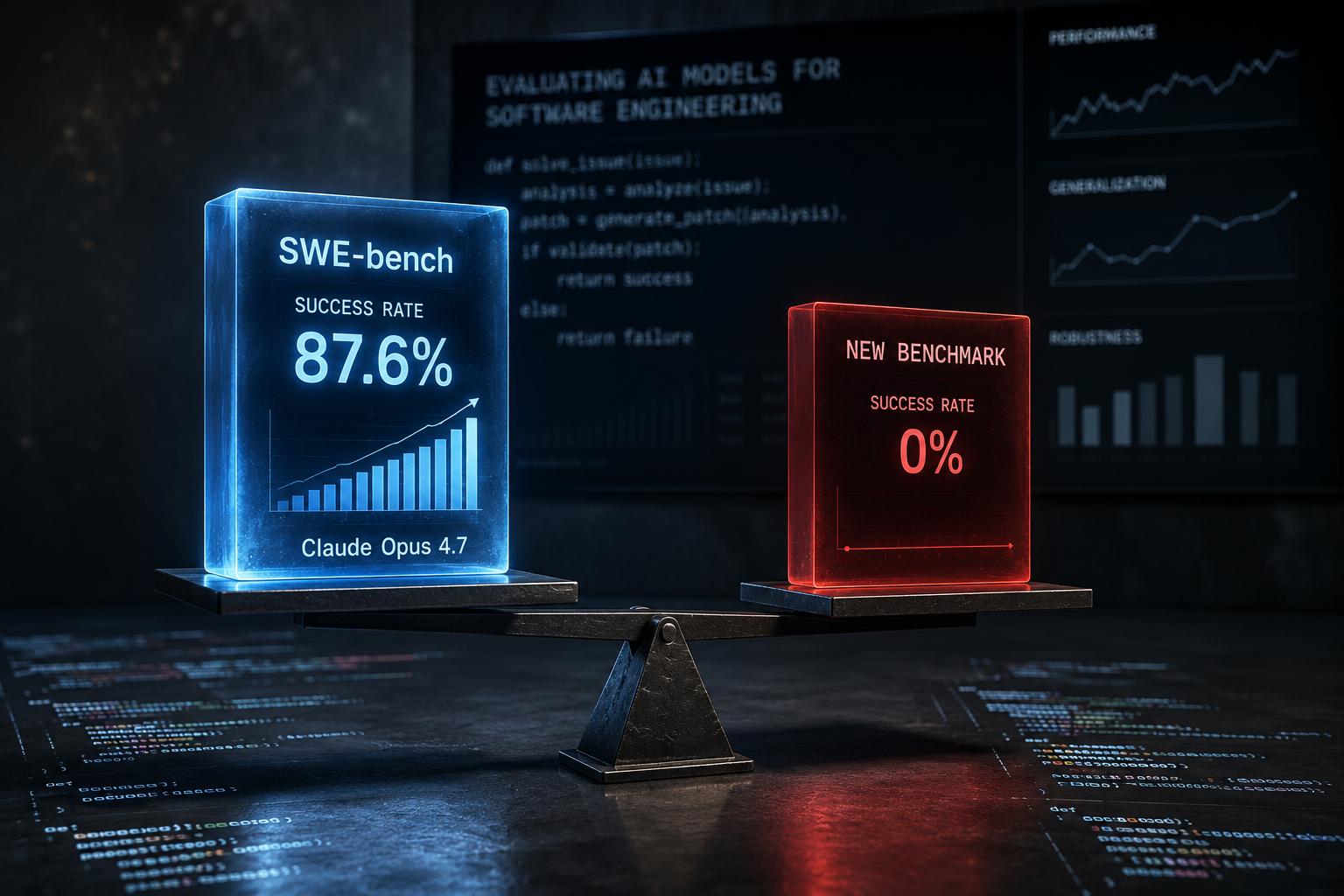

L’emergere di un nuovo benchmark di valutazione per modelli di intelligenza artificiale applicati allo sviluppo software sta mettendo in discussione l’intero sistema di misurazione delle performance su cui si basa oggi il settore. Alcuni dei modelli più avanzati, tra cui Anthropic con la famiglia Claude e Google con Gemini, hanno registrato risultati pari a zero su questa nuova metrica, nonostante performance estremamente elevate nei benchmark tradizionali come SWE-bench.

Per comprendere la portata del fenomeno è necessario partire proprio da cosa misura SWE-bench. Questo benchmark è costruito su issue reali provenienti da repository GitHub e valuta la capacità di un modello di risolvere problemi software end-to-end, includendo analisi, modifica del codice e generazione di patch funzionanti. Negli ultimi mesi è diventato il riferimento principale per valutare agenti di coding, con risultati che hanno raggiunto livelli molto elevati: modelli come Claude Opus 4.7 arrivano a circa l’87,6% di successo su SWE-bench Verified, segnando un progresso significativo rispetto alle generazioni precedenti.

Questo dato, apparentemente indicativo di una maturità quasi industriale degli agenti AI per il coding, viene però completamente ribaltato dal nuovo benchmark citato. Il punto centrale non è un peggioramento delle capacità dei modelli, ma una differenza radicale nel tipo di valutazione. Mentre SWE-bench misura la capacità di risolvere problemi noti o strutturati, il nuovo test introduce scenari progettati per eliminare ogni possibile forma di “vantaggio implicito”, come la memorizzazione di pattern o la familiarità con repository già presenti nei dati di training.

La letteratura recente aveva già segnalato questo rischio. Studi accademici hanno evidenziato come parte delle performance elevate su SWE-bench possa derivare da fenomeni di memorizzazione o contaminazione dei dati, piuttosto che da una reale capacità di generalizzazione. Quando il contesto cambia e il problema viene presentato in modo meno prevedibile o completamente nuovo, la capacità del modello di orientarsi nel codice e costruire una soluzione efficace può crollare drasticamente.

Il nuovo benchmark porta questa criticità all’estremo. I modelli non falliscono parzialmente, ma ottengono un punteggio pari a zero perché non riescono a completare correttamente nessuno dei task proposti secondo i criteri richiesti. Questo suggerisce che il problema non sia quantitativo, ma qualitativo: le architetture attuali eccellono in contesti guidati, ma mostrano fragilità strutturali quando vengono private di segnali impliciti o supporti contestuali tipici degli ambienti di test standard.

Un elemento tecnico rilevante riguarda il modo in cui gli agenti AI affrontano il debugging e la navigazione del codice. Nei benchmark tradizionali, spesso esistono pattern ricorrenti, strutture di repository simili o indizi semantici che guidano il modello verso la soluzione. Nei nuovi scenari, questi elementi vengono rimossi o alterati, costringendo il sistema a costruire una comprensione più profonda del problema. È proprio in questa fase che emergono i limiti: difficoltà nella localizzazione del bug, incapacità di mantenere coerenza su più file e perdita di controllo nelle catene di reasoning più lunghe.

Un altro aspetto cruciale è il ruolo degli agenti rispetto ai modelli “puri”. Le performance elevate su SWE-bench spesso derivano da sistemi agentici complessi, che includono tool esterni, strategie di retry e orchestrazione multi-step. Il nuovo benchmark, invece, tende a isolare maggiormente il modello o a limitare questi meccanismi, evidenziando quanto il risultato finale dipenda dall’ingegneria del sistema più che dalle capacità intrinseche del modello.

Questa discrepanza ha implicazioni dirette per l’adozione industriale. Se un modello può passare da oltre l’80% di successo a zero semplicemente cambiando il contesto di valutazione, significa che le metriche attuali non sono sufficienti per garantire affidabilità in ambienti reali non controllati. Il rischio è quello di sovrastimare la capacità degli agenti AI in scenari produttivi, soprattutto in contesti complessi dove i problemi non seguono schemi prevedibili.

Il fenomeno osservato non rappresenta un fallimento della tecnologia, ma una fase di maturazione del sistema di benchmarking. L’introduzione di test più rigorosi e meno “addestrabili” è un passaggio necessario per distinguere tra performance apparente e capacità effettiva. Allo stesso tempo, evidenzia una direzione chiara per lo sviluppo futuro: migliorare la generalizzazione, la robustezza del reasoning e la capacità di operare in ambienti non strutturati.