La diffusione delle applicazioni integrate all’interno degli assistenti basati su intelligenza artificiale rappresenta una delle evoluzioni più significative dell’ecosistema software contemporaneo. Con l’introduzione delle app in ChatGPT, l’interfaccia conversazionale diventa non solo uno strumento di dialogo con un modello linguistico, ma anche un punto di accesso a servizi digitali complessi che possono essere eseguiti direttamente nel corso della conversazione. Per comprendere il funzionamento di questo nuovo paradigma è necessario analizzare l’architettura tecnica che consente a un modello linguistico di interagire con applicazioni esterne, orchestrare operazioni software e restituire risultati all’interno della chat.

Alla base di questo sistema si trova una struttura a più livelli che collega tre componenti principali: il modello linguistico, le interfacce applicative e i servizi backend. Il modello linguistico svolge il ruolo di interprete della conversazione, analizzando il linguaggio naturale dell’utente e determinando quale operazione o servizio possa soddisfare la richiesta. Le applicazioni integrate rappresentano invece l’insieme di strumenti software che eseguono concretamente le operazioni richieste, mentre i servizi backend gestiscono i dati, i database e le logiche operative necessarie per completare le attività.

Quando un utente scrive una richiesta nella chat, il modello linguistico analizza il contenuto semantico del messaggio utilizzando tecniche di comprensione del linguaggio naturale. In questa fase il sistema identifica l’intenzione dell’utente, estrae eventuali parametri rilevanti e valuta se la richiesta possa essere soddisfatta attraverso una delle applicazioni disponibili. Se il modello rileva che un’app è adatta alla richiesta, attiva una procedura di integrazione che permette alla piattaforma di comunicare con il servizio esterno.

Questa comunicazione avviene attraverso interfacce di programmazione denominate API, acronimo di Application Programming Interface. Le API costituiscono un insieme di regole e protocolli che consentono a diversi sistemi software di scambiarsi informazioni in modo strutturato. Nel contesto delle applicazioni integrate in ChatGPT, l’API rappresenta il collegamento tra la piattaforma conversazionale e il backend dell’applicazione. Quando l’utente richiede un’azione specifica, il sistema invia una richiesta all’API dell’applicazione, che elabora i dati e restituisce una risposta alla piattaforma AI.

Un esempio tipico può riguardare un’applicazione progettata per gestire prenotazioni di servizi. Se un utente chiede all’assistente di trovare un professionista disponibile per un determinato lavoro domestico, il modello linguistico interpreta la richiesta e invia una chiamata API al sistema del marketplace. Il backend dell’applicazione analizza la richiesta, interroga il database dei professionisti disponibili e restituisce un elenco di risultati. Questi dati vengono poi integrati nella risposta del modello linguistico e presentati all’utente all’interno della conversazione.

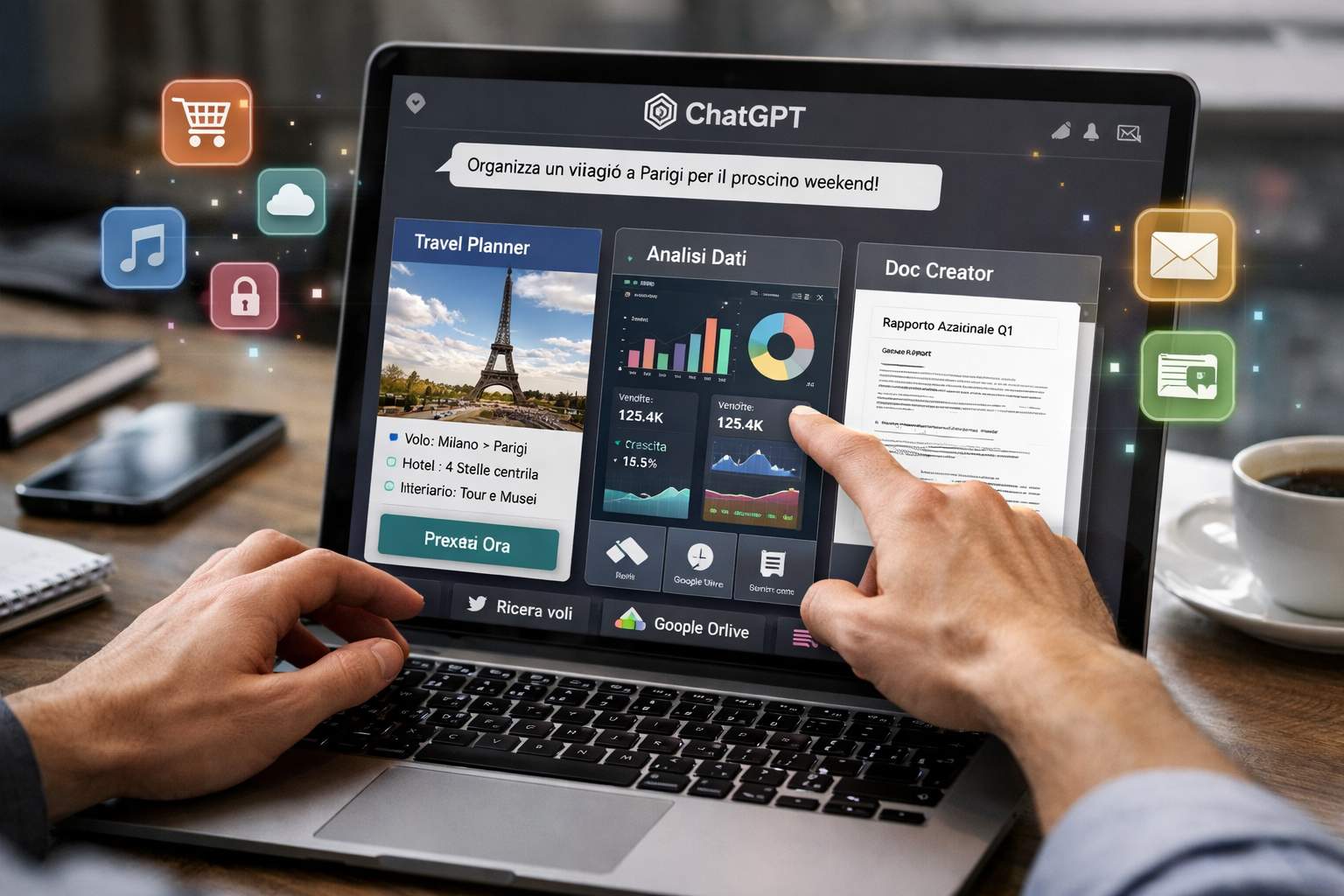

Uno degli aspetti più interessanti di questa architettura è il modo in cui il modello linguistico agisce come orchestratore delle operazioni software. Invece di limitarsi a generare testo, il sistema può coordinare diverse azioni sequenziali, collegando più servizi digitali tra loro. In un’unica conversazione l’utente può quindi richiedere informazioni, analizzare dati e avviare operazioni reali attraverso applicazioni esterne.

Questo comportamento è reso possibile grazie all’integrazione tra modelli linguistici e sistemi di agenti software. Gli agenti rappresentano componenti che permettono al modello di pianificare e gestire sequenze di azioni più complesse rispetto a una semplice risposta testuale. Un agente può decidere di interrogare un database, eseguire un calcolo, generare un documento o inviare una richiesta a un servizio esterno. Ogni operazione diventa un passaggio di un processo più ampio che porta al completamento del compito richiesto dall’utente.

Dal punto di vista tecnico, le applicazioni integrate possono includere anche componenti di interfaccia grafica. Oltre alle risposte testuali, alcune app sono in grado di generare elementi visivi interattivi come tabelle, moduli di input, grafici o pannelli informativi. Questi componenti permettono agli utenti di interagire con i dati restituiti dall’applicazione senza uscire dall’ambiente conversazionale. La chat diventa così una sorta di piattaforma applicativa ibrida, in cui la conversazione si combina con elementi tipici delle interfacce software tradizionali.

Un altro elemento fondamentale dell’architettura riguarda la gestione del contesto. I modelli linguistici mantengono memoria delle informazioni presenti nella conversazione e possono utilizzarle per migliorare l’interazione con le applicazioni. Se un utente sta pianificando un progetto o analizzando dati complessi, il sistema può utilizzare il contesto della conversazione per completare automaticamente parametri mancanti o suggerire operazioni successive. Questo meccanismo riduce il numero di passaggi necessari per completare un’attività e rende l’interazione più naturale.

La sicurezza rappresenta un aspetto particolarmente importante in questo tipo di integrazione. Quando una piattaforma conversazionale interagisce con servizi esterni, è necessario garantire che le informazioni sensibili siano protette e che le applicazioni non possano accedere a dati non autorizzati. Per questo motivo i sistemi di integrazione includono generalmente meccanismi di autenticazione, autorizzazione e controllo delle richieste API. In molti casi gli utenti devono autorizzare esplicitamente l’accesso ai propri dati prima che un’applicazione possa utilizzarli.

Un ulteriore livello di complessità riguarda la gestione dell’affidabilità delle applicazioni integrate. Poiché il modello linguistico può attivare servizi esterni in modo dinamico, la piattaforma deve garantire che le applicazioni funzionino correttamente e restituiscano dati coerenti. Questo richiede sistemi di monitoraggio e validazione delle risposte, in grado di individuare errori o comportamenti anomali.

Dal punto di vista dell’evoluzione tecnologica, le applicazioni integrate in ChatGPT rappresentano un passo verso la creazione di ecosistemi software guidati dall’intelligenza artificiale. Invece di navigare tra numerose applicazioni indipendenti, gli utenti possono utilizzare una singola interfaccia conversazionale capace di coordinare diversi servizi digitali. Questo modello ricorda, in parte, il funzionamento dei sistemi operativi, in cui diverse applicazioni vengono eseguite all’interno di un ambiente unificato.

Molti analisti del settore ritengono che questo paradigma possa cambiare profondamente il modo in cui viene sviluppato e distribuito il software. Se le piattaforme AI diventeranno il principale punto di accesso ai servizi digitali, le applicazioni potrebbero essere progettate sempre più come moduli integrabili all’interno di ambienti conversazionali. In questo scenario il ruolo dell’intelligenza artificiale non sarà soltanto quello di generare contenuti o rispondere a domande, ma anche quello di orchestrare l’interazione tra utenti, dati e servizi digitali.

L’evoluzione delle app integrate in ChatGPT rappresenta quindi uno dei segnali più evidenti della trasformazione in corso nel settore software. L’interfaccia conversazionale, un tempo considerata un semplice strumento di assistenza, sta progressivamente assumendo il ruolo di piattaforma operativa capace di coordinare attività digitali complesse. Con l’espansione di questo ecosistema, la conversazione con un assistente AI potrebbe diventare sempre più spesso il punto di partenza per svolgere operazioni che fino a pochi anni fa richiedevano l’utilizzo di numerose applicazioni separate.