La recente chiusura di un round di finanziamento da 10,3 miliardi di dollari per la nuova impresa tecnologica guidata da Yann LeCun segna l’inizio di una fase industriale focalizzata sul superamento dei limiti intrinseci dei modelli linguistici di grandi dimensioni. L’obiettivo tecnico della startup non è il perfezionamento della generazione testuale probabilistica, bensì la costruzione di sistemi basati su “World Models”, ovvero modelli del mondo capaci di apprendere le leggi della fisica e la causalità attraverso l’osservazione e l’interazione spaziale. Questo massiccio afflusso di capitale riflette la scommessa del settore su un cambio di paradigma architettonico che punta a dotare l’intelligenza artificiale di una forma di senso comune e di capacità di pianificazione a lungo termine, elementi che finora sono rimasti preclusi alle architetture basate esclusivamente sulla predizione del token successivo.

Al centro della strategia di ricerca si trova l’architettura Joint-Embedding Predictive Architecture, comunemente nota come JEPA, che rappresenta l’alternativa di LeCun ai modelli generativi tradizionali. A differenza dei sistemi che tentano di ricostruire ogni singolo pixel o dettaglio irrilevante di un’immagine o di un video, il framework JEPA opera in uno spazio latente astratto. Questo approccio permette alla macchina di ignorare il rumore visivo imprevedibile e di concentrarsi sulla struttura semantica della realtà. In termini ingegneristici, ciò significa sviluppare algoritmi che non “generano” la realtà, ma che “predicono” le rappresentazioni degli stati futuri del mondo. Tale distinzione è fondamentale per l’efficienza computazionale e per la capacità del sistema di comprendere che, se un oggetto viene lasciato cadere, esso cadrà verso il basso indipendentemente dalla texture dello sfondo.

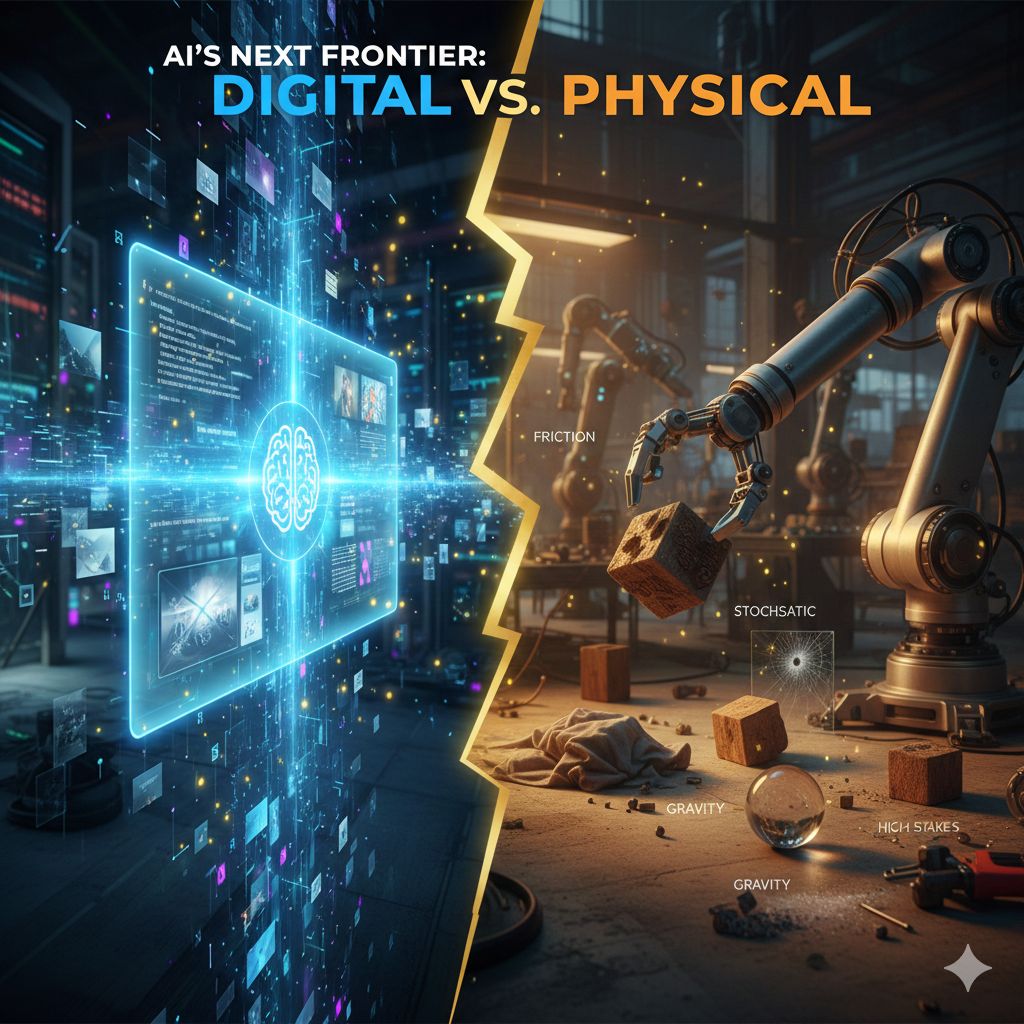

L’impiego dei fondi sarà destinato in gran parte alla creazione di una vastissima infrastruttura di calcolo necessaria per l’addestramento auto-supervisionato su video non annotati. L’apprendimento per osservazione video è considerato il passaggio cruciale per permettere all’intelligenza artificiale di acquisire una comprensione tridimensionale e temporale dell’ambiente. Mentre il testo è una rappresentazione discreta e semplificata della conoscenza umana, i dati video contengono una densità di informazioni fisiche che può istruire il modello sulla gravità, sulla permanenza degli oggetti e sulle interazioni meccaniche. La startup intende scalare queste architetture per creare un nucleo di intelligenza che possa essere successivamente integrato in sistemi robotici avanzati o in assistenti digitali capaci di ragionare su problemi logistici complessi che richiedono una percezione corretta dello spazio e del tempo.

Oltre alla pura potenza di calcolo, la sfida tecnica risiede nella progettazione di una gerarchia di astrazioni che consenta al modello di pianificare a diversi livelli di risoluzione temporale. Un sistema di questo tipo deve essere in grado di visualizzare un obiettivo finale, come il montaggio di un mobile, e scomporlo in una sequenza coerente di azioni fisiche, prevedendo le conseguenze di ogni movimento prima ancora di eseguirlo. Questo processo di simulazione interna è ciò che definisce un “World Model”. Il finanziamento record permetterà di reclutare i massimi esperti in visione artificiale, controllo robotico e neuroscienze computazionali per risolvere il problema dell’incertezza nelle predizioni a lungo termine, garantendo che i modelli rimangano stabili e accurati anche quando devono immaginare scenari futuri distanti nel tempo.