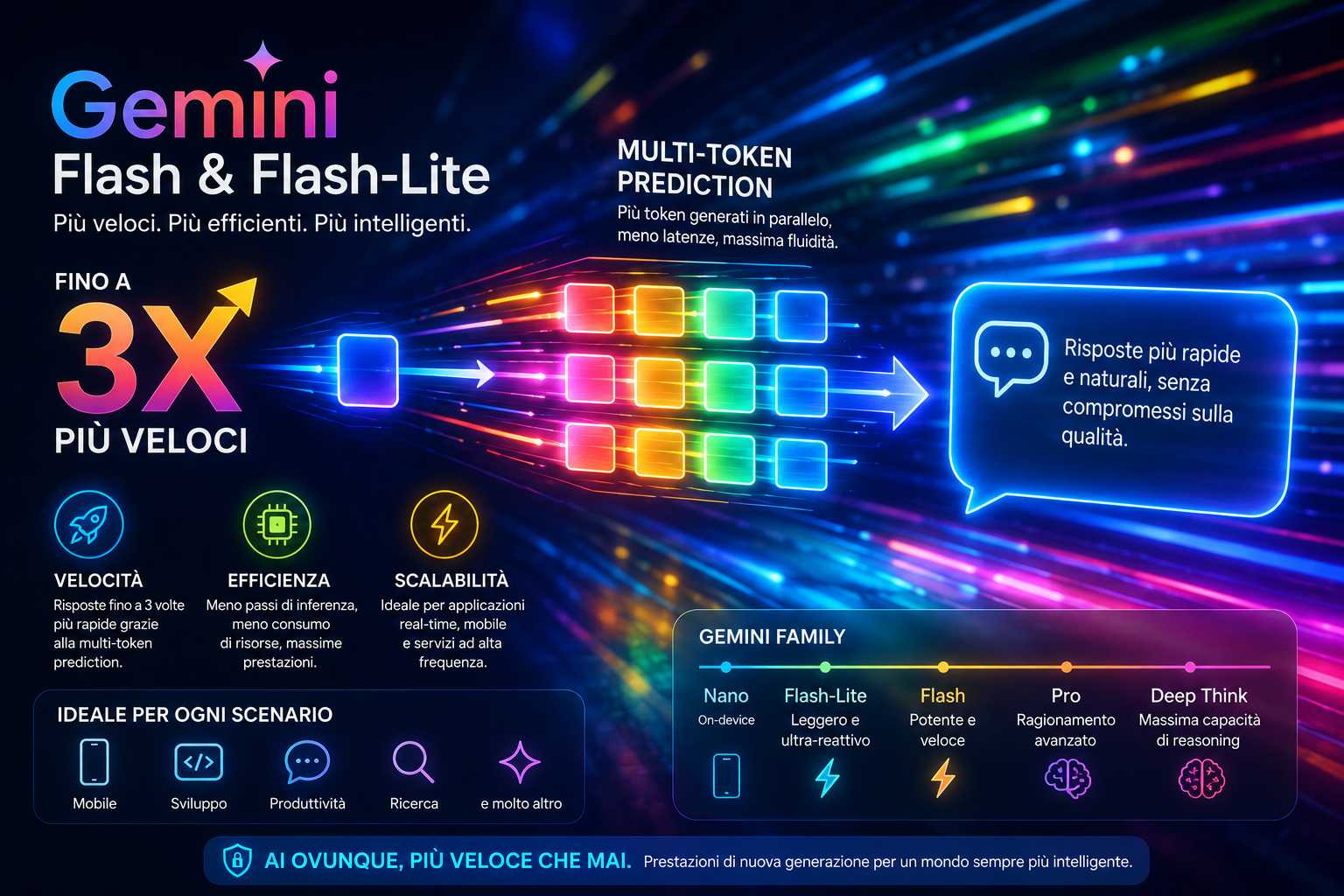

L’aggiornamento più recente della famiglia Gemini introduce un cambiamento tecnico rilevante nei modelli di dimensioni ridotte, in particolare nelle varianti Flash e Flash-Lite. Il miglioramento dichiarato, pari a un aumento di velocità fino a tre volte, non deriva da un semplice incremento della potenza computazionale, ma da una modifica nel paradigma di generazione del testo: l’introduzione della multi-token prediction.

Tradizionalmente, i modelli linguistici generano una risposta token per token, in modo sequenziale. Questo approccio, pur essendo robusto e controllabile, rappresenta uno dei principali colli di bottiglia in termini di latenza. Ogni nuovo token richiede un ciclo completo di inferenza, con un costo computazionale proporzionale alla lunghezza della risposta. La multi-token prediction interviene proprio su questo punto, consentendo al modello di prevedere più token in parallelo all’interno di un singolo passo di inferenza. Questo riduce drasticamente il numero di iterazioni necessarie per completare una risposta e, di conseguenza, il tempo totale di generazione.

Nel caso dei modelli Gemini più piccoli, questa innovazione ha un impatto amplificato. A differenza dei modelli di grandi dimensioni, che possono compensare la latenza con maggiore capacità di calcolo distribuita, i modelli compatti devono ottimizzare ogni fase del processo di inferenza per rimanere competitivi. L’adozione della multi-token prediction consente di superare uno dei limiti strutturali di questi sistemi, permettendo di ottenere prestazioni significativamente più rapide senza aumentare proporzionalmente il consumo di risorse.

Questo miglioramento si inserisce in una strategia più ampia di Google orientata a rendere i modelli “small” sempre più centrali nell’ecosistema AI. Le varianti Flash e Flash-Lite sono progettate per operare in contesti ad alta frequenza di richieste, come applicazioni mobile, strumenti di produttività e servizi integrati nei prodotti Google. In questi scenari, la latenza percepita è un fattore critico: anche differenze di pochi centesimi di secondo possono influenzare l’esperienza utente e la scalabilità del sistema.

La multi-token prediction introduce nuove complessità: generare più token contemporaneamente richiede una maggiore capacità del modello di mantenere coerenza semantica tra le predizioni, evitando errori cumulativi o incoerenze sintattiche. Questo implica un affinamento delle tecniche di training e di decoding, con meccanismi in grado di bilanciare velocità e qualità. Il fatto che l’incremento di performance sia stato ottenuto senza un degrado significativo dell’accuratezza indica un progresso nella gestione di questo trade-off.

Un altro elemento rilevante riguarda l’efficienza della memoria. I modelli di piccole dimensioni sono spesso limitati non solo dalla potenza di calcolo, ma anche dalla capacità di gestire contesti lunghi e complessi. L’ottimizzazione della generazione consente di ridurre il carico complessivo sull’infrastruttura, liberando risorse che possono essere riutilizzate per migliorare altri aspetti, come la gestione del contesto o l’integrazione con sistemi esterni.

Questo aggiornamento rafforza anche il posizionamento dei modelli Flash all’interno della gamma Gemini. Mentre le versioni Pro e Deep Think sono orientate a compiti complessi e reasoning avanzato, i modelli Flash rappresentano il livello operativo, progettato per offrire risposte rapide e affidabili su larga scala. L’aumento di velocità non è quindi solo un miglioramento tecnico, ma una leva strategica per estendere l’utilizzo dell’AI in scenari real-time.

Inoltre, l’evoluzione dei modelli piccoli si collega direttamente alla diffusione dell’AI on-device. Soluzioni come Gemini Nano e le varianti Lite sono pensate per funzionare direttamente su dispositivi locali, riducendo la dipendenza dal cloud e migliorando la privacy e la reattività. In questo contesto, ogni ottimizzazione della latenza diventa fondamentale, perché incide direttamente sulla fattibilità dell’esecuzione in ambienti con risorse limitate.