L’integrazione tra Google e Samsung ha recentemente segnato il passaggio definitivo dall’intelligenza artificiale puramente consultiva a quella “agentica”, ovvero capace di agire autonomamente all’interno dell’ecosistema software dello smartphone. Il debutto della funzione di automazione delle applicazioni, attualmente in fase beta sulla serie Samsung Galaxy S26 Ultra, rappresenta un cambiamento di paradigma tecnico: l’assistente Gemini 3 non si limita più a fornire informazioni o a generare testi, ma assume il controllo dell’interfaccia utente per eseguire flussi di lavoro multi-step che prima richiedevano l’intervento manuale del proprietario. Questa capacità si basa su un’architettura che permette all’IA di interpretare il linguaggio naturale e tradurlo in una sequenza di comandi operativi diretti verso le API e le interfacce delle applicazioni installate.

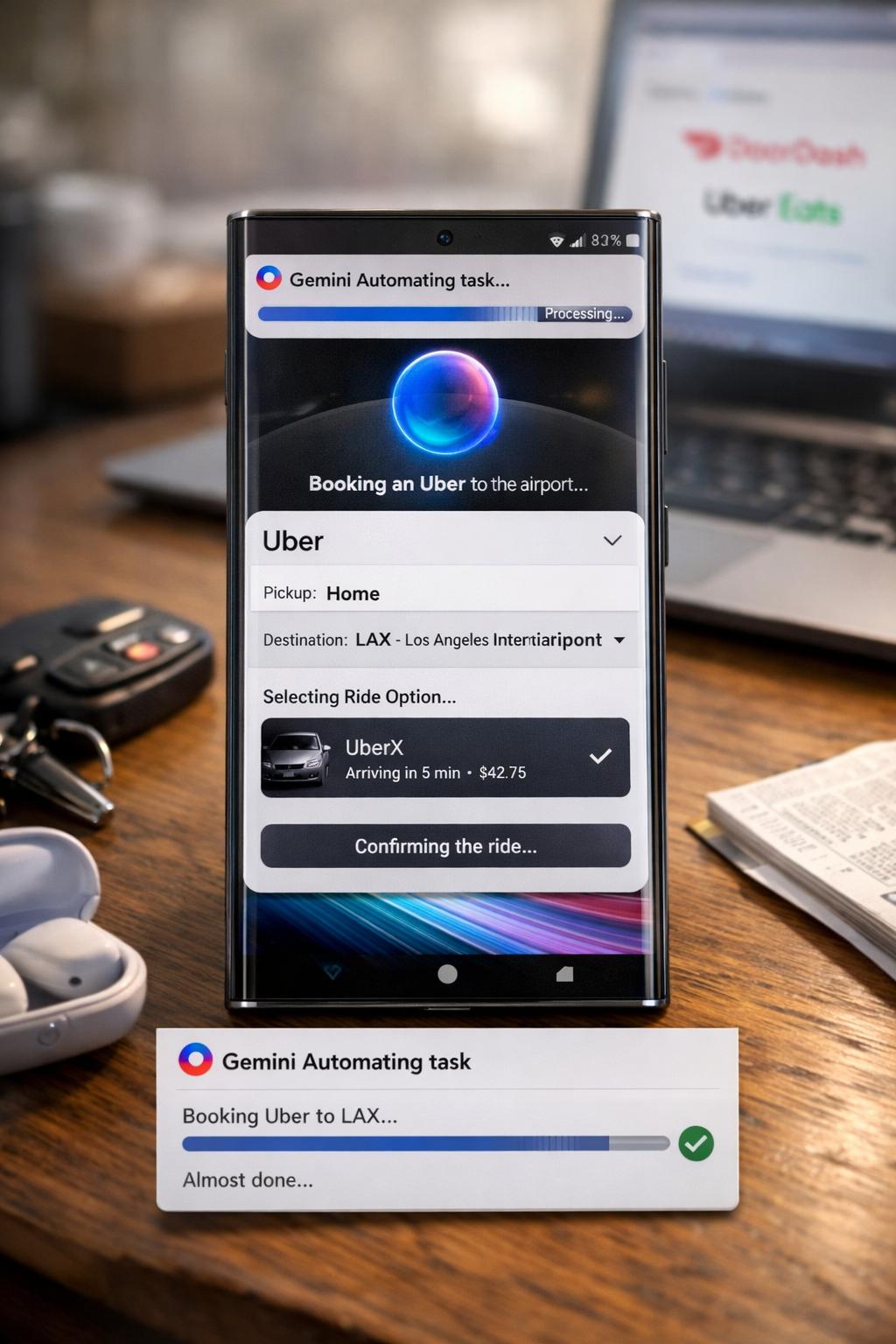

Dal punto di vista dell’esecuzione, il sistema opera attraverso una finestra virtuale sicura che viene generata in background, consentendo a Gemini di navigare nei menu, compilare campi di testo e selezionare opzioni senza interrompere l’attività principale dell’utente. Durante i test condotti su task comuni, come la prenotazione di un servizio di trasporto tramite Uber o l’ordinazione di pasti su piattaforme come DoorDash e Uber Eats, l’IA ha dimostrato una sofisticata comprensione del contesto. Ad esempio, nel richiedere un tragitto verso l’aeroporto, il modello è in grado di identificare la necessità di chiarire l’aeroporto di destinazione, inserire i dati mancanti e saltare passaggi ridondanti, come la scelta della compagnia aerea, ottimizzando il percorso di navigazione interno all’app. L’intero processo è monitorabile in tempo reale tramite una barra di avanzamento nelle notifiche, che permette all’utente di visualizzare i progressi o di intervenire manualmente in qualsiasi momento.

La sicurezza e il controllo dell’utente rimangono i pilastri di questa implementazione sperimentale. Nonostante l’agente IA sia in grado di gestire l’intera transazione, il sistema è volutamente limitato per impedire il completamento automatico di pagamenti o ordini definitivi senza un’esplicita conferma umana. Questa barriera di sicurezza garantisce che l’automazione rimanga uno strumento di assistenza e non un rischio finanziario, richiedendo un tocco finale o un’autenticazione biometrica prima del “checkout”. Inoltre, l’attuale supporto è circoscritto a categorie di applicazioni specifiche, come il food delivery, il ridesharing e la spesa alimentare (con partner come Walmart e Starbucks), dove i flussi di lavoro sono altamente strutturati e dunque meno soggetti a errori di interpretazione da parte del modello linguistico.

Tecnicamente, questa evoluzione è resa possibile dalle nuove “AppFunctions” di Android, un set di strumenti che permette a Gemini di interfacciarsi con le funzioni core delle app di terze parti in modo standardizzato. Sfruttando la potenza di calcolo on-device del chip Snapdragon 8 Gen 5 e l’efficienza dei modelli Gemini 3, il dispositivo è in grado di processare le richieste con una latenza minima, garantendo una fluidità d’uso che trasforma lo smartphone in un vero e proprio collaboratore operativo. Mentre l’industria ha teorizzato per anni la figura dell’assistente digitale onnisciente, l’implementazione sui dispositivi della serie S26 e l’imminente arrivo sulla linea Pixel 10 suggeriscono che il futuro della telefonia mobile risieda nella capacità dei dispositivi di gestire la complessità digitale per conto dell’uomo, riducendo drasticamente il numero di interazioni necessarie per compiere le attività quotidiane.