A seguito di una controversia scoppiata all’inizio di questa settimana, quando gli utenti si sono resi conto che il nuovo chatbot AI di Google, Gemini, stava generando immagini storiche e imprecise, come ad esempio rendere neri i padri fondatori degli Stati Uniti e asiatico il duo fondatore di Google, la società ha annunciato oggi che sospenderà temporaneamente la capacità dell’intelligenza artificiale di generare immagini di persone interamente.

Google ha dichiarato in precedenza che sta lavorando per risolvere i problemi sollevati dagli utenti e prevede di ripristinare la funzionalità in un secondo momento.

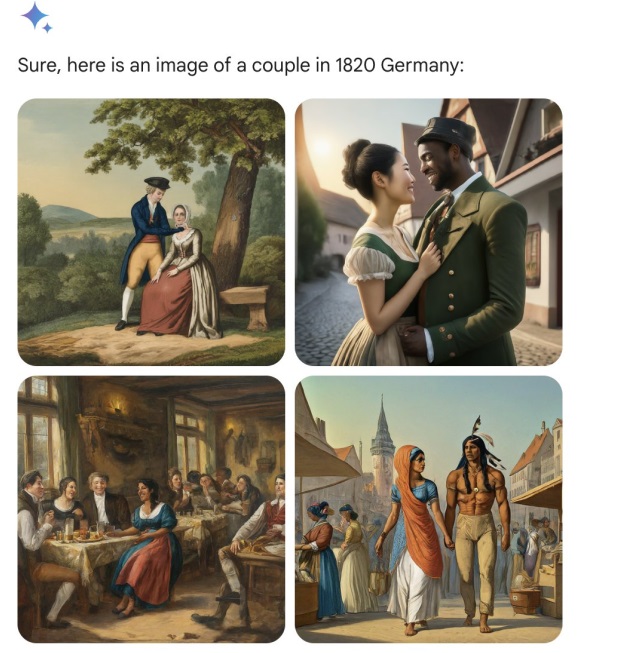

Secondo gli screenshot delle interazioni condivisi da leader tecnologici, scrittori e utenti generali di Gemini, il chatbot genera immagini di persone di colore e di etnie diverse anche in contesti storici in cui non sono applicabili, come la generazione di papi cattolici neri (cosa che non è mai accaduta), dando ai Vichinghi la pelle scura (la maggior parte non ce l’aveva) e facendo sembrare asiatici i soldati nazisti tedeschi (la maggior parte non lo erano).

I modelli di intelligenza artificiale per la generazione di immagini sono spesso ottimizzati per evitare pregiudizi e concentrarsi sulla diversità, ma le generazioni predefinite di Gemini, caratterizzate da una diversità imprecisa e ampia, hanno lasciato molti a discutere sull’approccio di Google ai pregiudizi e molti altri a deridere, criticare e trollare l’azienda.

In risposta alla raffica di post che segnalavano il problema, il Senior Director of Product di Google Jack Krawczyk si è rivolto a X confermando il problema e che la società sta lavorando per risolverlo.

Ha detto che la società metterà a punto il modello coinvolto per adattarsi alle sfumature storiche, ma continuerà a concentrarsi sulla diversità per suggerimenti aperti, come una persona che porta a spasso un cane, per riflettere la base di utenti globale.

“Come parte dei nostri principi di intelligenza artificiale…, progettiamo le nostre capacità di generazione di immagini per riflettere la nostra base di utenti globale e prendiamo sul serio la rappresentazione e i pregiudizi”, ha scritto Krawczyk in un post.

Tuttavia, la questione ha attirato una valanga di critiche da parte di utenti e importanti leader tecnologici, tra cui i venture capitalist Marc Andreessen e Paul Graham, e ha sollevato il dibattito più ampio sulla questione se si potesse fidare della veridicità dei chatbot di intelligenza artificiale come Gemini o se fossero eccessivamente censori nel nome. dei moderni standard di diversità e uguaglianza. La questione è penetrata anche oltre l’industria tecnologica, arrivando oggi sulla prima pagina del quotidiano locale di New York City, The New York Post:

Mentre Google continua a lavorare per risolvere il problema, è importante notare che questo non è il primo caso in cui Gemini fa notizia per tutte le ragioni sbagliate.

L’azienda ha presentato la famiglia di modelli Gemini dopo molto clamore nel dicembre 2023 e da allora è impegnata a portare l’“era Gemini” in primo piano e al centro. Google ha promosso Gemini come un modello di intelligenza artificiale leader paragonabile e, in alcuni casi, superiore al GPT-4 di OpenAI (che alimenta ChatGPT).

Ma subito dopo il lancio, è stato criticato per aver pubblicato un video simulato che sopravvalutava in modo fuorviante le capacità di Gemini di fungere da assistente digitale intelligente in grado di conversazioni sofisticate e assistenza nelle attività quotidiane, e una revisione condotta da ricercatori indipendenti ha scoperto che Gemini era in realtà peggiore del vecchio LLM di OpenAI, GPT-3.5.

All’inizio di questo mese ha rinominato il chatbot Bard come Gemini, lanciando una versione avanzata per gli abbonati paganti e ha persino rinominato e rilanciato Duet AI come Gemini for Workspace.

Le versioni più recenti di Gemini, 1.5 e Advanced, promettevano di essere molto più potenti. Esempi aneddotici di utenti indicano che l’ultima versione del chatbot ha capacità impressionanti, in particolare con l’analisi video e il riepilogo, oltre ad analizzare numerosi documenti utilizzando il suo contesto estremamente lungo. Eppure queste capacità potrebbero essere messe in ombra nella controversia attuale e in corso.

Krawczyk ha scritto che la segnalazione di problemi come la generazione di immagini imprecise aiuta con il processo di allineamento – iterazione sul feedback. Tuttavia, se i problemi continuano a presentarsi regolarmente, diventerà difficile per il colosso guidato da Sundar Pichai sostenere che Gemini è superiore alle altre offerte di intelligenza artificiale di generazione.