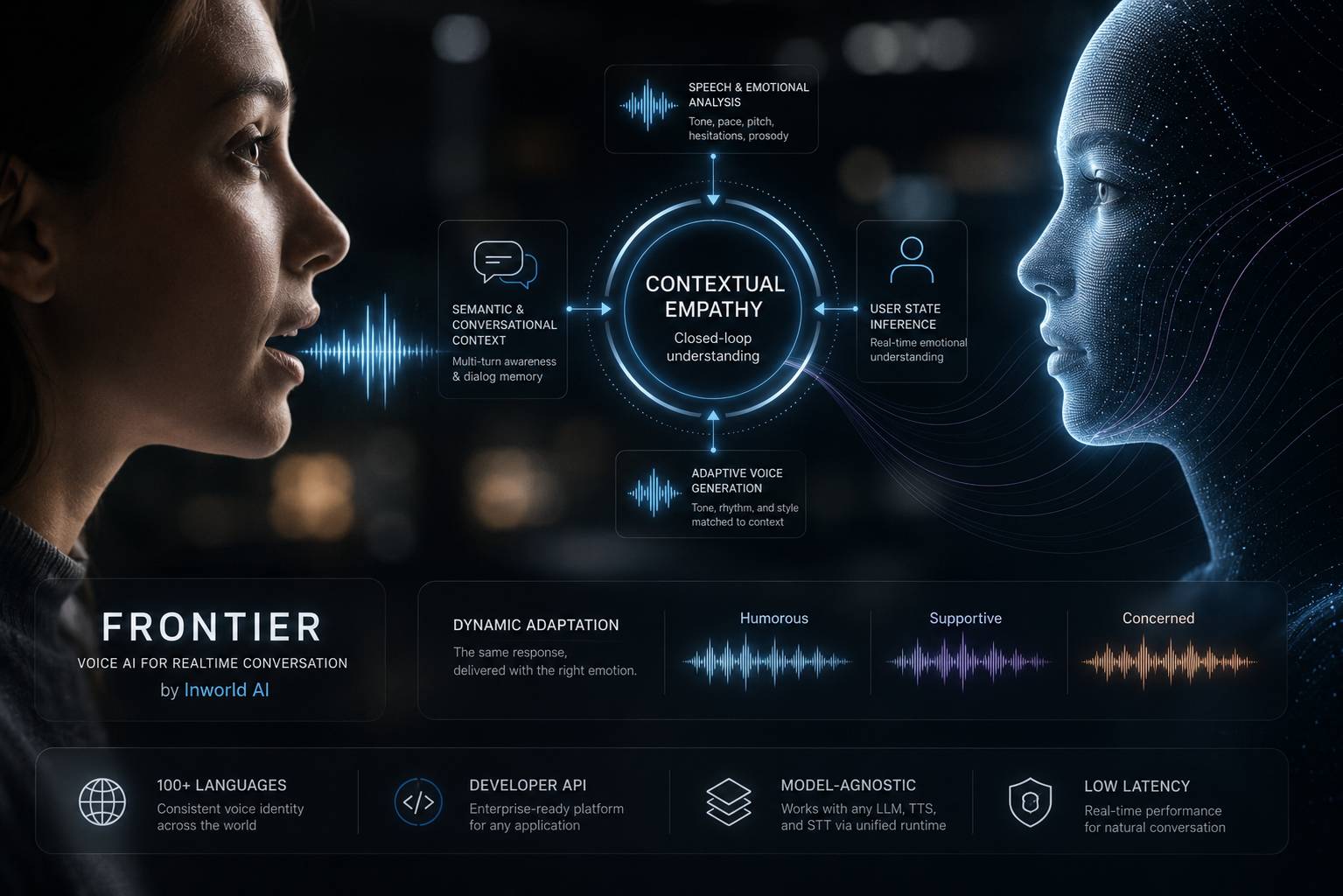

Con il lancio del nuovo modello Frontier dedicato alla “contextual empathy”, Inworld AI introduce un’architettura progettata per interpretare non solo le parole pronunciate dagli utenti, ma anche il modo in cui vengono dette, integrando segnali emotivi, contesto conversazionale e stato dell’interazione all’interno del processo di generazione vocale.

Il cambiamento tecnico più rilevante riguarda il passaggio da modelli text-to-speech tradizionali, ottimizzati per leggere testo in maniera naturale, a sistemi costruiti specificamente per conversazioni bidirezionali in tempo reale. I modelli vocali convenzionali operano infatti come sintetizzatori relativamente statici: ricevono testo e producono audio. L’approccio introdotto da Inworld modifica radicalmente questa pipeline, perché il modello mantiene consapevolezza continua dello stato della conversazione, aggiornando dinamicamente tono, ritmo, inflessione e comportamento dell’agente sulla base del contesto emotivo dell’utente.

Alla base del sistema vi è una struttura “closed-loop” che utilizza simultaneamente informazioni semantiche e segnali acustici. Il modello non analizza soltanto il contenuto linguistico della frase, ma interpreta caratteristiche vocali come velocità del parlato, esitazioni, intonazione, variazioni di pitch e prosodia. Questo consente di inferire lo stato emotivo dell’utente in tempo reale, costruendo una rappresentazione continua definita come “user state”, che viene poi utilizzata per guidare il comportamento dell’agente AI.

Il risultato operativo è una forma di empatia contestuale. La stessa risposta può essere pronunciata in modi differenti a seconda della situazione emotiva rilevata. Una frase successiva a una battuta umoristica viene interpretata e restituita con un tono diverso rispetto alla medesima frase inserita in un contesto negativo o stressante. Questo elemento introduce una componente dinamica che finora mancava nella maggior parte dei sistemi vocali AI, spesso percepiti come artificiali proprio per la loro incapacità di adattare realmente la propria espressività al flusso della conversazione.

L’architettura Frontier si basa su un modello vocale multi-turn aware, cioè progettato per mantenere memoria e continuità lungo l’intera interazione. Questa caratteristica è fondamentale perché consente all’agente di interpretare le variazioni emotive nel tempo, evitando risposte isolate e incoerenti. Il sistema aggiorna continuamente sia lo stato dell’utente sia quello dell’agente, creando un meccanismo di adattamento reciproco che modifica la generazione vocale in funzione della relazione conversazionale costruita durante il dialogo.

Inworld definisce questo approccio come “Voice AI built for realtime conversation”, distinguendolo dai modelli sviluppati originariamente per audiolibri, voiceover o sintesi narrativa. Nei sistemi tradizionali, la priorità era ottenere una voce credibile e gradevole. Nel nuovo paradigma, invece, la priorità diventa la naturalezza dell’interazione. Questo richiede latenze estremamente basse, capacità di elaborazione continua e integrazione stretta tra speech recognition, reasoning e generazione vocale.

Un aspetto particolarmente importante è la componente infrastrutturale. Inworld non propone il modello come applicazione consumer autonoma, ma come piattaforma API per sviluppatori. L’obiettivo è permettere l’integrazione della contextual empathy all’interno di agenti vocali enterprise, videogiochi, assistenti virtuali, customer service e sistemi interattivi. Questo approccio posiziona il modello come infrastruttura di base per la nuova generazione di agenti conversazionali, piuttosto che come prodotto finale destinato all’utente.

L’infrastruttura tecnica di Inworld è inoltre progettata per essere model-agnostic. La piattaforma può orchestrare differenti LLM, motori TTS e sistemi STT attraverso un runtime centralizzato scritto in C++, con routing dinamico basato anche sui segnali emotivi rilevati nella voce dell’utente. Questo significa che l’empatia contestuale non viene trattata come un semplice effetto audio, ma come un parametro operativo che influenza direttamente il comportamento cognitivo dell’agente.

L’introduzione di modelli vocali contestualmente empatici si collega anche a una direzione di ricerca più ampia nel settore degli agenti AI embodied e sociali. Gli studi recenti mostrano infatti come la credibilità degli agenti dipenda sempre meno dalla sola accuratezza linguistica e sempre più dalla capacità di comprendere stati mentali, intenzioni e contesto sociale dell’interlocutore. In questo senso, la voce diventa un vettore cognitivo e relazionale, non soltanto un mezzo di output.

Le applicazioni potenziali sono particolarmente ampie. Nel customer service, un agente può adattare il tono a utenti frustrati o confusi; in ambito sanitario, sistemi vocali contestuali possono migliorare il rapporto paziente-macchina; nei videogiochi e nelle esperienze immersive, NPC e personaggi virtuali possono reagire in modo più realistico alle emozioni del giocatore. La capacità di mantenere un’identità vocale coerente in oltre cento lingue amplia inoltre l’utilizzo in contesti globali e multi-lingua.

Un altro elemento distintivo riguarda la gestione delle “voice directions” in linguaggio naturale. Il modello può ricevere istruzioni semantiche sullo stile della risposta — ad esempio essere più empatico, più diretto o più ironico — integrandole direttamente nella sintesi vocale. Questo introduce un livello di controllabilità che supera la classica selezione di timbro o velocità, trasformando la voce in un componente programmabile dell’agente AI.