I fallimenti dei sistemi di intelligenza artificiale sono diventati un tema ricorrente nelle notizie di tecnologia. Algoritmi di valutazione del credito che discriminano le donne. Sistemi di visione artificiale che classificano erroneamente le persone con la pelle più scura. Sistemi di raccomandazione che promuovono contenuti violenti. Algoritmi di tendenza che amplificano le fake news.

La maggior parte dei sistemi software complessi a un certo punto fallisce e devono essere aggiornati regolarmente. Abbiamo procedure e strumenti che ci aiutano a trovare e correggere questi errori. Ma gli attuali sistemi di intelligenza artificiale, per lo più dominati da algoritmi di apprendimento automatico , sono diversi dai software tradizionali. Stiamo ancora esplorando le implicazioni di applicarli a diverse applicazioni e proteggerli dal fallimento richiede nuove idee e approcci.

Questa è l’idea alla base dell’AI Incident Database (AIID) , un archivio di guasti documentati dei sistemi di intelligenza artificiale nel mondo reale. Il database mira a rendere più facile vedere i guasti passati ed evitare che si ripetano.

L’AIID è sponsorizzato dalla Partnership on AI (PAI), un’organizzazione che cerca di sviluppare le migliori pratiche per l’intelligenza artificiale, migliorare la comprensione pubblica della tecnologia e ridurre i potenziali danni. PAI è stata fondata nel 2016 da ricercatori di intelligenza artificiale di Apple, Amazon, Google, Facebook, IBM e Microsoft, ma da allora si è espansa fino a includere più di 50 organizzazioni membri, molte delle quali non profit.

Esperienza nella documentazione dei guasti

Nel 2018, i membri del PAI stavano discutendo di una ricerca su una “tassonomia dei guasti dell’IA” o un modo per classificare i fallimenti dell’IA in modo coerente. Ma non esisteva una raccolta di errori dell’IA che potesse essere utilizzata per sviluppare la tassonomia. Ciò ha portato all’idea di sviluppare il database degli incidenti AI.

“Conoscevo i database degli incidenti e degli incidenti aerei e mi sono impegnato a costruire la versione AI del database dell’aviazione durante un incontro di Partnership on AI”, ha dichiarato a TechTalks Sean McGregor, consulente tecnico principale per IBM Watson AI XPRIZE. Da allora, McGregor ha supervisionato lo sforzo AIID e ha contribuito a sviluppare il database.

La struttura e il formato dell’AIID sono stati in parte ispirati dai database degli incidenti nei settori dell’aviazione e della sicurezza informatica. L’industria dei viaggi aerei commerciali è riuscita ad aumentare la sicurezza del volo analizzando e archiviando sistematicamente incidenti e inconvenienti passati all’interno di un database condiviso. Allo stesso modo, un database condiviso di incidenti di intelligenza artificiale può aiutare a diffondere la conoscenza e migliorare la sicurezza dei sistemi di intelligenza artificiale utilizzati nel mondo reale.

Incidenti aerei NTSB

Nel frattempo, il Common Vulnerabilities and Exposures (CVE) mantenuto da MITRE Corp è un buon esempio di un database che copre i guasti del software in vari settori. Ha contribuito a plasmare la visione per AIID come sistema che documenta i guasti dalle applicazioni AI in diversi campi.

“L’obiettivo dell’AIID è impedire che i sistemi intelligenti causino danni, o almeno ridurne la probabilità e la gravità”, afferma McGregor.

McGregor sottolinea che il comportamento del software tradizionale è generalmente ben compreso, ma i moderni sistemi di apprendimento automatico non possono essere completamente descritti o testati in modo esaustivo. L’apprendimento automatico deriva il suo comportamento dai dati di addestramento, quindi il suo comportamento ha la capacità di cambiare in modi non intenzionali man mano che i dati sottostanti cambiano nel tempo.

“Questi fattori, combinati con la capacità dei sistemi di apprendimento profondo di entrare nel mondo non strutturato in cui viviamo, significa che i malfunzionamenti sono più probabili, più complicati e più pericolosi”, afferma McGregor.

Oggi disponiamo di sistemi di deep learning in grado di riconoscere oggetti e persone nelle immagini , elaborare dati audio ed estrarre informazioni da milioni di documenti di testo in modi impossibili con il software tradizionale basato su regole, che si aspetta che i dati siano strutturati in modo ordinato formato tabulare. Questo cambiamento ha permesso di applicare l’IA al mondo fisico, attraverso applicazioni per auto a guida autonoma , telecamere di sicurezza, ospedali e assistenti vocali. Ma tutte queste nuove aree creano nuovi vettori per il fallimento.

Documentare gli incidenti di intelligenza artificiale

Dalla sua fondazione, AIID ha raccolto informazioni su più di 1.000 incidenti di IA dai media e da fonti pubblicamente disponibili. I problemi di correttezza sono gli incidenti di IA più comuni presentati all’AIID, in particolare nei casi in cui i governi utilizzano sistemi intelligenti, come i programmi di riconoscimento facciale. “Stiamo anche assistendo sempre più a incidenti che coinvolgono la robotica”, afferma McGregor.

Secondo McGregor, centinaia di altri incidenti sono in fase di revisione e aggiunti al database degli incidenti AI. “Sfortunatamente, non credo che avremo una carenza di nuovi incidenti”, dice.

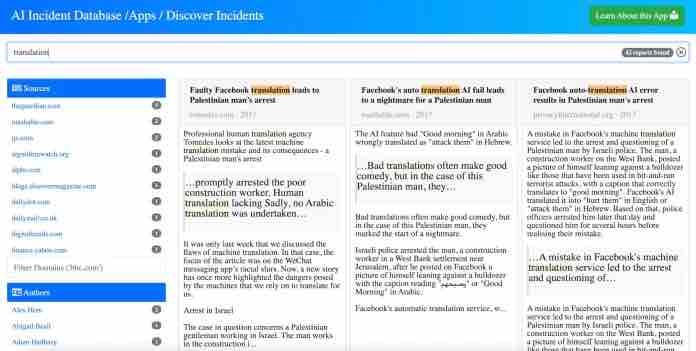

I visitatori possono interrogare il database per gli incidenti in base alla fonte, all’autore, al mittente, all’ID dell’incidente o alle parole chiave. Ad esempio, la ricerca di “traduzione” mostra che ci sono 42 segnalazioni di incidenti di intelligenza artificiale che coinvolgono la traduzione automatica. È quindi possibile filtrare la ricerca in base ad altri criteri.

query di traduzione del database degli incidenti ai

Utilizzo del database degli incidenti AI

Un database consolidato di incidenti che coinvolgono sistemi di intelligenza artificiale può servire a vari scopi nella ricerca, sviluppo e implementazione di sistemi di intelligenza artificiale.

Ad esempio, se un product manager sta valutando l’aggiunta di un sistema di raccomandazione basato sull’intelligenza artificiale a un’applicazione, può controllare 13 rapporti e 10 incidenti in cui tali sistemi hanno causato danni alle persone. Ciò aiuterà il responsabile del prodotto a definire i requisiti giusti per la funzionalità che il proprio team sta sviluppando.

sistema di raccomandazione del database degli incidenti ai

Altri dirigenti possono utilizzare il database degli incidenti AI per prendere decisioni migliori. Ad esempio, i responsabili del rischio possono interrogare il database per i danni che impiegano sistemi di traduzione automatica potrebbero causare e sviluppare le giuste misure di mitigazione del rischio.

Gli ingegneri possono utilizzare il database per scoprire i danni che i loro sistemi di intelligenza artificiale potrebbero causare se distribuiti nel mondo reale. E i ricercatori possono citarlo per articoli sull’equità e la sicurezza dei sistemi di intelligenza artificiale.

Infine, il crescente database di incidenti può servire a mettere in guardia le aziende che implementano algoritmi di intelligenza artificiale nelle loro applicazioni. “Le aziende tecnologiche sono famose per la loro propensione a muoversi rapidamente senza valutare tutti i potenziali risultati negativi. Quando vengono enumerati e condivisi risultati negativi, diventa impossibile procedere ignorando i danni “, afferma McGregor.

L’AI Incident Database è costruito su un’architettura flessibile che consentirà lo sviluppo di varie applicazioni per interrogare il database e ottenere altri approfondimenti, come terminologia chiave e contributori. In un documento che sarà presentato alla trentatreesima conferenza annuale sulle applicazioni innovative dell’intelligenza artificiale (IAAI-21), McGregor ha discusso tutti i dettagli dell’architettura. AIID è anche un progetto open source su GitHub , dove la comunità può aiutare a migliorare ed espandere le proprie capacità.

Con un solido database in atto, McGregor sta ora collaborando con Partnership on AI per sviluppare una tassonomia flessibile per la classificazione degli incidenti AI. In futuro, il team AIID spera di espandere il sistema per automatizzare il monitoraggio degli incidenti di IA.

“La comunità AI ha iniziato a condividere i record degli incidenti tra loro per motivare le modifiche ai propri prodotti, procedure di controllo e programmi di ricerca”, afferma McGregor. “Il sito è stato rilasciato pubblicamente a novembre, quindi stiamo appena iniziando a realizzare i vantaggi del sistema.”