L’uso dell’intelligenza artificiale (AI) per la guerra è stata la promessa della fantascienza e dei politici per anni, ma una nuova ricerca del Georgia Institute of Technology sostiene che solo così tanto può essere automatizzato e mostra il valore del giudizio umano.

“Tutti i problemi difficili nell’IA sono davvero problemi di giudizio e di dati, e la cosa interessante è quando inizi a pensare alla guerra, i problemi difficili sono la strategia e l’incertezza, o ciò che è ben noto come la nebbia della guerra”, ha affermato Jon Lindsay , professore associato presso la School of Cybersecurity & Privacy e la Sam Nunn School of International Affairs . “Hai bisogno di un senso umano e di prendere decisioni morali, etiche e intellettuali in una situazione incredibilmente confusa, tesa e spaventosa”.

Il processo decisionale dell’IA si basa su quattro componenti chiave: dati su una situazione, interpretazione di tali dati (o previsione), determinazione del modo migliore per agire in linea con obiettivi e valori (o giudizio) e azione. I progressi dell’apprendimento automatico hanno semplificato le previsioni, il che rende i dati e il giudizio ancora più preziosi. Sebbene l’IA possa automatizzare tutto, dal commercio al transito, il giudizio è dove gli esseri umani devono intervenire, Lindsay e il professor Avi Goldfarb dell’Università di Toronto hanno scritto nel documento ” Previsione e giudizio: perché l’intelligenza artificiale aumenta l’importanza degli esseri umani in guerra “, pubblicato su International Sicurezza .

Molti responsabili politici ritengono che i soldati umani possano essere sostituiti con sistemi automatizzati, rendendo idealmente le forze armate meno dipendenti dal lavoro umano e più efficaci sul campo di battaglia. Questa è chiamata teoria della sostituzione dell’IA, ma Lindsay e Goldfarb affermano che l’IA non dovrebbe essere vista come un sostituto, ma piuttosto un complemento alla strategia umana esistente.

“Le macchine sono brave a prevedere, ma dipendono dai dati e dal giudizio, e i problemi più difficili in guerra sono l’informazione e la strategia”, ha affermato. “Le condizioni che fanno funzionare l’IA nel commercio sono le condizioni più difficili da soddisfare in un ambiente militare a causa della sua imprevedibilità”.

Un esempio di Lindsay e Goldfarb è la società mineraria Rio Tinto, che utilizza camion a guida autonoma per trasportare materiali, riducendo i costi e i rischi per i conducenti umani. Esistono modelli e mappe di traffico dati abbondanti, prevedibili e imparziali che richiedono un intervento umano minimo a meno che non ci siano chiusure stradali o ostacoli.

La guerra, tuttavia, di solito manca di abbondanti dati imparziali e i giudizi su obiettivi e valori sono intrinsecamente controversi, ma ciò non significa che sia impossibile. I ricercatori sostengono che l’IA sarebbe meglio impiegata in ambienti stabilizzati burocraticamente, attività per attività.

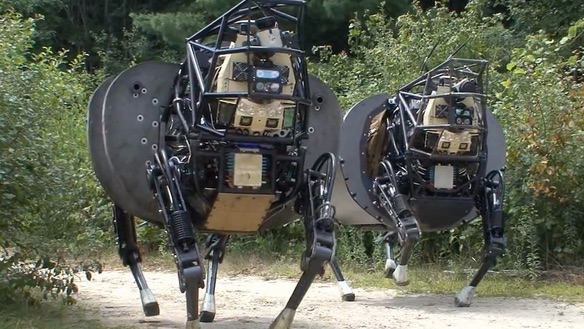

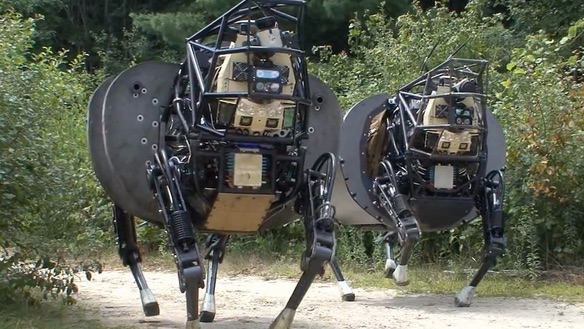

“Tutta l’eccitazione e la paura riguardano robot assassini e veicoli letali, ma il caso peggiore per l’IA militare in pratica saranno i problemi classicamente militaristici in cui dipendi davvero dalla creatività e dall’interpretazione”, ha detto Lindsay. “Ma quello che dovremmo guardare sono i sistemi del personale, l’amministrazione, la logistica e le riparazioni”.

Ci sono anche conseguenze nell’uso dell’IA sia per i militari che per i suoi avversari, secondo i ricercatori. Se gli esseri umani sono l’elemento centrale per decidere quando utilizzare l’IA in guerra, la struttura e le gerarchie della leadership militare potrebbero cambiare in base alla persona responsabile della progettazione e della pulizia dei sistemi di dati e delle decisioni politiche. Ciò significa anche che gli avversari mireranno a compromettere sia i dati che il giudizio poiché influenzerebbero ampiamente la traiettoria della guerra. La competizione contro l’IA può spingere gli avversari a manipolare o interrompere i dati per rendere il giudizio ancora più difficile. In effetti, l’intervento umano sarà ancora più necessario.

Eppure questo è solo l’inizio dell’argomento e delle innovazioni.

“Se l’intelligenza artificiale sta automatizzando la previsione, ciò rende il giudizio e i dati davvero importanti”, ha affermato Lindsay. “Abbiamo già automatizzato molte azioni militari con forze meccanizzate e armi di precisione, quindi abbiamo automatizzato la raccolta dei dati con satelliti e sensori di intelligence e ora stiamo automatizzando la previsione con l’IA. Quindi, quando automatizzare il giudizio o ci sono componenti del giudizio che non possono essere automatizzati?

Fino ad allora, tuttavia, il processo decisionale tattico e strategico da parte degli umani continua a essere l’aspetto più importante della guerra.

Informazioni sul Georgia Institute of Technology

Il Georgia Institute of Technology, o Georgia Tech, è una delle prime 10 università pubbliche di ricerca che sviluppano leader che fanno avanzare la tecnologia e migliorano la condizione umana. L’Istituto offre diplomi in economia, informatica, design, ingegneria, arti liberali e scienze. I suoi quasi 40.000 studenti in rappresentanza di 50 stati e 149 paesi studiano nel campus principale di Atlanta, nei campus in Francia e Cina e attraverso l’apprendimento a distanza e online. In qualità di università tecnologica leader, Georgia Tech è un motore di sviluppo economico per la Georgia, il sud-est e la nazione, conducendo oltre 1 miliardo di dollari di ricerca all’anno per il governo, l’industria e la società.