Ecco il rilascio di Mamba-3, una soluzione open source che punta a superare i limiti strutturali dei modelli basati su Transformer. Mentre il panorama tecnologico è stato dominato per anni dal meccanismo di “self-attention”, caratterizzato da una complessità computazionale quadratica che rende difficile la gestione di contesti estremamente lunghi, Mamba-3 introduce un approccio radicalmente diverso basato sui modelli a spazio di stato (State Space Models o SSM). Questa nuova iterazione non si limita a migliorare le prestazioni della versione precedente, ma ridefinisce l’efficienza dei sistemi di elaborazione sequenziale, offrendo una riduzione della latenza e un miglioramento della qualità del linguaggio che sfida direttamente l’attuale standard industriale.

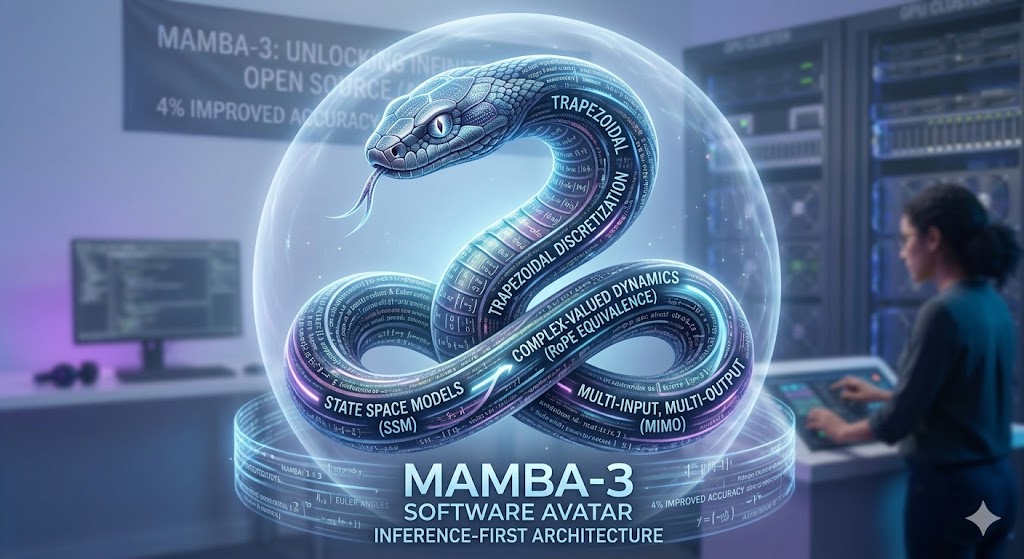

Il cuore tecnologico di Mamba-3 risiede in una filosofia progettuale definita “inference-first”, ovvero orientata prioritariamente all’efficienza durante la fase di utilizzo del modello. A differenza di Mamba-2, che si era focalizzato sulla velocità di addestramento, questa terza generazione implementa tre innovazioni metodologiche fondamentali che ne potenziano le capacità di ragionamento e di tracciamento dello stato. La prima di queste innovazioni riguarda l’adozione di una discretizzazione trapezoidale più raffinata, che permette una ricorrenza più espressiva e precisa rispetto ai metodi precedenti. Questo accorgimento tecnico consente al modello di catturare sfumature informative che prima andavano perse, portando a una precisione media nei compiti di modellazione linguistica superiore di quasi il quattro per cento rispetto alle architetture concorrenti.

Un ulteriore salto di qualità è rappresentato dall’introduzione di dinamiche a valori complessi. Attraverso un’equivalenza matematica con le rotazioni di tipo RoPE (Rotary Positional Embeddings), tipiche dei modelli Transformer, Mamba-3 riesce a gestire compiti di tracciamento dello stato e logica formale con una stabilità senza precedenti per un modello lineare. Questa capacità permette di risolvere puzzle logici complessi che prima rappresentavano un ostacolo insormontabile per i modelli sub-quadratici. Il risultato è un sistema che riesce a mantenere la “memoria” del contesto in modo estremamente efficiente, utilizzando solo la metà della dimensione dello stato interno rispetto a Mamba-2 pur garantendo la medesima intelligenza e una perplessità comparabile.

La terza colonna portante di Mamba-3 è l’architettura Multi-Input, Multi-Output, comunemente abbreviata in MIMO. Questa innovazione trasforma la natura stessa della ricorrenza del modello, permettendogli di eseguire fino a quattro volte più operazioni matematiche in parallelo durante ogni singolo passo di decodifica. In termini pratici, ciò significa che Mamba-3 è in grado di sfruttare appieno la potenza di calcolo delle moderne GPU che spesso rimane inutilizzata nei modelli lineari tradizionali a causa dei colli di bottiglia legati alla larghezza di banda della memoria. Aumentando l’intensità aritmetica senza incrementare significativamente la latenza di calcolo, la variante MIMO stabilisce un nuovo record nel rapporto tra prestazioni ed efficienza hardware.

L’impatto di Mamba-3 per la comunità degli sviluppatori e per l’industria è profondo, specialmente per le applicazioni che richiedono l’elaborazione di sequenze lunghissime o agenti di ragionamento in tempo reale. Essendo rilasciato con licenza open source Apache 2.0, il modello si offre come un’alternativa concreta e immediatamente integrabile nei flussi di lavoro esistenti, promettendo di abbattere drasticamente i costi operativi legati all’uso delle GPU. In un’era in cui il costo per token e la velocità di risposta sono diventati fattori critici per il successo di un’applicazione AI, Mamba-3 dimostra che è possibile ottenere prestazioni d’avanguardia senza dover necessariamente sottostare alle inefficienze dei Transformer, aprendo la strada a una nuova generazione di modelli linguistici più agili, intelligenti e sostenibili.