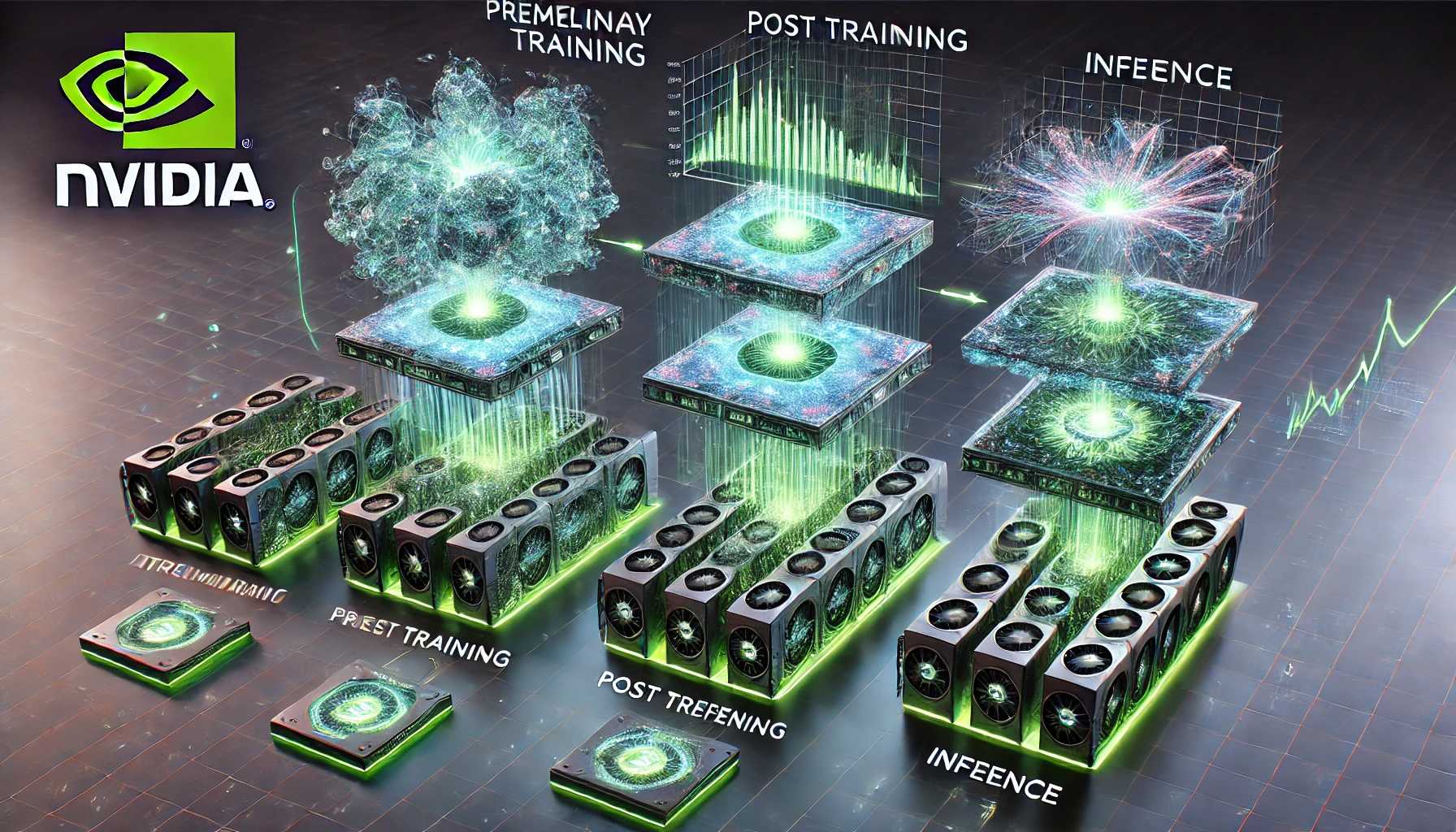

NVIDIA ha recentemente evidenziato come l’addestramento posteriore e l’inferenza richiedano risorse computazionali significativamente superiori rispetto all’addestramento preliminare dei modelli IA. Questa analisi offre una nuova prospettiva sulla distribuzione delle risorse necessarie per sviluppare e implementare efficacemente soluzioni IA su larga scala.

Kari Briski, vicepresidente della gestione dei prodotti IA di NVIDIA, ha delineato tre fasi chiave nell’espansione delle capacità dell’IA:

- Addestramento Preliminare: Tradizionalmente, l’attenzione si è concentrata sull’investimento di ingenti risorse computazionali e dati per addestrare modelli IA di base.

- Addestramento Posteriore: Questa fase implica l’adattamento dei modelli pre-addestrati a specifici casi d’uso attraverso tecniche come la messa a punto, la potatura, la quantizzazione e l’apprendimento per rinforzo. Briski sottolinea che questa fase può richiedere fino a 30 volte più risorse computazionali rispetto all’addestramento preliminare.

- Inferenza (Test-Time Compute): Durante l’inferenza, il modello applica le conoscenze acquisite per generare risposte o previsioni. Per compiti complessi, l’inferenza può necessitare di oltre 100 volte le risorse computazionali rispetto a una semplice risposta di un chatbot.

Questa nuova comprensione delle esigenze computazionali nelle diverse fasi dello sviluppo dell’IA ha diverse implicazioni:

- Pianificazione delle Risorse: Le organizzazioni devono considerare l’investimento non solo nell’addestramento iniziale dei modelli, ma anche nelle fasi successive di adattamento e implementazione pratica.

- Sviluppo di Infrastrutture: La crescente domanda di risorse per l’addestramento posteriore e l’inferenza potrebbe portare a un aumento significativo nella necessità di infrastrutture computazionali avanzate, come GPU ad alte prestazioni.

Efficienza Energetica: Con l’aumento delle risorse richieste, l’efficienza energetica diventa un fattore cruciale, spingendo verso lo sviluppo di hardware e algoritmi più sostenibili.