OpenAI fa il suo debutto con DALL-E per la generazione di immagini dal testo

OpenAI ha presentato oggi due sistemi AI multimodali che combinano visione artificiale e PNL: DALL-E, un sistema che genera immagini dal testo, e CLIP, una rete addestrata su 400 milioni di coppie di immagini e testo.

La foto sopra è stata generata da DALL-E dal prompt di testo “un’illustrazione di un ravanello daikon in tutù che porta a spasso un cane”. DALL-E utilizza una versione con 12 miliardi di parametri di GPT-3 e, come GPT-3, è un modello di linguaggio Transformer. Il nome vuole evocare l’artista Salvador Dalì e il robot WALL-E.

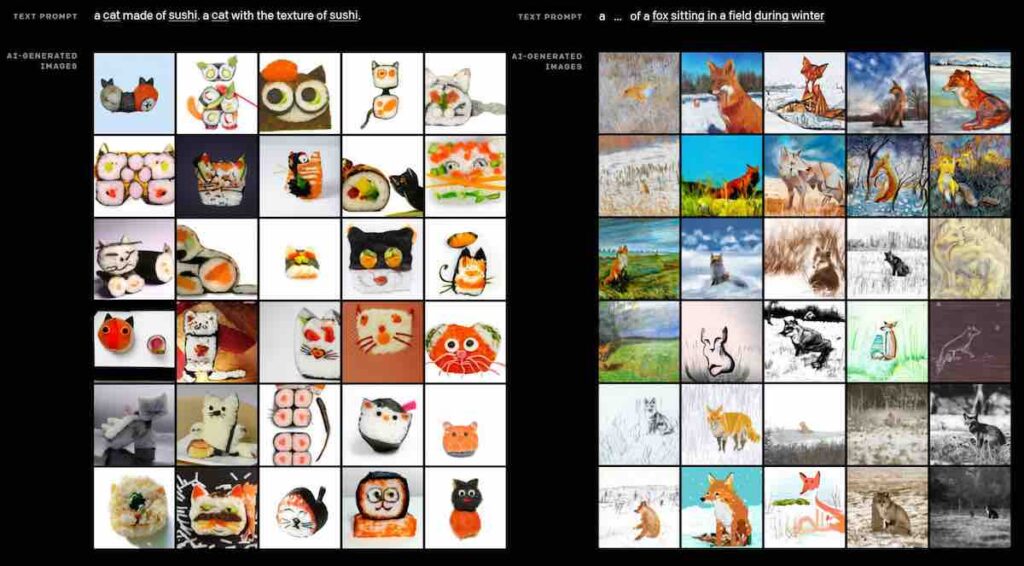

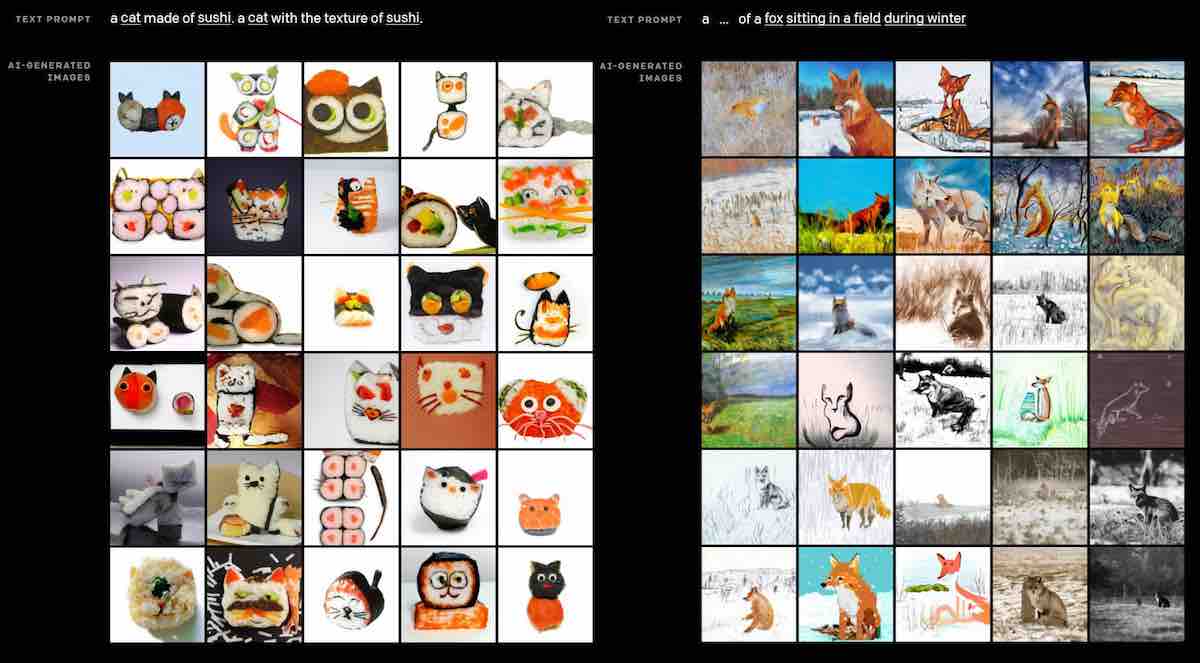

I test che OpenAI ha condiviso oggi sembrano dimostrare che DALL-E ha la capacità di manipolare e riorganizzare gli oggetti nelle immagini generate e anche di creare cose che non esistono, come un cubo con la trama di un porcospino o un cubo di nuvole. Sulla base di messaggi di testo, le immagini generate da DALL-E possono apparire come se fossero state prese dal mondo reale o possono rappresentare opere d’arte. Visita il sito web di OpenAI per provare una demo controllata di DALL-E .

“Riconosciamo che il lavoro che coinvolge modelli generativi ha il potenziale per impatti sociali significativi e ampi. In futuro, abbiamo in programma di analizzare come modelli come DALL-E si relazionano a questioni sociali come l’impatto economico su determinati processi di lavoro e professioni, il potenziale di bias nei risultati del modello e le sfide etiche a lungo termine implicite da questa tecnologia “, OpenAI ha scritto oggi in un post sul blog su DALL-E.

OpenAI ha anche introdotto CLIP, un modello multimodale addestrato su 400 milioni di paia di immagini e testo raccolti da Internet. CLIP utilizza capacità di apprendimento zero-shot simili ai modelli di linguaggio GPT-2 e GPT-3.

“Abbiamo riscontrato che CLIP, simile alla famiglia GPT, impara a eseguire un’ampia serie di attività durante il pre-addestramento, tra cui il riconoscimento dei caratteri degli oggetti (OCR), la geolocalizzazione, il riconoscimento delle azioni e molti altri. Lo misuriamo confrontando le prestazioni di trasferimento zero-shot di CLIP su oltre 30 set di dati esistenti e scopriamo che può essere competitivo con i precedenti modelli supervisionati specifici per attività “, scrivono 12 coautori di OpenAI in un documento sul modello.

Sebbene i test abbiano rilevato che CLIP era competente in una serie di attività, non è stata all’altezza delle attività di specializzazione, come la classificazione delle immagini satellitari o il rilevamento del tumore ai linfonodi.

“Questa analisi preliminare ha lo scopo di illustrare alcune delle sfide che i modelli di visione artificiale generici pongono e di dare uno sguardo ai loro pregiudizi e impatti. Ci auguriamo che questo lavoro motiva la ricerca futura sulla caratterizzazione delle capacità, delle carenze e dei pregiudizi di tali modelli, e siamo entusiasti di impegnarci con la comunità di ricerca su tali questioni “, si legge nel documento.

Il capo scienziato di OpenAI Ilya Sutskever è stato un coautore del documento che descrive in dettaglio CLIP e potrebbe aver alluso all’imminente rilascio di CLIP quando ha recentemente detto a deeplearning.ai che i modelli multimodali sarebbero stati una delle principali tendenze di apprendimento automatico nel 2021. Il capo di Google AI Jeff Dean ha realizzato un previsione simile per il 2020 in un’intervista a VentureBeat .

Il rilascio di DALL-E segue una serie di modelli generativi con il potere di imitare o distorcere la realtà o prevedere come le persone dipingono paesaggi e nature morte . Ma alcuni, come StyleGAN, hanno anche dimostrato pregiudizi razziali .

I ricercatori di OpenAI che lavorano su CLIP e DALL-E hanno chiesto ulteriori ricerche sul potenziale impatto sociale di entrambi i sistemi. GPT-3 ha mostrato un significativo pregiudizio anti-musulmano e punteggi di sentiment negativi per i neri, quindi le stesse carenze potrebbero essere incorporate in DALL-E. Un bias test incluso nel documento CLIP ha rilevato che il modello era molto probabile che classificasse erroneamente le persone sotto i 20 anni come criminali o non umani. Le persone classificate come uomini avevano maggiori probabilità di essere etichettate come criminali rispetto alle persone classificate come donne e alcuni dati sulle etichette contenuti nel set di dati sono fortemente di genere.

Come OpenAI ha creato DALL-E e ulteriori dettagli saranno condivisi in un prossimo articolo. I modelli di linguaggio di grandi dimensioni che utilizzano i dati raccolti da Internet sono stati criticati dai ricercatori che affermano che il settore dell’IA deve subire un cambiamento culturale .