Il modello Pi 0.7 è stato sviluppato dalla startup Physical Intelligence e si distingue per la sua capacità di generalizzazione operativa, ovvero l’abilità di affrontare e risolvere problemi mai incontrati durante la fase di addestramento attraverso la ricombinazione di competenze acquisite in contesti differenti. Questo approccio segna un passaggio da una robotica basata su specializzazione a una robotica orientata alla flessibilità cognitiva.

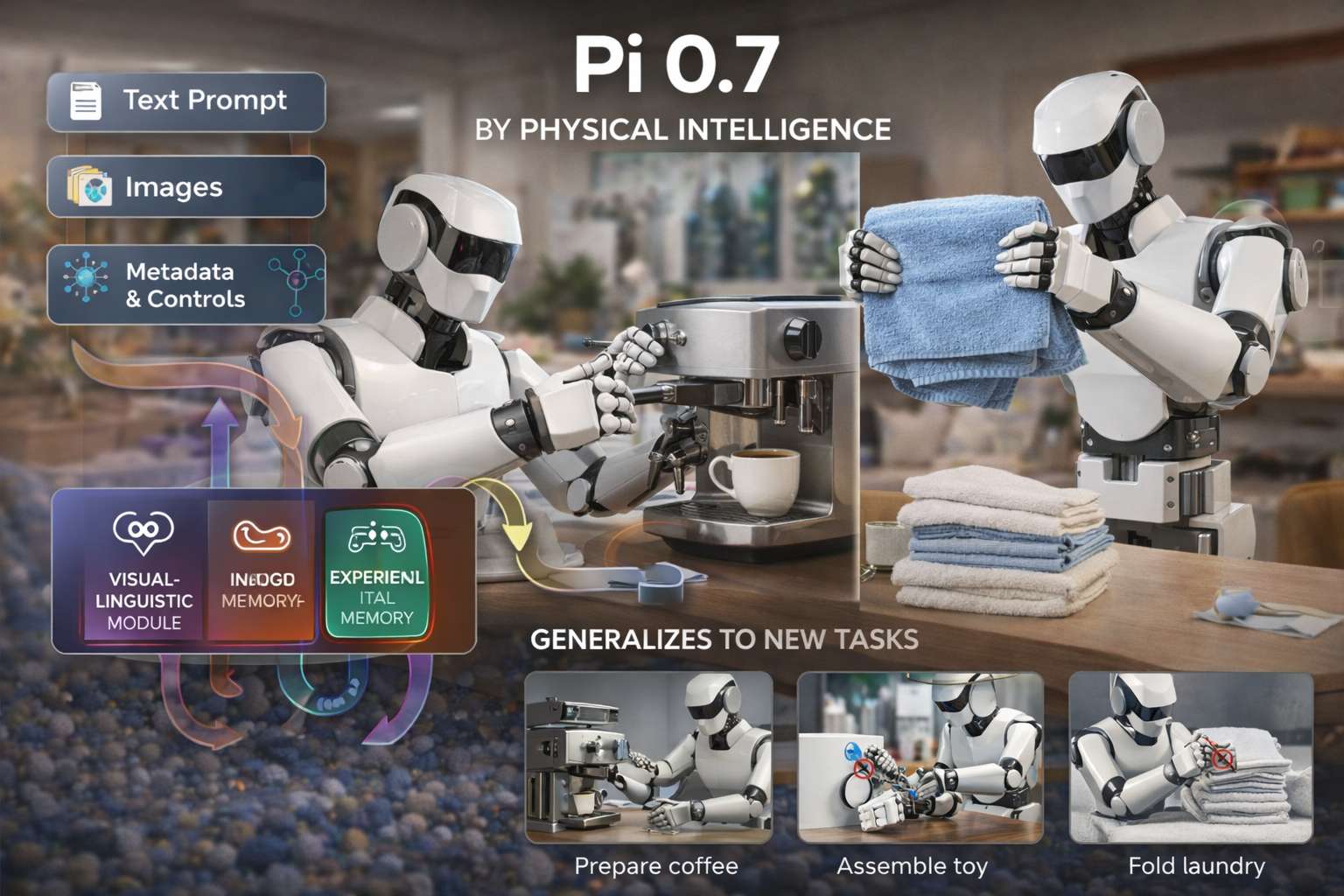

Il cuore tecnologico di Pi 0.7 è rappresentato da un’architettura di tipo visivo-linguistico-azionaria, progettata per integrare simultaneamente diverse modalità informative e tradurle in azioni fisiche. Il modello, con una dimensione complessiva di circa cinque miliardi di parametri, è composto da tre moduli principali che operano in sinergia. Il primo è un modello visivo-linguistico, responsabile dell’interpretazione di immagini e linguaggio naturale, che costituisce la base semantica del sistema. Il secondo è un componente di memoria esperienziale, assimilabile a un registratore di situazioni precedenti, che consente di richiamare contesti e sequenze operative già osservate. Il terzo è un modulo di azione, incaricato di tradurre le rappresentazioni interne in comandi motori concreti, determinando il comportamento fisico del robot.

Questa suddivisione funzionale consente al sistema di operare come un’entità cognitiva stratificata, in cui la comprensione, la memoria e l’azione sono integrate ma distinte. Il risultato è una maggiore capacità di adattamento, poiché il robot non si limita a eseguire schemi predefiniti, ma costruisce dinamicamente strategie operative in base al contesto. Un esempio emblematico di questa capacità è l’esecuzione di compiti non presenti nei dati di addestramento, come l’utilizzo di dispositivi domestici non familiari. In tali situazioni, il modello dimostra un comportamento analogo a quello umano, basato su tentativi iniziali seguiti da un miglioramento progressivo grazie all’integrazione di istruzioni aggiuntive.

Uno degli elementi più innovativi è l’adozione di un sistema di prompt multimodale. A differenza dei modelli tradizionali, che si basano prevalentemente su input testuali, Pi 0.7 utilizza una combinazione di informazioni eterogenee, tra cui descrizioni linguistiche, immagini, metadati e parametri di controllo. Questo consente di specificare non solo l’obiettivo finale, ma anche le modalità operative per raggiungerlo. La presenza di immagini di sotto-obiettivi, che rappresentano stati intermedi desiderati, introduce una forma di guida visiva che riduce l’ambiguità e facilita la decomposizione di compiti complessi.

Un ruolo fondamentale è svolto dal modello di generazione di immagini BAGEL, utilizzato per costruire rappresentazioni visive degli stati target. Queste immagini fungono da riferimento durante l’esecuzione, permettendo al robot di confrontare continuamente lo stato corrente con quello desiderato. Questo meccanismo introduce una forma di controllo iterativo basato su feedback visivo, che migliora la precisione e la robustezza delle operazioni.

L’addestramento del modello si basa su un approccio eterogeneo che combina dati provenienti da diverse fonti, tra cui piattaforme robotiche multiple, dimostrazioni umane e dati raccolti autonomamente. Un aspetto particolarmente interessante è l’inclusione di dati di qualità variabile, corretti e arricchiti tramite metadati. Questo suggerisce un’evoluzione delle strategie di training, in cui la quantità e la diversità dei dati assumono un ruolo centrale, anche a costo di gestire imperfezioni attraverso tecniche di normalizzazione e contestualizzazione.

Il concetto di scalabilità introdotto da Pi 0.7 si distingue da quello tradizionale basato sull’aumento lineare delle prestazioni con la crescita dei dati. In questo caso, il miglioramento è descritto come non lineare, poiché l’integrazione di competenze diverse consente al sistema di generare comportamenti emergenti. Questo fenomeno è particolarmente evidente nella capacità di trasferire conoscenze tra domini differenti, come dimostrato nei test su piattaforme robotiche eterogenee.

Un esempio significativo riguarda l’utilizzo di un sistema robotico industriale a doppio braccio per eseguire un compito complesso come la piegatura della biancheria. Nonostante la disponibilità limitata di dati specifici, il modello ha raggiunto prestazioni comparabili a quelle di un operatore umano esperto in condizioni di apprendimento zero-shot. Questo risultato evidenzia la capacità del sistema di generalizzare competenze motorie e cognitive in contesti nuovi, riducendo la dipendenza da dataset altamente specializzati.

In termini di prestazioni, Pi 0.7 si colloca a un livello competitivo rispetto ai modelli ottimizzati tramite tecniche di Reinforcement Learning, pur mantenendo una maggiore flessibilità operativa. La possibilità di eseguire compiti diversi, come la preparazione del caffè, l’assemblaggio di oggetti e la gestione della biancheria, con un unico modello rappresenta un vantaggio significativo in termini di scalabilità e riduzione dei costi di sviluppo.