Un pioniere nella polizia predittiva sta dando il via a un nuovo progetto preoccupante

La ricerca finanziata dal Pentagono mira a prevedere quando i crimini sono legati alle gang

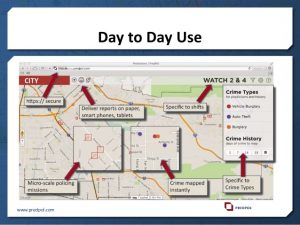

Jeff Brantingham è il più vicino possibile a mettere un volto sulla controversa pratica della “polizia predittiva”. Nell’ultimo decennio, il professore di antropologia dell’Università della California-Los Angeles ha adattato la sua ricerca finanziata dal Pentagono nella previsione delle perdite sul campo di battaglia in Iraq per prevedere crimine per i dipartimenti di polizia americani, brevettando la sua ricerca e fondando una società a scopo di lucro chiamata PredPol, LLC.

PredPol divenne rapidamente uno dei leader del mercato nel nascente campo della previsione del crimine intorno al 2012, ma venne anche preso di mira da attivisti e libertari civili che sostenevano che l’impresa fornisse una sorta di “lavaggio tecnologico” per metodi di polizia razzisti, inefficaci.

Ora, Brantingham sta usando finanziamenti per la ricerca militare per un’altra collaborazione tecnologica e poliziesca con ripercussioni potenzialmente dannose: utilizzando l’apprendimento automatico, i dati criminali del Dipartimento di Polizia di Los Angeles e una mappa del territorio delle gang obsolete per automatizzare la classificazione dei crimini legati alle gang.

Essere classificati come membri di una banda o legati a un crimine di gruppo può comportare ulteriori accuse penali, pene detentive più pesanti o l’inclusione in un’ingiunzione di banda civile che limita i movimenti di una persona e la capacità di associarsi con altre persone. Generalmente, le forze dell’ordine determinano i legami delle bande attraverso una valutazione altamente soggettiva e individualizzata delle storie criminali, degli arresti, delle interviste e di altre informazioni. Negli ultimi anni, attivisti della California, dell’Illinois e di altri stati hanno respinto le misure di polizia di gruppo come i database e le ingiunzioni di bande e, nel caso della California, sono riusciti a convincere i residenti del diritto di rivedere e fare appello alla classificazione delle loro bande.

Ma in un articolo su ” Reti neurali parzialmente generative per la classificazione della criminalità organizzata” presentato a febbraio alla conferenza inaugurale sull’intelligence artificiale , l’etica e la società (AIES), Brantingham ei suoi coautori propongono di automatizzare questa valutazione complessa e soggettiva.

Ma in un articolo su ” Reti neurali parzialmente generative per la classificazione della criminalità organizzata” presentato a febbraio alla conferenza inaugurale sull’intelligence artificiale , l’etica e la società (AIES), Brantingham ei suoi coautori propongono di automatizzare questa valutazione complessa e soggettiva.

Il documento tenta di prevedere se i crimini sono collegati a una banda utilizzando una rete neurale, un complesso sistema di calcolo modellato su un cervello umano che “impara” a classificare o identificare elementi basati sull’ingestione di un set di dati di addestramento. Gli autori hanno selezionato ciò che hanno determinato essere le quattro caratteristiche più importanti (numero di sospetti, arma primaria utilizzata, il tipo di locali in cui si è verificato il crimine e descrizione descrittiva del crimine) per identificare un crimine correlato a una gang dal 2014- 16 dati della LAPD e riferimenti incrociati agli episodi di crimine con una mappa LAPD del territorio di bande del 2009 per creare un set di dati di addestramento per la loro rete neurale.

I ricercatori hanno testato l’accuratezza delle previsioni della rete osservando quanto bene classificasse i dati relativi alla criminalità senza una caratteristica chiave: la descrizione testuale del crimine, i dati più dispendiosi in termini di tempo per la polizia da raccogliere. È qui che entra in gioco l’aspetto “parzialmente generativo” nel titolo. In assenza di una descrizione scritta, la rete neurale genera un nuovo testo – in effetti, un rapporto sul crimine scritto in modo algoritmico basato sulle altre tre caratteristiche utilizzate nel modello di formazione. Il testo generato non viene letto da nessuno, né si presume che fornisca un contesto narrativo significativo che sostituisca un rapporto di polizia, ma è trasformato in un vettore matematico e incorporato nella previsione finale del fatto che un crimine sia legato alla gang.

IN EFFETTI, UN RAPPORTO SUL CRIMINE SCRITTO ALGORITMICAMENTE

Questo articolo è il primo ad essere pubblicato da un gruppo di ricerca co-guidato da Brantingham studiare “ Spazio -Temporal Teoria dei Giochi & Real-Time Machine Learning per Adversarial Gruppi” presso l’Università del Centro Sud della California per l’intelligenza artificiale e Società (CAIS). La missione del CAIS afferma un obiettivo di “[condividere] le nostre idee su come l’intelligenza artificiale può essere utilizzata per affrontare i problemi sociali più difficili”.

I finanziamenti per il gruppo di ricerca USC che include il progetto di Brantingham provengono dalla Minerva Initiative, un programma di ricerca del Pentagono inteso a migliorare la comprensione militare dei driver di conflitto sociali, politici e comportamentali. Secondo il sito web di Minerva Initiative, i finanziamenti sono forniti a progetti che affrontano “aree tematiche specifiche definite dal Segretario della Difesa”. Tramite email, il cofondatore e coautore del CAIS Milind Tambe ha dichiarato che la sovvenzione Minerva per questo progetto è ” circa “$ 1,2 milioni, da distribuire in tre anni.

Il sito Web per gli sforzi del gruppo di ricerca, incluso il documento di classificazione delle gang, si apre con riferimenti a ISIS e Jabhat al-Nusra prima di spostarsi sul terreno delle bande di Los Angeles, una fusione che riecheggia il precedente lavoro finanziato da Dant di Brantingham che lo ha portato a co -promessa PredPol. PredPol ha venduto i suoi servizi alla polizia ovunque, dalla California alla Georgia, così come nel Regno Unito. Nel 2015, PredPol ha esercitato pressioni senza successo sui legislatori dell’Arizona per approvare una legge di stanziamento di $ 2 milioni per utilizzare la tecnologia di previsione dell’azienda per prevedere l’attività delle bande.

UN PARTECIPANTE È USCITO DI CORSA

Prima riportato su Science , il documento è stato accolto con critiche e qualche indignazione alla conferenza AIES, presentata dal co-autore junior Hau Chan. Ad un certo punto, Chan ha risposto a una domanda sulle implicazioni etiche della ricerca con l’affermazione “Sono solo un ingegnere”, portando un partecipante a precipitarsi fuori dalla sede. Tuttavia, riferire sul giornale e sulle sue ricadute non ha fatto cenno alle relazioni commerciali di Brantingham con PredPol o ai finanziamenti militari della sua ricerca passata e presente.

Quando gli è stato chiesto in un’intervista telefonica se questa ricerca potesse informare gli sforzi futuri del business, Brantingham ha detto: “Questo è un progetto separato, ed è così che ci stiamo pensando.” Sottolineando che ci sono voluti un decennio per il suo precedente finanziamento militare ricerca per diventare PredPol, Brantingham ha sottolineato che il lavoro riflette un lavoro molto preliminare. “Il nostro compito è fare un’attenta ricerca di base e assicurarci di capire come e perché le cose sono come sono, molto prima che qualsiasi idea di utilizzo sul campo possa essere contemplata”.

Per quanto preliminare possa essere la ricerca e, per quanto buone siano le intenzioni dei suoi autori, la carta e il coinvolgimento di Brantingham sollevano le sopracciglia con i critici di una tecnologia di polizia sempre più automatizzata basata sui dati.

“OGNI VOLTA CHE TIRI FUORI LA PROSPETTIVA UMANA O L’INTERAZIONE, NON CREDO CI SIANO DEI LATI POSITIVI.”

Aaron Harvey, un residente di San Diego e attivista che ha respinto con successo accuse di cospirazione di bande da parte del pubblico ministero locale che potrebbe averlo imprigionato per oltre un decennio, da allora è diventato un importante attivista della California che respinge le leggi della banda dello stato, che sono il più vecchio e severo degli Stati Uniti.

“Ogni volta che tiri fuori la prospettiva umana o l’interazione, non credo che ci siano dei lati positivi”, ha detto Harvey della ricerca di Brantingham. Oltre a rimuovere la discrezionalità umana dal processo, Harvey riteneva che l’automatizzazione di tali decisioni basate su dati storici criminali provenienti esclusivamente dai dipartimenti di polizia avrebbe solo rafforzato le precedenti accuse di coinvolgimento delle bande, che fossero vere o no. “Stai facendo degli algoritmi su una falsa narrativa che è stata creata per le persone – la documentazione della banda è lo stato che definisce le persone in base a ciò in cui credono”, ha detto Harvey. “Quando lo colleghi al computer, ogni crimine sarà legato alla gang.”

Christo Wilson, assistente professore in informatica e scienze dell’informazione presso la Northeastern University e un co-organizzatore della conferenza Equità, Responsabilità e Trasparenza in Machine Learning, ha anche preoccupazioni sul potenziale del modello di rafforzare errori e pregiudizi. “Se formo un modello per predire l’altezza delle persone, sappiamo come interpretare l’output e valutarne l’accuratezza.” Ma, ha osservato Wilson, “la relazione tra gang” è una determinazione soggettiva complessa. “Quindi l’algoritmo è preciso nel predire cosa? Se gli ufficiali della polizia di Los Angeles etichettassero un crimine come associato a una banda. Ora, forse il LAPD è al 100% oggettivo nelle loro determinazioni di ciò che è e non è legato alle gang. Ma se non lo sono, allora l’algoritmo riprodurrà i loro errori e pregiudizi “.

“QUINDI L’ALGORITMO È PRECISO NEL PREDIRE COSA? SE GLI UFFICIALI DELLA POLIZIA DI LOS ANGELES ETICHETTASSERO UN CRIMINE COME ASSOCIATO A UNA BANDA ”

Vi è ampia evidenza nel registro pubblico di inesattezze diffuse nei dati delle bande: un audit statale del California del CalGang nel database ha rilevato errori dilaganti, file che avrebbero dovuto essere epurati anni prima e affermazioni infondate di coinvolgimento delle bande.

Micha Gorelick, senior research engineer presso Cloudera Fast Forward Labs, società di ricerca di macchine intelligenti, aggiunge un’ulteriore obiezione: i dati di addestramento presumono che i territori delle gang non si siano spostati in almeno cinque anni. Alla domanda sull’uso della mappa del 2009 con i dati sul crimine 2014-16, Brantingham ha affermato che era il più recente a sua disposizione e che “C’è un certo movimento di territori nel tempo ma non tanto quanto si potrebbe pensare, in realtà. ”

Harvey, che è cresciuto nel quartiere di Lincoln Park affiliato al Sangue nel sud-est di San Diego, ha sottolineato che i territori e le alleanze di bande sono molto fluidi, e cinque anni sono un’eternità nella vita di strada. “Sei in grado di arrivare a una conclusione di qualcosa e non avere mai quell’interazione sul terreno con la comunità”, ha detto Harvey dell’approccio di ricerca di Brantingham.

“CODIFICA DEL PREGIUDIZIO RAZZIALE”.

Gorelick afferma che molte delle decisioni tecniche contenute nel documento sono eccessivamente semplicistiche e tecnicamente rudimentali, ma egli ritiene che la mappa territoriale della banda sia “la più nefasta delle caratteristiche utilizzate”. Valutando la probabilità che un crimine sia correlato a una gang basata su un’etichettatura generica di un quartiere come territorio di una banda “sta codificando per il pregiudizio geografico, che, specialmente in un luogo come Los Angeles, sta codificando per pregiudizi razziali”.

Wilson ha anche sottolineato che il documento non riesce a incorporare approcci documentati per valutare i risultati distorti nell’apprendimento automatico: “Gli autori avrebbero potuto [valutare se il loro algoritmo raggiungesse la parità statistica tra razze ed etnie … Potrebbero anche aver cercato i cosiddetti disparati maltrattamento cercando di vedere se gli errori di classificazione sono equamente distribuiti tra questi gruppi. Ma non hanno fatto nulla di tutto ciò, anche se i metodi per farlo sono ben noti nei giusti algoritmi e persino nella letteratura predittiva di polizia. ”

Per quanto riguarda l’insistenza di Brantingham e dei suoi coautori su quanto sia preliminare questa ricerca, Wilson ha osservato che una difesa simile è stata utilizzata per ricerche controverse che utilizzano l’intelligenza artificiale per identificare l’orientamento sessuale o la criminalità . Come nel caso di Brantingham, “entrambi questi studi avevano anche problemi metodologici fondamentali. Ma questo non elimina l’etica essenziale della ricerca stessa: dovremmo fare questa ricerca? ”

“DOVREMMO FARE QUESTA RICERCA?”

Milind Tambe del Centro per l’intelligenza artificiale e la società dell’USC ha sottolineato che il suo centro di ricerca, che ospita la nuova ricerca di Brantingham e collabora con la scuola di lavoro sociale dell’università, “si concentra sull’IA per il bene sociale” e che questa ricerca preliminare contribuisce a migliorare la comprensione del dominio per facilitare detto bene sociale. Ma il numero di critiche alle carenze tecniche ed etiche del documento solleva interrogativi sulla cui versione del bene sociale viene servita questa ricerca.

Per anni, PredPol è stato tormentato da critiche per la scarsità di profondità, ricchezza e rigore che il software apporta alla polizia. Questa nuova linea di ricerca suggerisce che Brantingham non ha criticato a fondo la sua metodologia di ricerca e sta portando avanti un progetto fondato su dati incompleti, metodi dubbi e una premessa che, se applicata sul campo, potrebbe portare a più gente di colore dietro le sbarre.

“SONO SOLO UN INGEGNERE.”

Kade Crockford, il capo del programma di tecnologia e libertà presso l’ACLU del Massachusetts, ha contestato la difesa “Sono solo un ingegnere” adottata da Hau Chan alla conferenza AIES.

“È davvero inquietante sentire che gli informatici che stanno lavorando alle sovvenzioni governative respingono le preoccupazioni etiche sul loro lavoro sulla base del fatto che sono semplicemente degli ingegneri, e quindi non hanno alcuna responsabilità di pensare alle conseguenze degli strumenti che hanno costruito”, ha detto Crockford. “È terrificante, e esiste solo perché la nostra società ha privilegiato l’ingegneria e l’informatica per una scienza sociale o un’educazione alle arti liberali”.