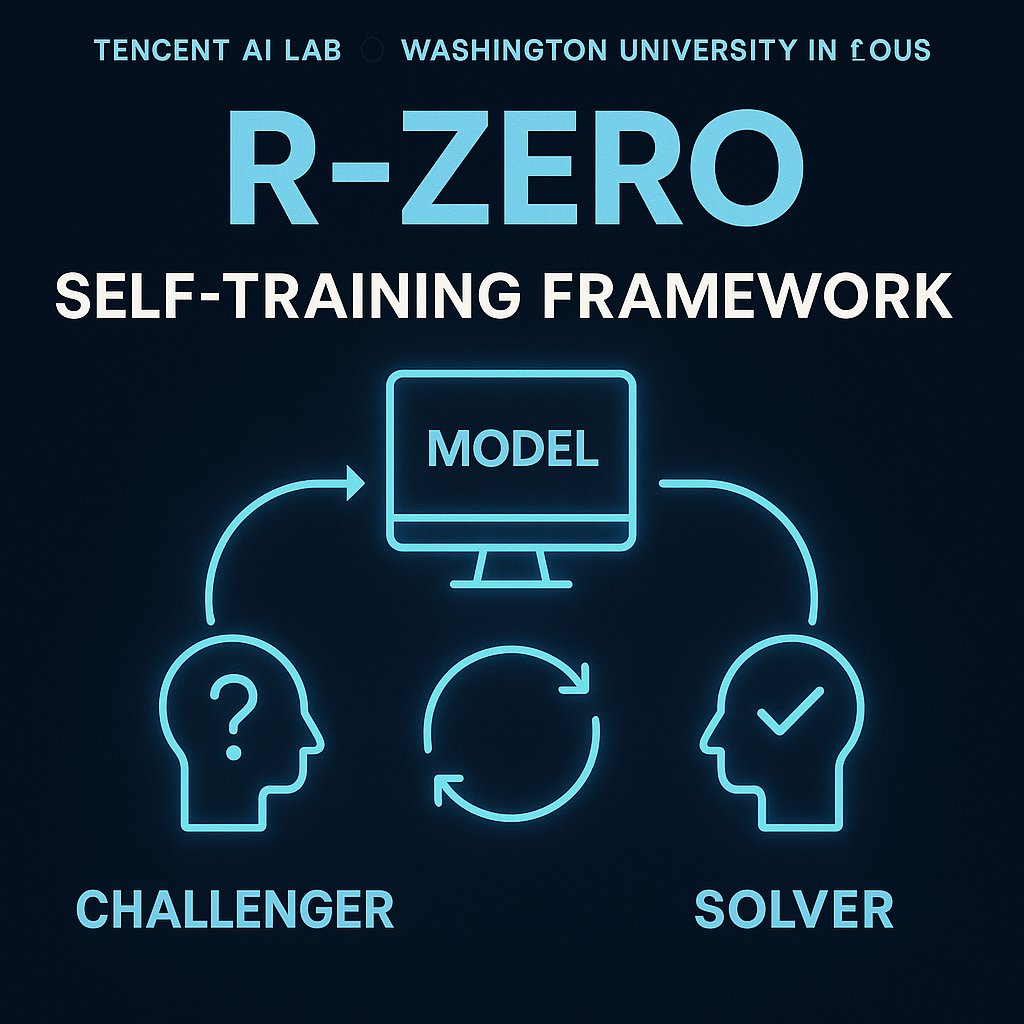

Ecco un framework brillante nato dalla collaborazione tra il Tencent AI Lab e la Washington University di St. Louis: si chiama R‑Zero, ed è un sistema di addestramento per modelli linguistici che non ha bisogno di dati etichettati—si genera da solo il proprio set di apprendimento, e impara autonomamente.

Il cuore del progetto è sorprendente nella sua semplicità ed eleganza: un unico modello base viene diviso in due parti, diventando Challenger e Solver, i quali si sfidano e si allenano a turno in un ciclo continuo. Il Challenger crea problemi vicini al limite delle capacità attuali del Solver: non banali, ma neanche impossibili. Il Solver, a sua volta, tenta di risolverli e viene ricompensato quando ci riesce. In questo modo si crea un “curriculum” interno, dinamico e adattivo, che spinge il modello verso nuove frontiere di ragionamento—senza mai attingere a dati umani annotati.

Finora, perfino i metodi più innovativi che eliminano le etichette umane (come i sistemi basati sulla fiducia nelle risposte del modello) necessitavano comunque di un corpus di problemi preesistenti. R‑Zero invece parte dal nulla e si evolve completamente in modo autonomo, un traguardo notevole nella corsa verso un’intelligenza artificiale davvero autonoma.

I test sui modelli Qwen3–4B e Qwen3–8B mostrano effetti quando R‑Zero entra in azione: il primo migliora del +6,49 punti nelle prove di ragionamento matematico, mentre il secondo segna +5,51 dopo tre iterazioni. Ma cosa ancor più rilevante, questi miglioramenti non restano confinati alla matematica: fosse generalizzato, il modello allestisce performance superiori anche su compiti generali come MMLU‑Pro o SuperGPQA, a segnalare una vera evoluzione di capacità cognitive.

Da un lato, R‑Zero offre risparmi concreti: meno tempo, meno costi, meno dipendenza dagli esseri umani per etichettare—e in settori specializzati, questo può trasformare l’approccio all’IA. Pure il concetto che l’IA si liberi dai lacci di ciò che è già noto dall’uomo è decisivo, verso un futuro in cui i modelli ragionano oltre il già scritto.

D’altro canto, emergono problemi sostanziali. La qualità delle risposte pseudo-etichettate dal Solver—che si basa su “majority voting” tra le sue stesse generazioni—scende con l’aumentare della complessità dei problemi: l’accuratezza passa dal 79 % al 63 % circa tra la prima e la terza iterazione, rispetto a un modello di riferimento come GPT‑4. Questo decadimento nella qualità rappresenta un limite da affrontare se si vuole garantire un miglioramento continuo.

I ricercatori non si fermano qui: per affrontare compiti più soggettivi—pensiamo alla scrittura creativa o al riassunto—propongono di introdurre un terzo modello, un Verifier o Critic, che giudichi la qualità delle risposte del Solver. In questo way, il loop diventerebbe un “Challenger → Solver → Verifier”, tutti in continua co-evoluzione con criteri più raffinati e meno legati a certi/generici output.

R-Zero non è solo un’innovazione tecnica, ma un messaggio forte: l’IA può imparare da sola, generare le proprie sfide e imparare progressivamente a ragionare in modo più sofisticato di quanto possiamo immaginare. Anche se il paradigma richiede ancora affinamenti, specialmente nella manutenzione della qualità delle risposte generate autonomamente, la strada tracciata è chiara: un futuro in cui i modelli non sono semplici apri-finestra sui dati umani, ma fabbriche autonome della propria conoscenza.