Negli ultimi anni, lo sviluppo dell’intelligenza artificiale è stato dominato da una logica chiara: costruire modelli sempre più grandi, sempre più potenti, sempre più generalisti. I Large Language Models sono diventati il centro dell’innovazione, con architetture progettate per incorporare quantità crescenti di conoscenza e capacità in un’unica entità. Tuttavia, questo approccio ha mostrato limiti evidenti, soprattutto quando si tratta di affrontare problemi complessi e multidisciplinari. È proprio in questo contesto che si inserisce la proposta di Sakana AI, che con il sistema “Fugu” introduce un cambio di paradigma radicale: non più un singolo modello dominante, ma un sistema dinamico di intelligenze specializzate che collaborano in tempo reale.

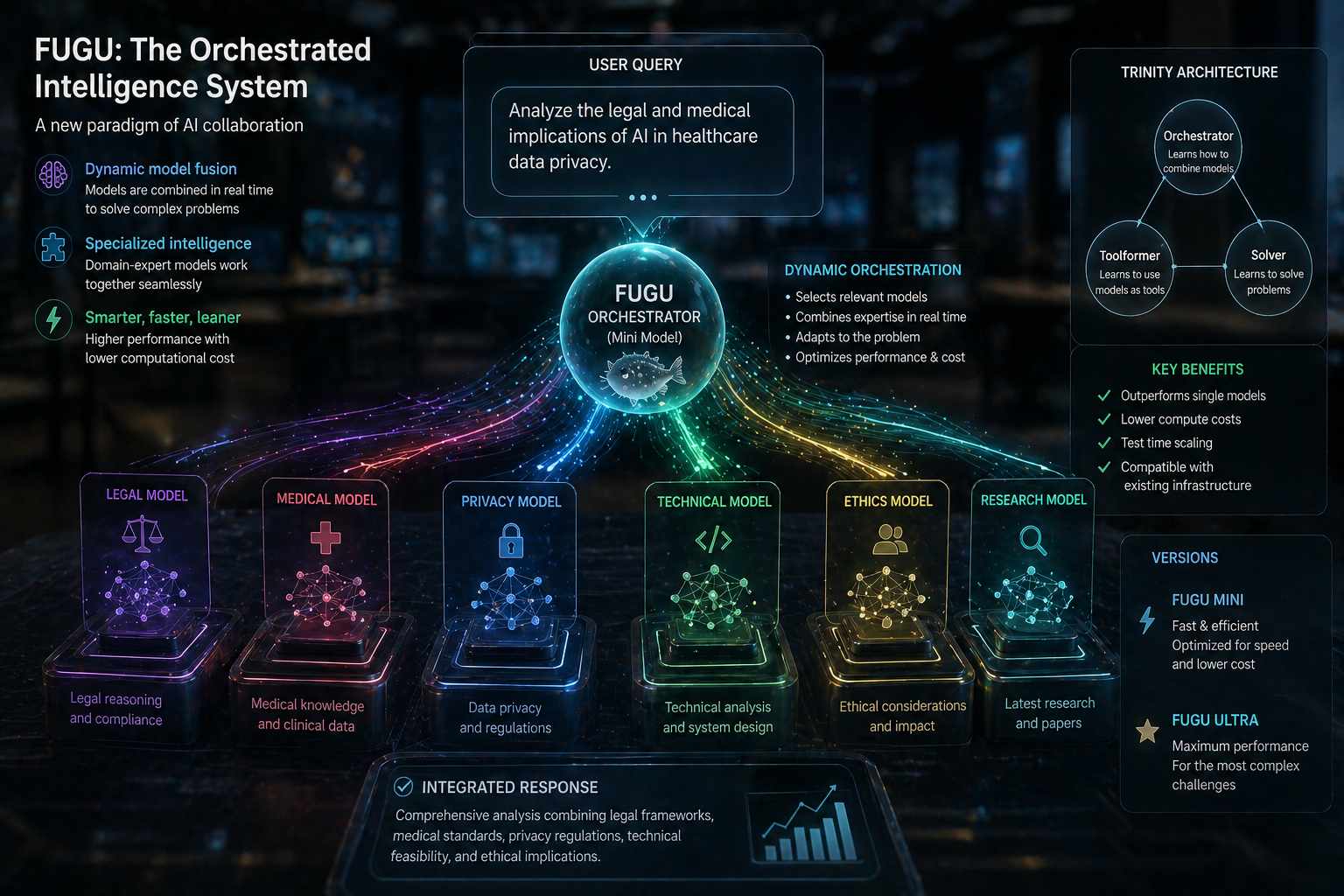

Il cuore di Fugu è un’architettura di orchestrazione avanzata che supera il concetto tradizionale di routing tra modelli. Nei sistemi precedenti, l’orchestrazione si limitava a scegliere quale modello utilizzare in base al tipo di richiesta, instradando il problema verso il componente più adatto. Fugu va oltre questo schema lineare e introduce una logica molto più sofisticata: i modelli non vengono semplicemente selezionati, ma combinati. In altre parole, il sistema costruisce dinamicamente un “modello virtuale” integrato, calibrando in tempo reale il contributo di ciascun modello in funzione del problema da risolvere.

Questa capacità di fusione dinamica rappresenta un’evoluzione significativa. Invece di affidarsi a un’unica architettura generalista, il sistema utilizza modelli specializzati in domini diversi – dal diritto alla medicina, dalla programmazione all’analisi tecnica – e li integra come se fossero componenti modulari. Il risultato è una forma di intelligenza collettiva, in cui le competenze non sono concentrate in un unico modello, ma distribuite e coordinate.

Alla base di questo approccio ci sono le architetture “Trinity” e “Conductor”, presentate da Sakana AI in contesti accademici avanzati. Queste strutture permettono al sistema di apprendere non solo come risolvere problemi, ma anche come orchestrare altri modelli per farlo nel modo più efficiente possibile. In questo senso, Fugu non è semplicemente un modello, ma un meta-sistema che gestisce altri modelli, decidendo quando e come utilizzarli.

Un aspetto particolarmente interessante è il ruolo del modello centrale, che non è un LLM gigantesco, ma un modello relativamente piccolo. Questo modello funge da orchestratore, imparando a richiamare e combinare altri modelli più grandi solo quando necessario. Questa scelta progettuale consente di ridurre i costi computazionali, mantenendo al contempo un’elevata flessibilità operativa. Il sistema non spreca risorse mantenendo sempre attivi modelli complessi, ma li attiva selettivamente in base alle esigenze.

Inoltre, Fugu introduce una capacità avanzata di “test time scaling”, ovvero la possibilità di aumentare le prestazioni durante la fase di utilizzo, senza modificare l’addestramento di base. Questo è possibile grazie alla capacità del sistema di richiamare strutture apprese durante il training e riutilizzarle in modo adattivo. In pratica, il sistema diventa più potente non perché cresce in dimensioni, ma perché utilizza in modo più intelligente le risorse disponibili.

I risultati ottenuti nei benchmark indicano che questo approccio può superare le prestazioni dei modelli singoli, anche di grandi dimensioni. Questo dato è particolarmente significativo, perché dimostra che la scalabilità non deve necessariamente passare attraverso l’aumento delle dimensioni di un singolo modello. Al contrario, può emergere dalla capacità di coordinare più modelli in modo efficiente.

Il sistema è stato progettato per essere compatibile con le infrastrutture esistenti. Le API sono pensate per integrarsi facilmente con ambienti già basati su modelli come quelli utilizzati oggi nelle aziende, riducendo le barriere all’adozione. Questo suggerisce che l’obiettivo non è sostituire completamente i sistemi attuali, ma evolverli verso una maggiore modularità e flessibilità.

La disponibilità di due versioni, Fugu Mini e Fugu Ultra, riflette proprio questa logica. La prima privilegia la velocità e l’efficienza, mentre la seconda punta alle massime prestazioni nei contesti più complessi. Questa differenziazione indica che l’orchestrazione non è solo una questione di architettura, ma anche di strategia operativa: scegliere il giusto equilibrio tra costo, velocità e qualità in base al contesto.

Il progetto si inserisce in una visione più ampia portata avanti da Sakana AI, secondo cui il futuro dell’intelligenza artificiale non risiede in modelli monolitici sempre più grandi, ma in ecosistemi di agenti specializzati. Questa visione richiama, in parte, modelli biologici e sistemi complessi, dove l’intelligenza emerge dall’interazione tra componenti relativamente semplici, piuttosto che da un’unica struttura centralizzata.