I ricercatori di Google e del Politecnico Federale di Losanna (EPFL) hanno introdotto Simula, un framework sistematico che segna il superamento della generazione di dati sintetici intesa come semplice imitazione statistica. A differenza dei metodi tradizionali che si limitano a replicare o espandere dataset esistenti, Simula adotta un approccio basato sul design dei meccanismi, trattando la creazione del dato come un problema di ingegneria strutturato sui primi principi, ovvero sulle leggi fondamentali che governano la logica, la fisica e l’economia.

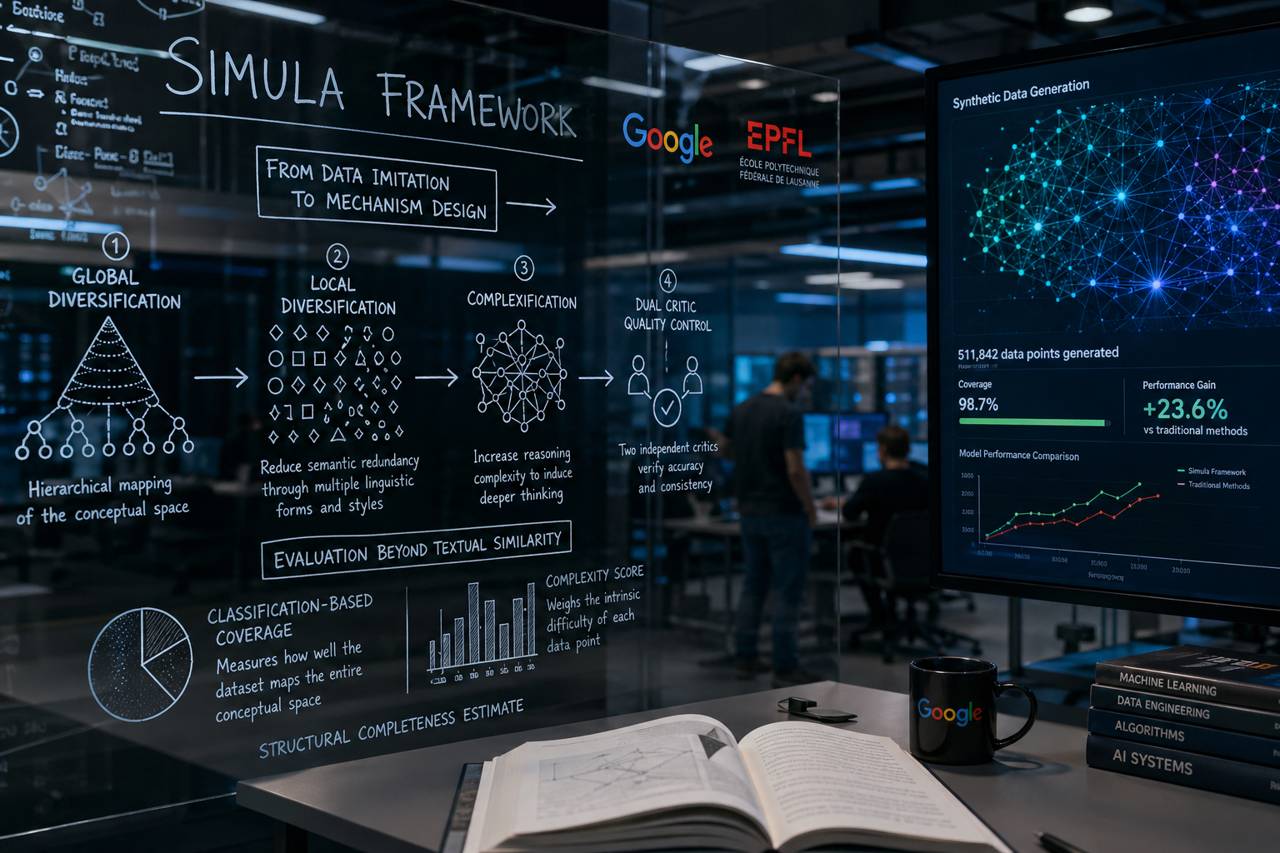

L’architettura tecnica di Simula si discosta radicalmente dai modelli generativi convenzionali che dipendono da “seed” o dati di partenza parziali presi dal web. In settori come la medicina, il diritto o la sicurezza informatica, dove i dati reali sono scarsi o protetti da rigorose norme sulla privacy, Simula costruisce set di dati partendo da zero attraverso una decomposizione logica del dominio di riferimento. Il processo inizia con la fase di diversificazione globale, in cui la struttura concettuale di un campo specifico viene mappata in un sistema di classificazione gerarchica. Questa tassonomia complessa assicura che lo spazio dei dati sia coperto in modo uniforme, prevenendo i pregiudizi algoritmici e garantendo che il modello finale non sia polarizzato verso specifici sottodomini solo perché più presenti nelle fonti testuali comuni.

Il cuore operativo del framework si sviluppa attraverso un ciclo iterativo di proposta e affinamento suddiviso in quattro fasi distinte. Dopo la strutturazione gerarchica iniziale, interviene la diversificazione locale, che mira a ridurre la ridondanza semantica esprimendo lo stesso concetto attraverso una pluralità di forme e stili linguistici. Successivamente, la fase di complessificazione agisce direttamente sulle capacità di ragionamento del modello di IA: qui, i dati vengono resi intenzionalmente più sofisticati e articolati per forzare il modello a sviluppare logiche di pensiero più profonde. Infine, l’affidabilità dell’intero dataset è garantita da un protocollo di controllo qualità denominato a doppio critico, dove due istanze indipendenti valutano l’accuratezza e la coerenza del dato generato prima della sua approvazione finale.

Simula non introduce solo una nuova metodologia di generazione, ma stabilisce anche standard inediti per la valutazione dei dati sintetici. Superando le metriche basate sulla semplice similarità testuale, il framework introduce la copertura basata sulla classificazione, un indicatore che misura quantitativamente quanto il dataset riesca a mappare l’intero spazio concettuale definito in fase di progettazione. A questo si aggiunge il punteggio di complessità, che permette di pesare la difficoltà intrinseca di ogni singolo punto dati, fornendo una stima precisa della completezza strutturale dell’addestramento. Durante i test sperimentali, l’applicazione di oltre 510.000 punti dati generati con questo metodo ha dimostrato prestazioni superiori rispetto ai modelli addestrati con tecniche tradizionali, confermando l’efficacia del passaggio dalla quantità alla qualità strutturale.

L’impatto di Simula è già visibile nelle applicazioni pratiche di Google, che ha integrato questa tecnologia nel proprio ecosistema per potenziare i modelli di sicurezza, l’IA on-device e i sistemi di rilevamento dello spam. In particolare, il framework si è rivelato cruciale nella simulazione di scenari di rischio futuri e attacchi informatici sofisticati, contesti in cui i dati reali sono per definizione rari o inesistenti. In definitiva, Simula si propone come l’infrastruttura centrale per l’IA di prossima generazione, spostando l’enfasi dalla raccolta passiva di informazioni su Internet alla progettazione attiva di esperienze di apprendimento che inducono i modelli a comprendere le leggi logiche e fisiche del mondo reale attraverso meccanismi sintetici ma rigorosamente strutturati.