Il pioniere dell’intelligenza artificiale (AI) Geoffrey Hinton, uno dei pionieri della “rivoluzione” del deep learning iniziata dieci anni fa, afferma che il rapido progresso dell’IA continuerà ad accelerare.

In un’intervista prima del decimo anniversario della ricerca sulle reti neurali chiave che ha portato a un’importante svolta nell’IA nel 2012, Hinton e altri importanti luminari dell’IA hanno risposto al fuoco di alcuni critici che affermano che il deep learning ha “urtato un muro”.

Tavola rotonda dall’alfabetizzazione ai dati alla competenza: un viaggio per intrecciare dati e apprendimento nella cultura aziendale

“Vedremo grandi progressi nella robotica: robot abili, agili e più conformi che fanno le cose in modo più efficiente e delicato come facciamo noi”, ha affermato Hinton.

Altri pionieri dell’IA, tra cui Yann LeCun , capo dell’IA e scienziato capo presso Meta e il professore della Stanford University Fei-Fei Li, concordano con Hinton sul fatto che i risultati dell’innovativa ricerca del 2012 sul database ImageNet, che è stato costruito sul lavoro precedente per sbloccare significativi i progressi nella visione artificiale in particolare e il deep learning in generale hanno spinto il deep learning nel mainstream e hanno innescato un enorme slancio che sarà difficile da fermare.

LeCun ha affermato che gli ostacoli vengono eliminati a una velocità incredibile e accelerata. “I progressi negli ultimi quattro o cinque anni sono stati sorprendenti”, ha aggiunto.

E Li, che nel 2006 ha inventato ImageNet, un set di dati su larga scala di foto annotate dall’uomo per lo sviluppo di algoritmi di visione artificiale, ha detto a VentureBeat che l’evoluzione del deep learning dal 2012 è stata “una rivoluzione fenomenale che non avrei mai potuto sognare”.

Tuttavia, il successo tende ad attirare i critici. E ci sono voci forti che denunciano i limiti del deep learning e affermano che il suo successo ha una portata estremamente ristretta. Sostengono anche che il clamore che le reti neurali hanno creato sia proprio questo, e non è vicino a essere la svolta fondamentale che alcuni sostenitori affermano che sia: che è la base che alla fine ci aiuterà a raggiungere la prevista “intelligenza generale artificiale” ( AGI), dove l’IA è veramente simile a quella umana nel suo potere di ragionamento.

Guardando indietro a un decennio in forte espansione dell’IA

Gary Marcus, professore emerito alla NYU e fondatore e CEO di Robust.AI, lo scorso marzo ha scritto sul deep learning ” colpire un muro ” e afferma che, sebbene ci siano stati sicuramente dei progressi, “siamo abbastanza bloccati sulla conoscenza del buon senso e sul ragionamento sul mondo fisico”.

Ed Emily Bender, professoressa di linguistica computazionale all’Università di Washington e critica abituale di quella che lei chiama la ” bolla del deep learning “, ha affermato che non pensa che l’elaborazione del linguaggio naturale (PNL) e i modelli di visione artificiale di oggi si sommano a ” passi sostanziali” verso “ciò che gli altri intendono per AI e AGI”.

Indipendentemente da ciò, ciò che i critici non possono togliere è che sono già stati compiuti enormi progressi in alcune applicazioni chiave come la visione artificiale e il linguaggio che hanno messo migliaia di aziende in una corsa per sfruttare il potere del deep learning, potere che ha già ceduto risultati impressionanti in motori di raccomandazione, software di traduzione, chatbot e molto altro.

Tuttavia, ci sono anche seri dibattiti sul deep learning che non possono essere ignorati. Ci sono questioni essenziali da affrontare riguardo all’etica e ai pregiudizi dell’IA, ad esempio, nonché domande su come la regolamentazione dell’IA può proteggere il pubblico dall’essere discriminato in aree come l’occupazione, l’assistenza medica e la sorveglianza.

Nel 2022, mentre guardiamo indietro a un decennio in piena espansione dell’IA, VentureBeat voleva sapere quanto segue: quali lezioni possiamo imparare dall’ultimo decennio di progressi nel deep learning? E cosa riserva il futuro per questa tecnologia rivoluzionaria che sta cambiando il mondo, nel bene e nel male?

Geoffrey Hinton

I pionieri dell’IA sapevano che sarebbe arrivata una rivoluzione

Hinton dice di aver sempre saputo che la “rivoluzione” del deep learning stava arrivando.

“Molti di noi erano convinti che questo dovesse essere il futuro [dell’intelligenza artificiale]”, ha affermato Hinton, il cui articolo del 1986 ha reso popolare l’algoritmo di backpropagation per l’addestramento di reti neurali multistrato. “Siamo riusciti a dimostrare che ciò in cui avevamo sempre creduto era corretto”.

LeCun, che ha aperto la strada all’uso della backpropagation e delle reti neurali convoluzionali nel 1989, è d’accordo. “Avevo pochissimi dubbi sul fatto che alla fine sarebbero state adottate tecniche simili a quelle che avevamo sviluppato negli anni ’80 e ’90”, ha detto.

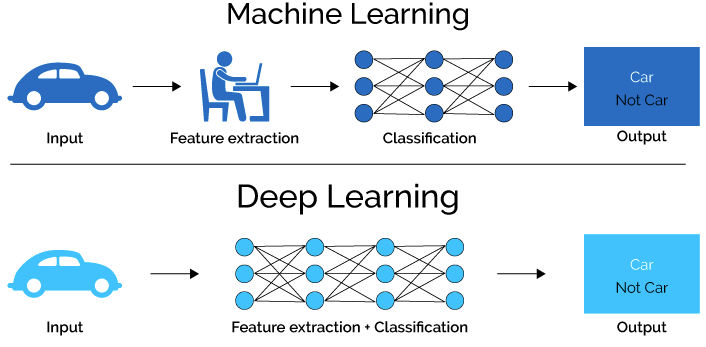

Ciò che Hinton e LeCun, tra gli altri, credevano fosse una visione contrarian secondo cui le architetture di apprendimento profondo come le reti neurali multistrato potrebbero essere applicate a campi come la visione artificiale, il riconoscimento vocale, la PNL e la traduzione automatica per produrre risultati buoni o migliori di quelli umani esperti. Respingendo i critici che spesso si rifiutavano anche solo di prendere in considerazione la loro ricerca, hanno sostenuto che le tecniche algoritmiche come la backpropagation e le reti neurali convoluzionali erano la chiave per far ripartire il progresso dell’IA, che si era bloccato da una serie di battute d’arresto negli anni ’80 e ’90.

ANNUNCIO

Nel frattempo, Li, che è anche condirettore dello Stanford Institute for Human-Centered AI ed ex capo scienziata di AI e machine learning di Google, era anche fiduciosa che la sua ipotesi – che con gli algoritmi giusti, il database ImageNet detenesse la chiave per il progresso della visione artificiale e della ricerca sull’apprendimento profondo — era corretto.

“Era un modo molto fuori dagli schemi di pensare all’apprendimento automatico e a una mossa ad alto rischio”, ha detto, ma “abbiamo creduto scientificamente che la nostra ipotesi fosse giusta”.

Tuttavia, tutte queste teorie, sviluppate nel corso di diversi decenni di ricerca sull’IA, non si sono completamente dimostrate fino all’autunno del 2012. Fu allora che si verificò una svolta che molti dicono abbia innescato una nuova rivoluzione del deep learning .

Nell’ottobre 2012, Alex Krizhevsky e Ilya Sutskever, insieme a Hinton come dottorandi. advisor, ha partecipato al concorso ImageNet, fondato da Li per valutare algoritmi progettati per il rilevamento di oggetti su larga scala e la classificazione delle immagini. Il trio ha vinto con il documento ImageNet Classification with Deep Convolutional Neural Networks , che ha utilizzato il database ImageNet per creare una rete neurale pionieristica nota come AlexNet. Si è rivelato molto più accurato nella classificazione di immagini diverse rispetto a qualsiasi cosa fosse arrivata prima.

Il documento, che ha entusiasmato la comunità di ricerca sull’IA, si è basato su scoperte precedenti e, grazie al set di dati ImageNet e a un hardware GPU più potente, ha portato direttamente alle principali storie di successo dell’IA del prossimo decennio: da Google Foto, Google Translate e Uber ad Alexa, DALL-E e AlphaFold.

Da allora, gli investimenti nell’IA sono cresciuti in modo esponenziale: il finanziamento globale delle startup dell’IA è cresciuto da $ 670 milioni nel 2011 a $ 36 miliardi di dollari USA nel 2020, per poi raddoppiare di nuovo a $ 77 miliardi nel 2021 .

L’anno in cui le reti neurali sono diventate mainstream

Dopo il concorso ImageNet del 2012, i media hanno rapidamente ripreso la tendenza del deep learning. Un articolo del New York Times del mese successivo, Scientists See Promise in Deep-Learning Programs [abbonamento richiesto], affermava: “Utilizzando una tecnica di intelligenza artificiale ispirata a teorie su come il cervello riconosce i modelli, le aziende tecnologiche stanno segnalando guadagni sorprendenti in campi così diversi come la visione artificiale, il riconoscimento vocale e l’identificazione di nuove molecole promettenti per la progettazione di farmaci”. La novità, prosegue l’articolo, “è la velocità e l’accuratezza crescenti dei programmi di apprendimento profondo, spesso chiamati reti neurali artificiali o semplicemente ‘reti neurali’ per la loro somiglianza con le connessioni neurali nel cervello”.

Quell’anno AlexNet non era il solo a fare grandi novità sul deep learning: nel giugno 2012, i ricercatori del laboratorio X di Google hanno costruito una rete neurale composta da 16.000 processori di computer con un miliardo di connessioni che, nel tempo, hanno iniziato a identificare caratteristiche “simili a un gatto” fino a quando non è stato in grado di riconoscere i video di gatti su YouTube con un alto grado di precisione. Allo stesso tempo, Jeffrey Dean e Andrew Ng stavano svolgendo un lavoro rivoluzionario sul riconoscimento di immagini su larga scala presso Google Brain. E alla conferenza IEEE del 2012 su Computer Vision e Pattern Recognition, i ricercatori Dan Ciregan et al. significativamente migliorato rispetto alle migliori prestazioni per le reti neurali convoluzionali su più database di immagini.

Nel complesso, nel 2013, “praticamente tutta la ricerca sulla visione artificiale è passata alle reti neurali”, ha affermato Hinton, che da allora ha diviso il suo tempo tra Google Research e l’Università di Toronto. È stato un cambiamento quasi totale dell’intelligenza artificiale rispetto al recente 2007, ha aggiunto, quando “non era appropriato avere due articoli sull’apprendimento profondo a una conferenza”.

ANNUNCIO

Fei-Fei Li

ANNUNCIO

Un decennio di progressi nell’apprendimento profondo

Li ha detto che il suo intimo coinvolgimento nelle scoperte del deep learning – ha annunciato personalmente il vincitore del concorso ImageNet alla conferenza del 2012 a Firenze, in Italia – significa che non sorprende che le persone riconoscano l’importanza di quel momento.

“[ImageNet] era una visione iniziata nel 2006 che quasi nessuno supportava”, ha affermato Li. Ma, ha aggiunto, “è stato davvero ripagato in un modo così storico e epocale”.

Dal 2012, i progressi nell’apprendimento profondo sono stati sia sorprendentemente veloci che straordinariamente profondi.

“Ci sono ostacoli che vengono eliminati a una velocità incredibile”, ha affermato LeCun, citando i progressi nella comprensione del linguaggio naturale, nella traduzione nella generazione di testi e nella sintesi delle immagini.

Alcune aree sono addirittura progredite più rapidamente del previsto. Per Hinton, ciò include l’uso delle reti neurali nella traduzione automatica, che ha fatto grandi passi avanti nel 2014. “Pensavo che sarebbero passati molti più anni”, ha detto. E Li ha ammesso che i progressi nella visione artificiale, come DALL-E, “si sono mossi più velocemente di quanto pensassi”.

Licenziare i critici del deep learning

Tuttavia, non tutti sono d’accordo sul fatto che i progressi nell’apprendimento profondo siano stati sbalorditivi. Nel novembre 2012, Gary Marcus, professore emerito alla NYU e fondatore e CEO di Robust.AI, ha scritto un articolo per il New Yorker [abbonamento richiesto] in cui affermava: “Per parafrasare una vecchia parabola, Hinton ha costruito una scala migliore ; ma una scala migliore non ti porta necessariamente sulla luna.

Oggi, Marcus afferma di non pensare che il deep learning abbia avvicinato l’IA alla “luna” – la luna è un’intelligenza artificiale generale o IA a livello umano – di quanto non fosse dieci anni fa.

ANNUNCIO

“Certo che ci sono stati progressi, ma per arrivare sulla luna, dovresti risolvere la comprensione causale e la comprensione e il ragionamento del linguaggio naturale”, ha detto. “Non ci sono stati molti progressi su queste cose.”

Marcus ha affermato di ritenere che i modelli ibridi che combinano le reti neurali con l’intelligenza artificiale simbolica , il ramo dell’IA che dominava il campo prima dell’ascesa del deep learning, siano la via da seguire per combattere i limiti delle reti neurali.

Da parte loro, sia Hinton che LeCun respingono le critiche di Marcus.

“[Il deep learning] non ha colpito un muro: se guardi ai progressi di recente, è stato sorprendente”, ha affermato Hinton, sebbene in passato abbia riconosciuto che il deep learning è limitato nella portata dei problemi che può risolvere.

Non ci sono “muri colpiti”, ha aggiunto LeCun. “Penso che ci siano ostacoli da chiarire e soluzioni a quegli ostacoli che non sono del tutto noti”, ha affermato. “Ma non vedo alcun rallentamento del progresso… il progresso sta accelerando, semmai.”

Tuttavia, Bender non è convinto. “Nella misura in cui parlano semplicemente di progressi verso la classificazione delle immagini in base alle etichette fornite in benchmark come ImageNet, sembra che il 2012 abbia avuto alcune scoperte qualitative”, ha detto a VentureBeat via e-mail. “Se stanno parlando di qualcosa di più grande di quello, è tutto clamore”.

I problemi di pregiudizio ed etica dell’IA incombono su grandi dimensioni

In altri modi, Bender sostiene anche che il campo dell’IA e del deep learning è andato troppo oltre. “Penso che la capacità (potenza di calcolo + algoritmi efficaci) di elaborare set di dati molto grandi in sistemi in grado di generare testo e immagini sintetici ci abbia portato a superare i nostri sci in diversi modi”, ha affermato. Ad esempio, “sembra che siamo bloccati in un ciclo di persone che ‘scoprono’ che i modelli sono prevenuti e propongono di provare a distorcerli, nonostante i risultati consolidati secondo cui non esiste un set di dati o un modello completamente distorto”.

Inoltre, ha affermato che vorrebbe “vedere il campo tenuto a standard reali di responsabilità, sia per le affermazioni empiriche fatte effettivamente in fase di test sia per la sicurezza del prodotto – affinché ciò avvenga, avremo bisogno del pubblico in generale per capire cosa è in gioco, così come come vedere attraverso le affermazioni pubblicitarie dell’IA e avremo bisogno di una regolamentazione efficace “.

Tuttavia, LeCun ha sottolineato che “queste sono domande complicate e importanti che le persone tendono a semplificare” e molte persone “hanno presupposti di cattive intenzioni”. La maggior parte delle aziende, ha affermato, “vogliono davvero fare la cosa giusta”.

Inoltre, si è lamentato di coloro che non sono coinvolti nella scienza, nella tecnologia e nella ricerca sull’IA.

“Hai un intero ecosistema di persone che sparano dalle gradinate”, ha detto, “e fondamentalmente stanno solo attirando l’attenzione”.

I dibattiti sul deep learning continueranno sicuramente

Per quanto accesi possano sembrare questi dibattiti, Li sottolinea che sono ciò che riguarda la scienza. “La scienza non è la verità, la scienza è un viaggio alla ricerca della verità”, ha detto. “È il viaggio per scoprire e migliorare, quindi i dibattiti, le critiche, la celebrazione ne fanno parte”.

Tuttavia, alcuni dei dibattiti e delle critiche la sembrano “un po’ forzati”, con estremi su entrambi i lati, sia che si tratti di dire che l’IA è del tutto sbagliata o che l’AGI è dietro l’angolo. “Penso che sia una versione relativamente popolare di un dibattito scientifico più profondo, molto più sottile, più sfumato e più multidimensionale”, ha detto.

Certamente, ha sottolineato Li, ci sono state delusioni nei progressi dell’IA negli ultimi dieci anni, e non sempre per quanto riguarda la tecnologia. “Penso che la cosa più deludente sia stata nel 2014 quando, insieme alla mia ex studentessa, ho cofondato AI4ALL e ho iniziato a portare nel mondo dell’IA giovani donne, studenti di colore e studenti di comunità svantaggiate”, ha detto. “Volevamo vedere un futuro molto più diversificato nel mondo dell’IA”.

Anche se sono passati solo otto anni, ha insistito sul fatto che il cambiamento è ancora troppo lento. “Mi piacerebbe vedere cambiamenti più rapidi e più profondi e non vedo abbastanza sforzi nell’aiutare la pipeline, specialmente nella fascia di età delle scuole medie e superiori”, ha detto. “Abbiamo già perso così tanti studenti di talento”.

Il futuro dell’IA e del deep learning

LeCun ammette che alcune sfide dell’IA a cui le persone hanno dedicato un’enorme quantità di risorse non sono state risolte, come la guida autonoma.

“Direi che altre persone ne hanno sottovalutato la complessità”, ha detto, aggiungendo che non si colloca in quella categoria. “Sapevo che era difficile e che ci sarebbe voluto molto tempo”, ha affermato. “Non sono d’accordo con alcune persone che affermano che in pratica abbiamo capito tutto … [che] si tratta solo di ingrandire quei modelli”.

In effetti, LeCun ha recentemente pubblicato un progetto per la creazione di “intelligenza artificiale autonoma” che mostra anche come pensa che gli attuali approcci all’IA non ci porteranno all’IA a livello umano.

Ma vede anche ancora un vasto potenziale per il futuro del deep learning: ciò di cui è personalmente più entusiasta e su cui lavora attivamente, dice, è far sì che le macchine imparino in modo più efficiente, più simili agli animali e agli umani.

“La grande domanda per me è qual è il principio alla base su cui si basa l’apprendimento degli animali: questo è uno dei motivi per cui ho sostenuto cose come l’apprendimento autocontrollato”, ha detto. “Quel progresso ci permetterebbe di costruire cose che attualmente siamo completamente fuori portata, come sistemi intelligenti che possono aiutarci nella nostra vita quotidiana come se fossero assistenti umani, che è qualcosa di cui avremo bisogno perché siamo tutti indosseranno occhiali per realtà aumentata e dovremo interagire con loro.

Hinton concorda sul fatto che sono in arrivo molti più progressi nell’apprendimento profondo. Oltre ai progressi della robotica, crede anche che ci sarà un’altra svolta nell’infrastruttura computazionale di base per le reti neurali, perché “attualmente è solo il calcolo digitale fatto con acceleratori che sono molto bravi a fare moltiplicatori di matrici”. Per la backpropagation, ha detto, i segnali analogici devono essere convertiti in digitali.

“Penso che troveremo alternative alla backpropagation che funzionino nell’hardware analogico”, ha affermato. “Sono abbastanza convinto che a lungo termine avremo quasi tutti i calcoli eseguiti in analogico.”

Li dice che ciò che è più importante per il futuro del deep learning è la comunicazione e l’istruzione. “[A Stanford HAI], in realtà spendiamo una quantità eccessiva di sforzi per educare leader aziendali, governo, politici, media, giornalisti e giornalisti e la società giusta in generale, e creare simposi, conferenze, workshop, pubblicare documenti politici, documenti del settore, ” lei disse.

Con una tecnologia così nuova, ha aggiunto, “Personalmente sono molto preoccupata che la mancanza di conoscenze di base non aiuti a trasmettere una descrizione più sfumata e più ponderata di cosa si tratta in questo momento”.

Come saranno ricordati 10 anni di deep learning

Per Hinton, l’ultimo decennio ha offerto un successo nell’apprendimento profondo “oltre i miei sogni più sfrenati”.

Ma sottolinea che mentre il deep learning ha ottenuto enormi guadagni, dovrebbe anche essere ricordato come un’era di progressi nell’hardware dei computer. “È tutto dovuto ai progressi nell’hardware dei computer”, ha detto.

Critici come Marcus affermano che, sebbene siano stati compiuti alcuni progressi con il deep learning, “Penso che potrebbe essere visto con il senno di poi come una sorta di disavventura”, ha detto. “Penso che le persone nel 2050 guarderanno ai sistemi dal 2022 e diranno, sì, sono stati coraggiosi, ma non hanno funzionato davvero”.

Ma Li spera che l’ultimo decennio venga ricordato come l’inizio di una “grande rivoluzione digitale che sta facendo vivere e lavorare meglio tutti gli esseri umani, non solo pochi umani o segmenti di esseri umani”.

Come scienziata, ha aggiunto: “Non vorrò mai pensare che il deep learning di oggi sia la fine dell’esplorazione dell’IA”. E a livello sociale, ha affermato di voler vedere l’IA come “un incredibile strumento tecnologico che viene sviluppato e utilizzato nel modo più incentrato sull’uomo: è imperativo riconoscere l’impatto profondo di questo strumento e abbracciare il quadro di pensiero incentrato sull’uomo e progettare e implementare l’IA”.

Dopotutto, ha sottolineato: “Il modo in cui saremo ricordati dipende da ciò che stiamo facendo ora”.