Negli ultimi mesi, Anthropic ha iniziato a raccontare pubblicamente un cambiamento profondo nel modo in cui viene sviluppato il software al suo interno. Non si tratta di un semplice aumento dell’uso di strumenti di supporto alla programmazione, ma di una vera e propria trasformazione strutturale: oggi la maggior parte del codice dei prodotti Anthropic viene scritta direttamente da Claude, mentre gli ingegneri assumono un ruolo sempre più orientato alla revisione, al controllo e all’architettura dei sistemi.

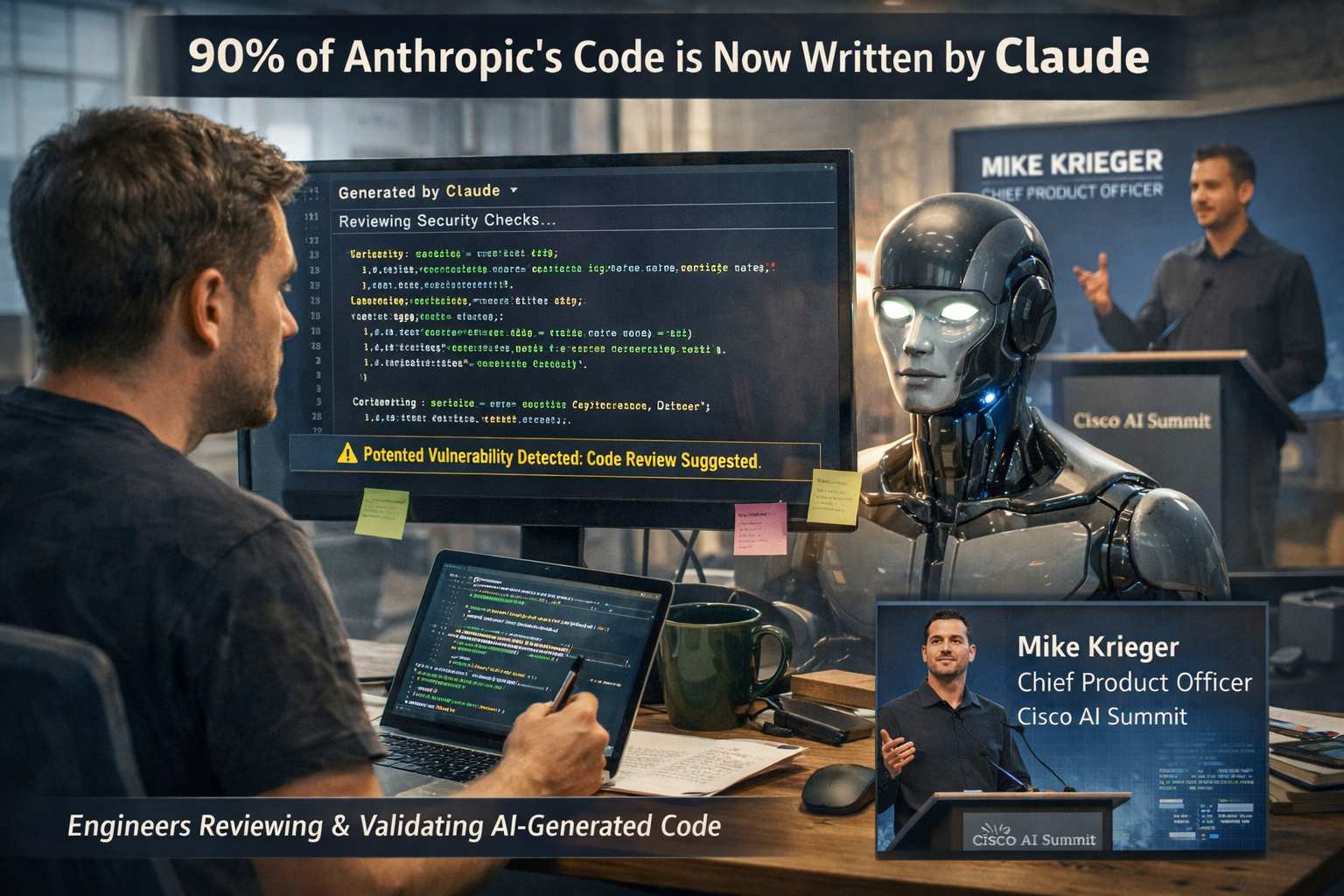

A descrivere questo passaggio è stato Mike Krieger, Chief Product Officer dell’azienda, durante un intervento al Cisco AI Summit. Krieger ha spiegato che oggi la quasi totalità dei prodotti Anthropic è sviluppata con codice generato da Claude e che anche iniziative recenti, come Claude Cowork, sono state realizzate integralmente dall’intelligenza artificiale in tempi estremamente ridotti. Secondo quanto raccontato, il progetto è stato completato in appena tre settimane, un risultato che fino a poco tempo fa sarebbe sembrato difficilmente credibile.

Questa evoluzione non è arrivata all’improvviso. Krieger ha ricordato come circa un anno prima il CEO Dario Amodei avesse dichiarato che entro la fine dell’anno il 90% del codice sarebbe stato scritto da Claude. All’epoca, l’affermazione era stata accolta con scetticismo, ma oggi Anthropic sostiene di essere molto vicina a quel traguardo. Il cambiamento non riguarda solo la quantità di codice generato dall’IA, ma soprattutto il modo in cui questo codice viene gestito e validato.

In questo nuovo modello, gli ingegneri non sono più impegnati a scrivere manualmente migliaia di righe di codice, ma a formare Claude affinché diventi un revisore affidabile e rigoroso. All’interno dell’azienda circolano regolarmente richieste di pull molto estese, spesso comprese tra le duemila e le tremila righe, soprattutto nei team di ricerca e sviluppo che evolvono rapidamente. Per rendere sostenibile questo flusso, Anthropic ha costruito una solida impalcatura di verifica attorno a Claude, progettata per garantire che il codice prodotto sia coerente, sicuro e allineato ai principi architetturali dell’organizzazione.

Questa “impalcatura”, come la definisce Krieger, include sistemi di verifica automatizzati e meccanismi di sicurezza pensati per evitare comportamenti anomali o errori critici nel codice generato dall’intelligenza artificiale. Un aspetto particolarmente interessante è l’addestramento di Claude come revisore di codice “antagonista”. In pratica, il modello è stato istruito a cercare attivamente problemi, vulnerabilità e debolezze strutturali, fornendo suggerimenti su come riorganizzare o migliorare il codice. Non si tratta di un approccio sofisticato dal punto di vista teorico, ma di una scelta intenzionale: chiedere all’IA di essere estremamente esigente, quasi pignola, nel valutare il lavoro che lei stessa ha prodotto.

Il risultato è che il ruolo dell’ingegnere si sposta dalla produzione alla supervisione. Oggi, il compito principale non è più scrivere codice, ma valutarne la qualità, verificare che rispetti i principi architetturali e assicurarsi che sia sicuro e manutenibile. Questo ribaltamento ha implicazioni dirette anche su un tema tradizionalmente critico nello sviluppo software, quello del debito tecnico. Alla preoccupazione che l’uso massiccio dell’IA possa generare grandi quantità di codice disordinato, Krieger risponde con una visione opposta: nell’era dell’intelligenza artificiale il debito tecnico può accumularsi rapidamente, ma anche i mezzi per ridurlo e correggerlo sono cambiati radicalmente.

Krieger ha raccontato un episodio legato allo sviluppo di un prototipo per iPhone, in cui il team si è accorto che l’architettura iniziale non era adeguata. Invece di procedere con aggiustamenti incrementali, hanno chiesto a Claude di fare un passo indietro, definire prima un processo di verifica robusto e poi riscrivere l’intera architettura in modo più pulito. Questo approccio, che in passato sarebbe stato estremamente costoso in termini di tempo e risorse, si è rivelato sorprendentemente efficace grazie alla capacità dell’IA di riscrivere grandi porzioni di codice mantenendo la coerenza complessiva.

Da qui emerge una visione più ampia sul futuro dello sviluppo software. Secondo Krieger, il software non può più essere considerato uno strumento puramente deterministico, ma un sistema vivente che incorpora un “motore” non deterministico, potente e a volte imprevedibile. Questo cambia anche il ruolo di figure come i product manager, che non dovrebbero più limitarsi a redigere specifiche per gli ingegneri, ma sperimentare direttamente con i sistemi, testare modelli imperfetti e contribuire attivamente all’evoluzione del prodotto.

Un esempio concreto citato riguarda lo sviluppo della funzionalità “Uso del computer”, per la quale il team ha iniziato a testare modelli reali mesi prima del completamento ufficiale. Invece di attendere che la documentazione fosse definitiva, hanno scelto di confrontarsi subito con i limiti e gli errori dei modelli, utilizzando queste esperienze per guidare le iterazioni successive. Questo modo di lavorare, più esplorativo e meno lineare, riflette bene la natura sperimentale dei sistemi basati su intelligenza artificiale.

Con l’aumento della capacità dell’IA di scrivere codice, sono però emerse nuove criticità operative. In passato, un ingegnere poteva effettuare una o due modifiche al giorno, rendendo un’interruzione del sistema relativamente tollerabile. Oggi, con ogni ingegnere che gestisce decine di richieste di pull, anche un breve downtime può avere un impatto amplificato e risultare estremamente frustrante. Di conseguenza, strumenti di sviluppo e infrastruttura, un tempo considerati elementi secondari, diventano fattori determinanti per la produttività complessiva del team. Piccoli attriti o ritardi, sommati all’elevato volume di lavoro generato dall’IA, possono moltiplicare gli effetti negativi sull’intera organizzazione.

In questo contesto, la sfida più complessa non è tanto far scrivere codice a Claude, quanto definire una visione condivisa del prodotto, stabilire standard architetturali chiari e creare principi di riferimento che l’intelligenza artificiale possa seguire durante la revisione. Secondo Krieger, raggiungere un consenso su questi aspetti è molto più impegnativo del semplice atto di generare codice, perché richiede allineamento umano, capacità di sintesi e una direzione strategica coerente.

Guardando al futuro, Krieger invita le aziende a concedere agli agenti di intelligenza artificiale un alto grado di autonomia, progettandoli però all’interno di ambienti sandbox sicuri e con permessi ben definiti. Piuttosto che limitarsi a piccoli esperimenti isolati, suggerisce di puntare su obiettivi ambiziosi e critici per il business, sperimentando e migliorando continuamente. A suo avviso, una delle prossime applicazioni decisive dell’AI sarà la capacità di valorizzare flussi di dati spesso sottoutilizzati, come quelli legati alla sicurezza informatica, alle finanze o ai segnali di produzione, trasformandoli in informazioni strategiche.

Parallelamente, Anthropic sta rafforzando la propria struttura interna dedicata alla sperimentazione. Dallo scorso mese, Krieger guida anche il team Labs, un’unità di incubazione focalizzata su prodotti che si discostano dalla roadmap tradizionale. Questa organizzazione è cresciuta rapidamente con lo sviluppo di Claude Cowork e l’azienda prevede di raddoppiarne le dimensioni entro sei mesi. È un segnale chiaro di come Anthropic non stia semplicemente adottando l’intelligenza artificiale come strumento, ma stia ridefinendo in modo sistemico il processo stesso di creazione del software.