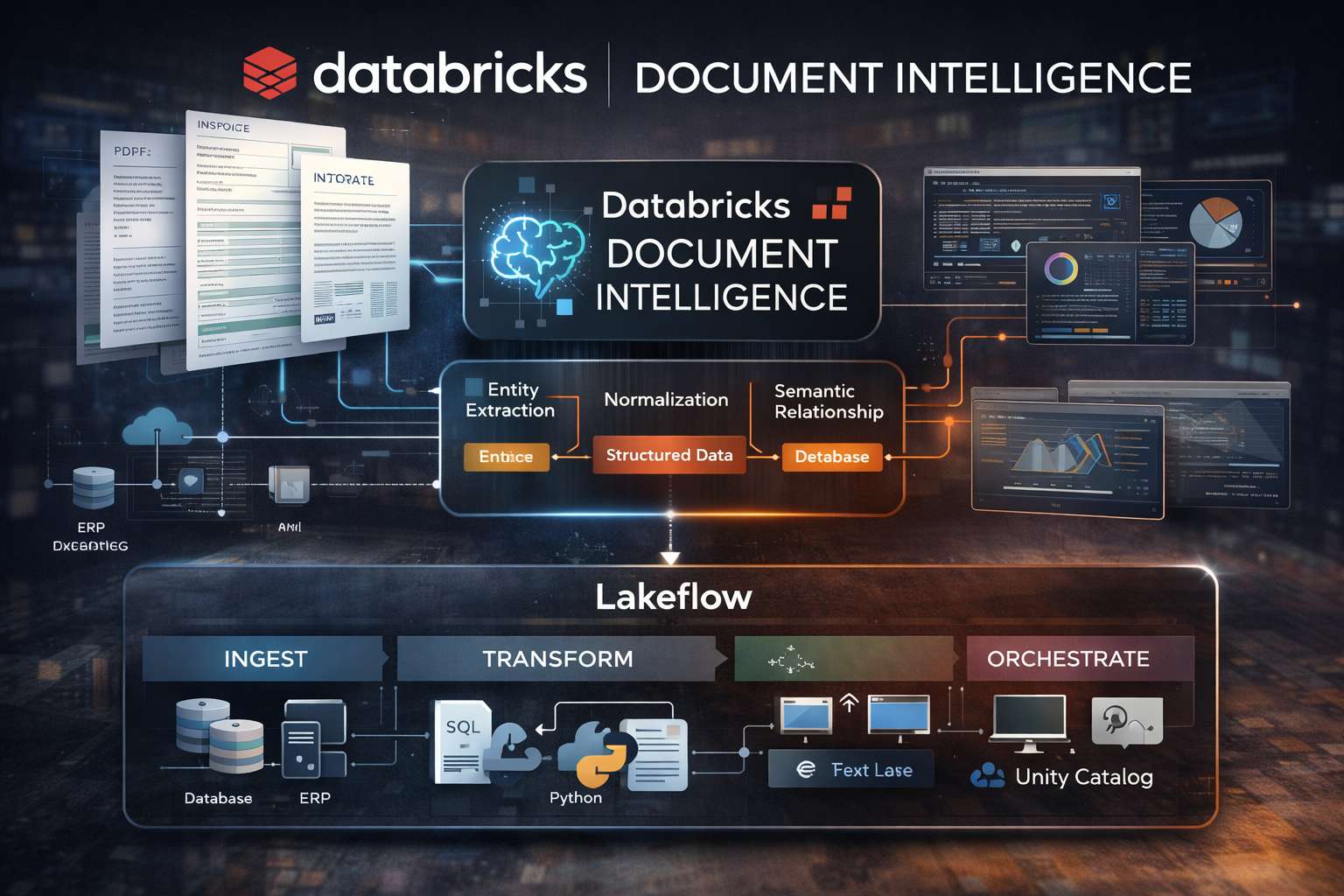

Il concetto di Document Intelligence di Datbricks si riferisce alla capacità dei sistemi di intelligenza artificiale di leggere, interpretare e strutturare automaticamente contenuti presenti in documenti complessi, come PDF, contratti, fatture o report. In termini tecnici, questo implica l’integrazione di tecniche di elaborazione del linguaggio naturale, computer vision e modelli di deep learning, in grado di analizzare layout, estrarre entità e ricostruire relazioni semantiche. Questo tipo di tecnologia consente di trasformare contenuti tradizionalmente non strutturati in dati utilizzabili per analisi e automazione.

Nel contesto descritto, la novità principale non risiede tanto nella capacità di analisi documentale, quanto nella sua integrazione diretta con le pipeline di dati aziendali. Grazie a Databricks Document Intelligence, le operazioni di estrazione, normalizzazione e arricchimento dei documenti possono essere eseguite “accanto” ai flussi di dati esistenti, senza la necessità di strumenti separati. Questo significa che il documento non è più un elemento isolato, ma una sorgente dati pienamente integrata nel sistema informativo.

Un ruolo centrale in questa architettura è svolto da Lakeflow, descritto come una soluzione unificata per l’ingegneria dei dati. Lakeflow consente di gestire in modo integrato tutte le fasi del ciclo di vita dei dati, dall’ingestione alla trasformazione fino all’orchestrazione dei flussi di lavoro. Questo approccio riduce la complessità tipica dei sistemi ETL tradizionali, che spesso richiedono l’integrazione di strumenti eterogenei.

Lakeflow si articola in diversi componenti funzionali. Il modulo di ingestione consente di acquisire dati da fonti eterogenee, tra cui database, applicazioni aziendali e file documentali. Il livello di trasformazione permette di applicare logiche di pulizia, arricchimento e normalizzazione utilizzando linguaggi standard come SQL e Python. Infine, il sistema di orchestrazione gestisce l’esecuzione dei workflow, garantendo scalabilità, monitoraggio e integrazione con ambienti di produzione.

L’integrazione tra Document Intelligence e Lakeflow consente di costruire pipeline in cui i documenti vengono trattati come flussi di dati dinamici. Ad esempio, un documento caricato nel sistema può essere automaticamente analizzato, trasformato in una struttura dati e inserito in un flusso di elaborazione che lo collega ad altre fonti informative. Questo approccio elimina la separazione tra dati strutturati e non strutturati, creando un modello unificato di gestione.

Un elemento tecnico rilevante riguarda la governance dei dati. L’intero sistema è integrato con Unity Catalog, il framework di governance della piattaforma, che consente di applicare controlli di accesso, tracciabilità e auditing su tutti i dati, inclusi quelli derivati dai documenti. Questo è particolarmente importante in contesti aziendali regolamentati, dove la gestione dei dati deve rispettare requisiti di sicurezza e conformità.

L’integrazione consente di automatizzare processi complessi che in precedenza richiedevano interventi manuali. Attività come l’estrazione di informazioni da fatture, la classificazione di documenti o la verifica di contenuti possono essere eseguite automaticamente all’interno delle pipeline. Questo riduce i tempi di elaborazione e aumenta la coerenza dei risultati, migliorando l’efficienza complessiva del sistema.

Un ulteriore aspetto riguarda la scalabilità. Le soluzioni descritte sono progettate per operare su grandi volumi di dati, sfruttando infrastrutture cloud e modelli di calcolo distribuito. Questo consente di gestire contemporaneamente migliaia di documenti e flussi di dati, mantenendo prestazioni elevate anche in scenari complessi.