Il contesto di partenza è quello di una progressiva insufficienza di medici di medicina generale, particolarmente evidente in alcune aree degli Stati Uniti. Questa carenza genera un sovraccarico operativo sul sistema sanitario, con conseguenze dirette sui tempi di accesso alle cure, sulla continuità assistenziale e sulla qualità della presa in carico. In questo scenario si inserisce la sperimentazione avviata nello Utah, dove è stata sviluppata una soluzione tecnologica basata su intelligenza artificiale capace di effettuare una valutazione clinica e generare prescrizioni farmacologiche senza l’intervento diretto del medico.

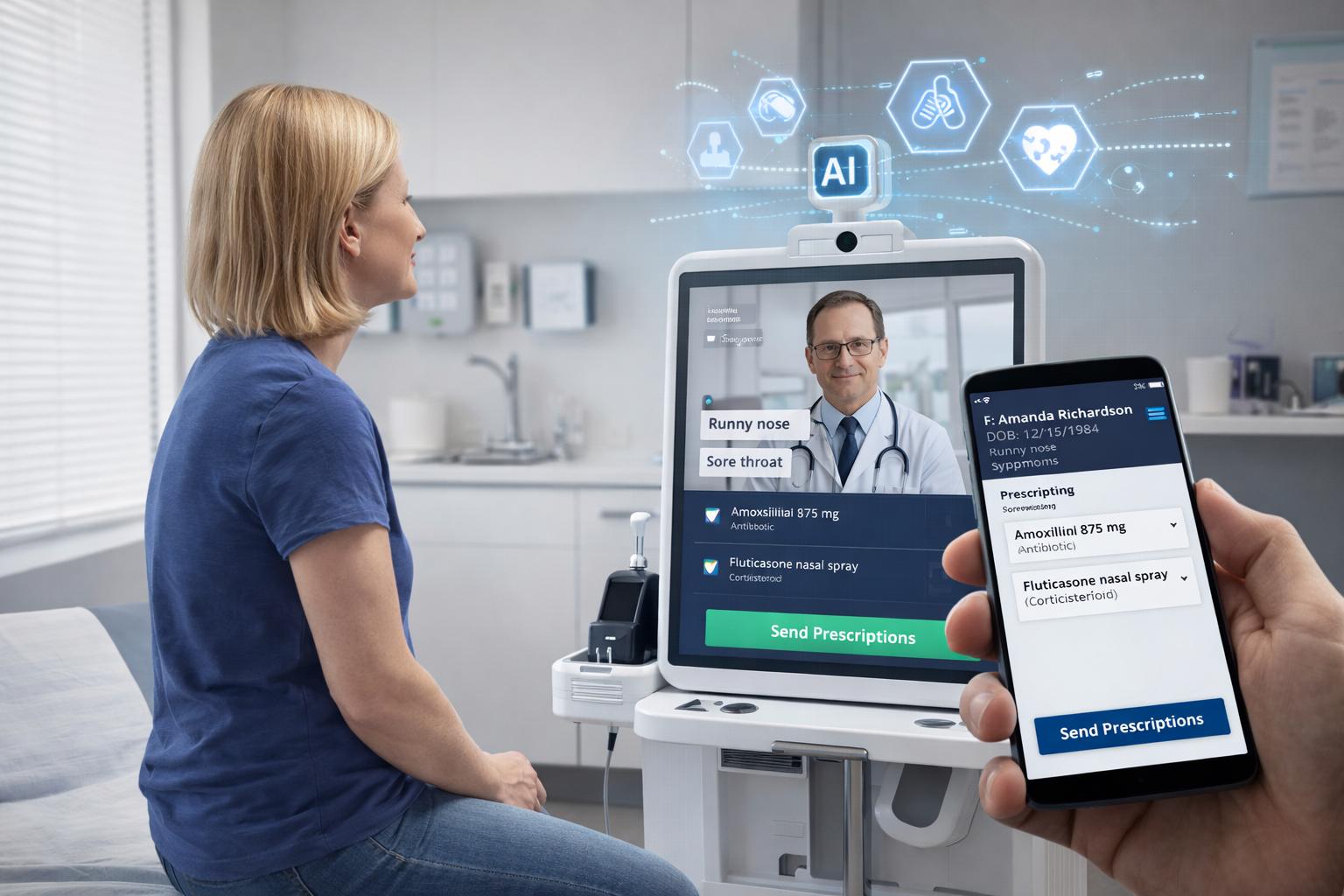

Dal punto di vista tecnico, il sistema si configura come una piattaforma algoritmica avanzata progettata per replicare il processo decisionale clinico. Il software è in grado di raccogliere informazioni dal paziente, elaborarle attraverso modelli predittivi e selezionare il trattamento farmacologico più appropriato all’interno di un catalogo di circa 200 farmaci, tra cui statine, corticosteroidi, antidepressivi, ormoni e anticoagulanti. Questo implica l’integrazione di moduli di raccolta dati, sistemi di triage digitale e modelli di machine learning addestrati su grandi quantità di dati clinici.

La logica operativa di questi sistemi rientra nel più ampio paradigma dell’intelligenza artificiale applicata alla sanità, che si basa sulla capacità degli algoritmi di analizzare correlazioni tra dati clinici e outcome dei pazienti, producendo raccomandazioni terapeutiche o diagnostiche. A differenza dei sistemi tradizionali di supporto decisionale, l’IA non si limita a fornire suggerimenti, ma può arrivare a generare output direttamente operativi, come nel caso della prescrizione farmacologica.

Tuttavia, il passaggio da strumento di supporto a sostituto decisionale rappresenta un salto qualitativo rilevante. La sperimentazione statunitense evidenzia come l’intelligenza artificiale possa essere utilizzata non solo per affiancare il medico, ma per sostituirne alcune funzioni chiave, in particolare nei contesti a bassa complessità clinica o ad alto volume di richieste. Questo approccio risponde a esigenze di efficienza e scalabilità, ma introduce nuove criticità legate all’affidabilità del sistema, alla gestione del rischio clinico e alla responsabilità legale.

Uno dei nodi principali riguarda infatti la trasparenza algoritmica. I sistemi di intelligenza artificiale, soprattutto quelli basati su modelli complessi, possono funzionare come “scatole nere”, producendo risultati senza rendere esplicito il percorso logico che ha portato alla decisione. Questo aspetto è particolarmente critico in ambito sanitario, dove la tracciabilità del processo decisionale è fondamentale sia per la sicurezza del paziente sia per la validazione scientifica delle scelte terapeutiche.

Accanto agli aspetti tecnici emergono questioni di natura clinica ed etica. Come evidenziato nell’articolo, una parte della comunità medica sottolinea che la medicina non può essere ridotta a un processo algoritmico, in quanto implica una relazione diretta con il paziente, l’osservazione clinica e la capacità di interpretare segnali non codificabili. La visita medica non è soltanto raccolta di dati, ma anche interazione, comunicazione e adattamento continuo al contesto individuale del paziente.

Inoltre, l’adozione di sistemi di prescrizione automatizzata solleva interrogativi sulla gestione degli effetti collaterali, sulle interazioni farmacologiche e sulla personalizzazione della terapia in presenza di condizioni complesse o multiple. La capacità dell’IA di integrare variabili cliniche eterogenee è elevata, ma non necessariamente equivalente alla valutazione clinica umana, soprattutto nei casi che richiedono giudizio esperto e contestualizzazione.

Il confronto con il modello europeo evidenzia un approccio più prudente. In Europa, e in particolare in Italia, l’intelligenza artificiale viene orientata verso il supporto alla decisione e la medicina di precisione, piuttosto che verso la sostituzione diretta del medico. Le strategie regolatorie puntano sull’integrazione tra dati clinici, genomici e strumenti digitali, mantenendo il controllo decisionale in capo al professionista sanitario.

In prospettiva, l’esperienza statunitense rappresenta un caso di studio significativo per comprendere l’evoluzione dei sistemi sanitari in presenza di vincoli strutturali come la carenza di personale. L’intelligenza artificiale emerge come soluzione potenziale per aumentare la capacità operativa del sistema, ma al tempo stesso evidenzia la necessità di definire nuovi modelli di governance, standard di sicurezza e criteri di responsabilità.

Il punto centrale non è quindi stabilire se l’intelligenza artificiale possa sostituire il medico, ma in quali condizioni, con quali limiti e con quale livello di supervisione. La tecnologia dimostra di poter replicare alcune funzioni decisionali, ma la complessità della pratica medica richiede un’integrazione equilibrata tra capacità algoritmica e competenza umana, evitando una riduzione eccessiva della medicina a un processo puramente computazionale.