L’intelligenza artificiale sta vivendo una crescita esponenziale, ma questa espansione porta con sé un problema sempre più evidente: il consumo energetico. I data center che alimentano i modelli AI stanno diventando tra i principali consumatori di elettricità a livello globale, con una domanda destinata quasi a raddoppiare entro il 2030. In questo contesto si inserisce la proposta di EnterpriseDB, che introduce un nuovo paradigma chiamato “intelligence per watt”, con l’obiettivo di ripensare l’efficienza dell’intelligenza artificiale partendo da un livello spesso trascurato: il dato.

Il concetto di “intelligence per watt” nasce dall’esigenza di disaccoppiare la crescita delle capacità dell’AI dall’aumento proporzionale dei consumi energetici. Tradizionalmente, migliorare le prestazioni dei modelli ha significato utilizzare più potenza di calcolo, più GPU e infrastrutture sempre più energivore. EnterpriseDB propone invece un cambio di prospettiva: non è necessario intervenire solo sull’hardware o sui modelli, ma è possibile ottenere miglioramenti significativi ottimizzando il modo in cui i dati vengono gestiti, recuperati e processati.

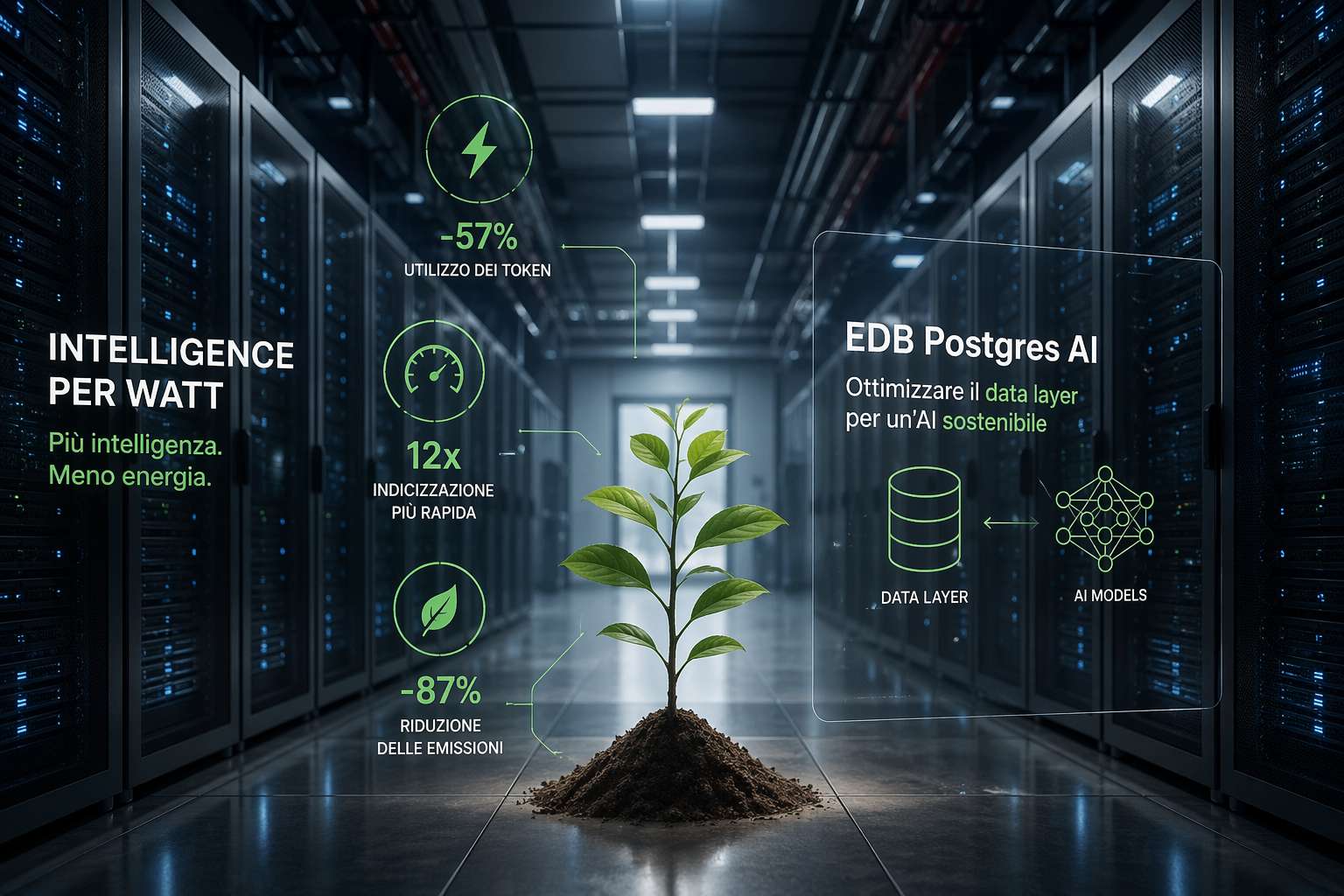

Alla base di questa visione c’è la piattaforma EDB Postgres AI, che introduce una serie di ottimizzazioni nel cosiddetto “data layer”, ovvero lo strato che collega i modelli AI alle informazioni su cui operano. Secondo i benchmark dichiarati dall’azienda, questo approccio consente di ridurre il numero di token necessari per ogni operazione, velocizzare l’indicizzazione vettoriale e diminuire in modo sensibile il carico computazionale complessivo. In termini concreti, si parla di un utilizzo dei token fino al 57% inferiore e prestazioni di indicizzazione fino a 12 volte più rapide.

Il punto più rilevante, però, riguarda l’impatto energetico. Riducendo la quantità di dati elaborati e ottimizzando le query, si abbassa direttamente il consumo elettrico dei data center, con una conseguente diminuzione delle emissioni. EnterpriseDB sostiene che, in alcuni casi, sia possibile arrivare fino all’87% di riduzione delle emissioni legate ai carichi AI. Questo dato assume particolare rilevanza se si considera che anche una singola richiesta AI può consumare da frazioni di wattora fino a diversi wattora, a seconda della complessità e del modello utilizzato.

L’idea di misurare l’efficienza dell’intelligenza artificiale in termini di “intelligenza per watt” si inserisce in un filone più ampio di metriche che cercano di bilanciare prestazioni e sostenibilità. In ambito accademico, concetti simili mettono in relazione l’accuratezza dei modelli con l’energia consumata, evidenziando come sistemi più piccoli o meglio ottimizzati possano offrire risultati comparabili con un impatto ambientale molto inferiore. Tuttavia, la proposta di EnterpriseDB si distingue perché porta questa logica direttamente nel mondo enterprise, trasformandola in un criterio operativo per progettare infrastrutture AI più efficienti.