Microsoft, IBM, NVIDIA e altre società tecnologiche collaborano per lanciare la matrice delle minacce di Adversarial ML

Con un massiccio avvento dell’apprendimento automatico in aree critiche come sanità, BFSI, difesa, ecc., Sta avendo un impatto significativo sulle vite umane. Sebbene vi sia un crescente interesse da parte delle aziende a includere il machine learning, c’è sempre stata una grande preoccupazione per la sicurezza dei loro sistemi ML. Per risolvere un problema del genere, 12 aziende tecnologiche tra cui Microsoft, NVIDIA, Bosch, IBM ecc. Hanno collaborato con un’organizzazione no-profit americana – MITRE – per creare una matrice di minacce ML di Adversarial .

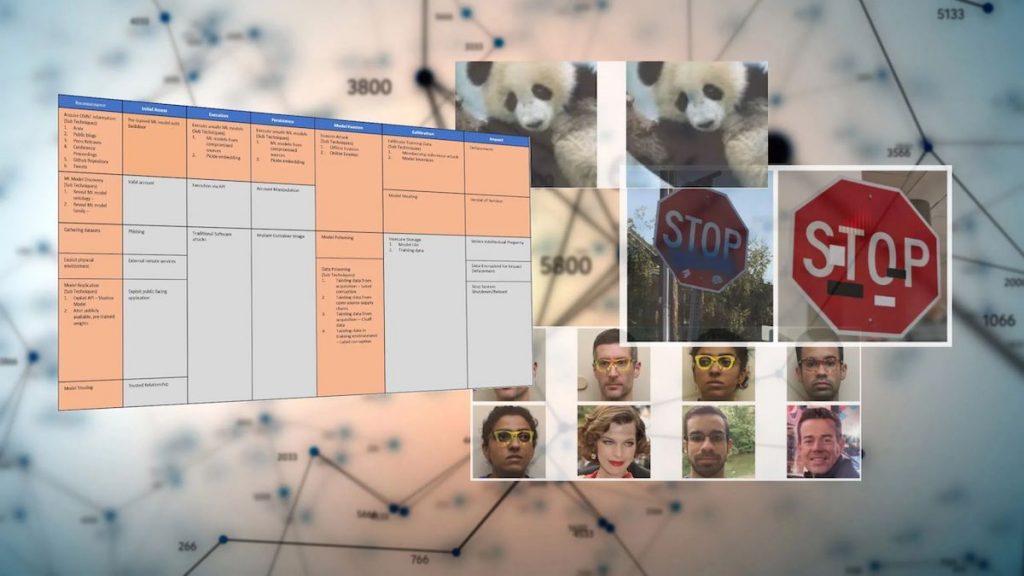

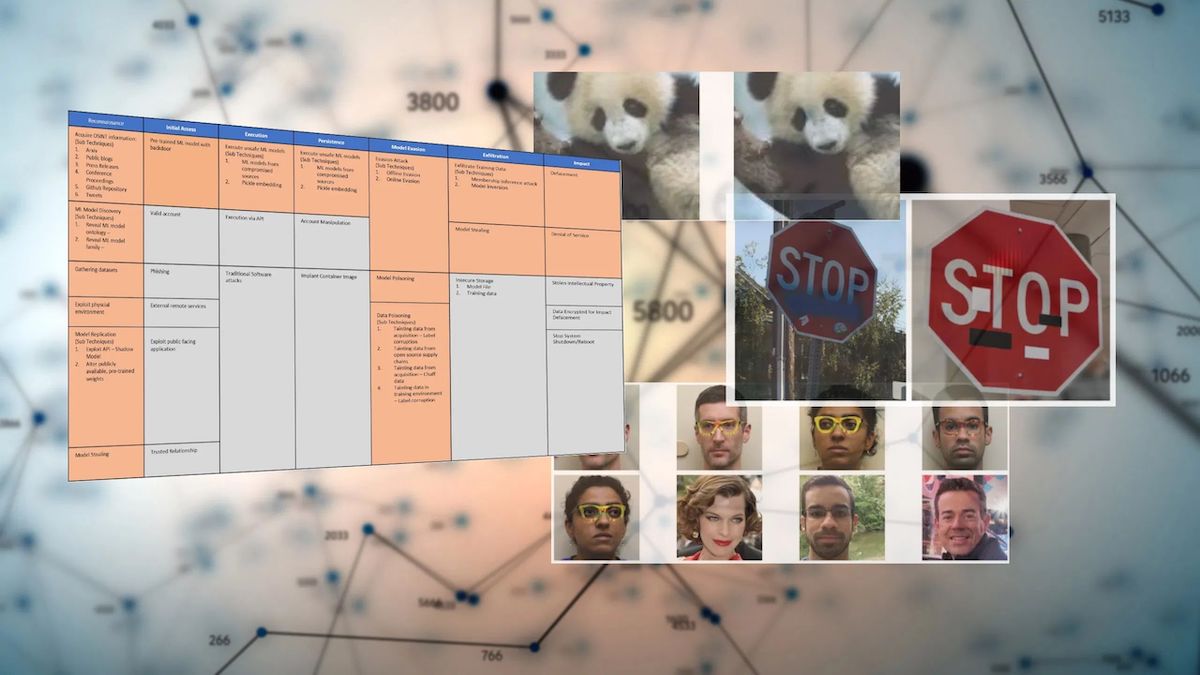

Questa matrice di minacce di apprendimento automatico antagonistico è un framework aperto focalizzato sul settore che è stato progettato per consentire agli analisti della sicurezza di rilevare, rispondere e porre rimedio alle minacce contro i sistemi ML.

Secondo Microsoft , la matrice delle minacce è stata progettata per rispondere al crescente numero di attacchi in tutto il mondo. È un dato di fatto, la società ha intervistato 28 aziende che hanno notato che “la maggior parte degli operatori del settore deve ancora venire a patti con il machine learning antagonista”. Oltre a ciò, su queste 28 aziende, 25 di loro hanno riferito di non disporre degli strumenti giusti per proteggere i propri sistemi di apprendimento automatico e sono alla ricerca di una guida.

Microsoft ha inoltre aggiunto: “… la preparazione non è limitata solo alle organizzazioni più piccole”. L’azienda ha anche parlato con aziende Fortune 500, governi, organizzazioni non profit e organizzazioni di piccole e medie dimensioni.

Che cos’è la matrice delle minacce ML antagonista

Questa matrice di minacce è stata sviluppata in collaborazione con MITRE, poiché la società ritiene che il primo passo sia “disporre di un framework che organizzi sistematicamente le tecniche impiegate da avversari maligni nel sovvertire i sistemi ML”.

“Ci auguriamo che la comunità della sicurezza possa utilizzare le tattiche e le tecniche tabulate per rafforzare le proprie strategie di monitoraggio attorno ai sistemi ML mission-critical della propria organizzazione”, ha affermato nel post del blog .

Lo strumento è stato creato appositamente per gli analisti della sicurezza. L’Adversarial ML Threat Matrix inserirà gli attacchi ai sistemi ML in una struttura in cui gli analisti della sicurezza possono affrontare le minacce nuove e imminenti. In effetti, la matrice delle minacce è strutturata come il framework ATT & CK, che sarebbe facile per gli analisti della sicurezza affrontare le minacce del sistema ML.

Inoltre, l’azienda ha seminato questo framework con una serie curata di vulnerabilità e comportamenti avversi che Microsoft e MITRE hanno valutato per essere efficaci contro i sistemi ML di produzione. In questo modo, gli analisti della sicurezza possono concentrarsi sulle minacce reali ai sistemi ML. “Abbiamo anche incorporato nel framework gli insegnamenti tratti dalla vasta esperienza di Microsoft in questo spazio: ad esempio, abbiamo scoperto che il furto di modelli non è l’obiettivo finale dell’attaccante, ma in realtà porta a un’evasione più insidiosa del modello”, afferma il post del blog.

Avvolgendo

Considerando che l’apprendimento automatico dell’avversario è stato un’area critica di ricerca nel mondo accademico, questa matrice delle minacce – Adversarial ML Threat Matrix – è stato il primo tentativo di raccogliere tecniche avversarie contro i sistemi di apprendimento automatico. Con l’evolversi del panorama delle minacce, questo framework verrà avanzato con il contributo della comunità di sicurezza e apprendimento automatico.