Puoi dire la differenza tra un vero volto e un falso generato dall’IA?

WhichFaceIsReal.com è progettato per educare il pubblico sui falsi AI

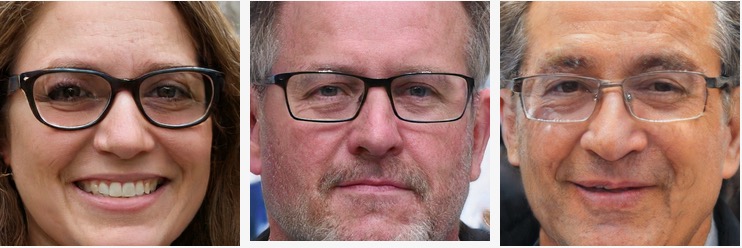

Un paio di facce, una finta, una reale, servita dal sito web.

All’inizio di questo mese potresti aver visto un sito Web chiamato ThisPersonDoesNotExist.com fare il giro, che utilizza l’intelligenza artificiale per generare facce finte sorprendentemente realistiche. Bene, ecco il seguito: WhichFaceIsReal.com , che ti permette di verificare la tua capacità di distinguere i falsi generati dall’IA dall’articolo originale. Vai al sito e fai clic su chi pensi sia la persona reale!

WhichFaceIsReal.com ha anche uno scopo più alto però. È stato creato da due accademici dell’Università di Washington, Jevin West e Carl Bergstrom, entrambi studiano come le informazioni si diffondono attraverso la società. Pensano che l’aumento dei falsi generati dall’intelligenza artificiale potrebbe essere un problema, minando la fiducia della società nelle prove e desiderando educare le masse.

“Quando arriva una nuova tecnologia come questa, il periodo più pericoloso è quando la tecnologia è là fuori, ma il pubblico non ne è a conoscenza”, dice Bergstrom a The Verge . “In quel momento può essere usato in modo più efficace.”

“Quindi quello che stiamo cercando di fare è educare il pubblico, rendere le persone consapevoli del fatto che questa tecnologia è là fuori”, dice West. “Proprio come alla fine la maggior parte delle persone è stata resa consapevole che è possibile Photoshop un’immagine”.

Visi falsi generati da ThisPersonDoesNotExist.com.

Entrambi i siti utilizzano un metodo di apprendimento automatico noto come una rete generativa avversaria (o GAN in breve) per generare i loro falsi. Queste reti operano analizzando enormi pile di dati (in questo caso, molti ritratti di persone reali); imparando i modelli al loro interno e poi cercando di replicare ciò che hanno visto.

La ragione per cui i GAN sono così buoni è che si mettono alla prova. Una parte della rete genera volti e l’altro li confronta con i dati di allenamento. Se può dire la differenza, il generatore viene rimandato al tavolo da disegno per migliorare il suo lavoro. Pensalo come un insegnante d’arte rigoroso che non ti lascerà lasciare la classe finché non disegnerai il giusto numero di occhi sul tuo ritratto a carboncino. Non c’è spazio per AI Picasso – solo realismo.

“IL PERIODO PIÙ PERICOLOSO È QUANDO LA TECNOLOGIA È LÀ FUORI MA IL PUBBLICO NON NE È A CONOSCENZA”.

Queste tecniche possono essere utilizzate per manipolare audio e video e immagini. Sebbene ci siano limitazioni a ciò che tali sistemi possono fare (non è possibile digitare una didascalia per un’immagine che si desidera esistere e averla resa magica) stanno migliorando costantemente. Deepfakes può trasformare i video dei politici in marionette e possono persino trasformarti in un grande ballerino .

Con questo caso di volti generati dall’intelligenza artificiale, Bergstrom e West osservano che un uso malevolo potrebbe diffondere disinformazione dopo un attacco terroristico. Ad esempio, l’intelligenza artificiale potrebbe essere utilizzata per generare un colpevole falso diffuso online, diffuso sui social network.

In questi scenari, i giornalisti di solito cercano di verificare la fonte di un’immagine, utilizzando strumenti come la ricerca inversa di immagini di Google. Ma non funzionerebbe su un falso AI. “Se si voleva iniettare disinformazione in una situazione del genere, se si pubblica un’immagine del perpetratore e si tratta di qualcun altro, verrà corretto molto rapidamente”, afferma Bergstrom. “Ma se usi un’immagine di qualcuno che non esiste affatto? Pensa alla difficoltà di rintracciarlo. “

Notano che accademici e ricercatori stanno sviluppando numerosi strumenti in grado di individuare i deepfakes. “La mia comprensione è che in questo momento è in realtà abbastanza facile da fare”, osserva West. E facendo il test sopra, probabilmente hai scoperto che puoi differenziare i volti generati dall’IA e le persone reali. Ci sono un certo numero di tell , tra cui facce asimmetriche, denti disallineati, capelli irrealistici e orecchie che, beh, non sembrano orecchie.

Ma questi falsi miglioreranno. In altri tre anni [questi falsi] saranno indistinguibili “, afferma West. E quando ciò accadrà, conoscere sarà metà della battaglia. Bergstrom afferma: “Il nostro messaggio non è tanto che le persone non è tanto che le persone non dovrebbero credere in nulla. Il nostro messaggio è il contrario: non essere creduloni.