Teleoperazione GPA: teleoperazione aerea assistita sicura con maggiore percezione dello sguardo

I ricercatori cinesi hanno sviluppato un nuovo algoritmo che può consentire il controllo del volo dei droni interpretando direttamente la visione dell’utente. In effetti, l’operatore umano “diventa” il drone e guida la sua traiettoria in base alla direzione dello sguardo dell’utente.

Il documento si chiama GPA-Teleoperation: Gaze Enhanced Perception-aware Safe Assistive Aerial Teleoperation e proviene da ricercatori dell’Institute of Cyber-Systems and Control dell’Università di Zhejiang e della School of Automation del Nanjing Institute of Technology. I ricercatori hanno anche pubblicato oggi un video che dimostra le capacità del sistema. i ricercatori sono Qianhao Wang , Botao He , Zhiren Xun , Chao Xu , Fei Gao

Oltre il controllo astratto

I ricercatori stanno cercando di rimuovere lo strato di astrazione per il controllo dei droni, sostenendo che le unità di controllo secondarie richiedono addestramento e sono solo un’astrazione approssimativa dell’intento dell’utente, portando a manovre imprevedibili e interpretazioni errate dei movimenti di guida.

Un documento all’inizio dell’anno, degli stessi ricercatori, ha sottolineato l’importanza della visibilità in linea di vista nella navigazione dei droni, e il lavoro attuale è uno sviluppo dei risultati di quella ricerca .

Algoritmo

GPA utilizza un ottimizzatore di back-end che affina lo sguardo dell’utente nel percorso ottimale più sicuro, probabilmente equivalente all'”auto mira” nei videogiochi, a latenza praticamente zero (per ovvie ragioni).

I moduli del sottosistema UAV sono installati direttamente nel drone, comprese le strutture per la stima dello stato, la pianificazione, la mappatura e i moduli di controllo. Il sistema locale riceve i dati dello sguardo da un’unità a occhio singolo montata in un’imbracatura indossata dall’utente finale, che fornisce un percorso topologico iniziale, che il sistema deve interpretare al volo.

Per creare un’esperienza coerente per il telecomando, la vista monocromatica che l’utente riceve è autocentrata dal sistema drone di bordo, anche perché senza di essa sarebbe difficile interpretare nuove deviazioni di rotta previste (come indicato da un cambio di direzione dello sguardo).

Il sistema prima analizza le coordinate vettoriali stimate dal flusso di immagini. Poiché l’input video del sistema dei ricercatori è attualmente monoculare, il limite della profondità di percezione della telecamera viene utilizzato per ottenere un secondo vettore (profondità) che viene imposto al vettore 2-D derivato dall’immagine. In teoria, le iterazioni successive potrebbero utilizzare le telecamere stereo per migliorare questa pipeline, anche se resta da vedere se l’overhead aggiuntivo di elaborazione lascerebbe intatto il vantaggio della percezione 3D basata sull’hardware.

In ogni caso, con i valori 3D ottenuti, il calcolo viene utilizzato come origine per una Breadth First Search (BFS). I pixel che altrimenti sarebbero evitati da BFS (cioè i pixel identificati come già all’interno dei limiti) vengono utilizzati come punto di ancoraggio per il clustering DBSCAN (se non già raggruppato), e la routine torna alla valutazione BFS dall’ultimo punto di interruzione.

Il processo itera finché un oggetto non viene identificato ed etichettato all’interno di parametri di margine corrispondenti a un campo visivo (FOV – che, in questo caso, deve essere assolutamente chiaro per evitare collisioni).

Infine, i calcoli vettoriali vengono utilizzati per generare percorsi chiari, oppure per convalidare che la direzione dello sguardo dell’utente sia già un percorso sicuro attraverso o oltre un ostacolo.

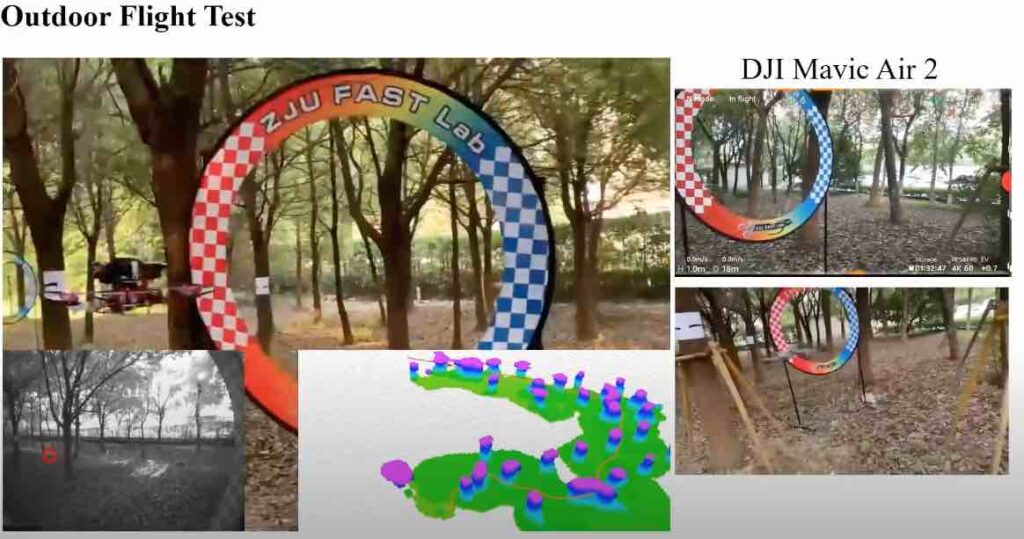

Per testare il sistema di controllo dei droni basato sullo sguardo, i ricercatori cinesi hanno utilizzato una serie di volontari con zero conoscenza del sistema e senza esperienza nel controllo del volo dei droni. I soggetti dovevano percorrere percorsi ad ostacoli in ambienti chiusi ed esterni con solo tre brevi routine di orientamento con cui familiarizzare con il funzionamento di base del sistema.

Inoltre, dopo aver informato i volontari sulla topologia di base degli ostacoli, i ricercatori hanno aggiunto “ostacoli a sorpresa” non inclusi nel briefing.

Sopra, le traiettorie del drone quadrirotore online, colorate per altezza. Sotto, gli ostacoli percorribili, a cominciare dalle scatole per passare agli anelli.

In pratica, il sistema è stato in grado di correggere efficacemente i dati dello sguardo in modo che i droni utilizzati per lo spazio siano in grado di attraversare (o attraversare) l’anello e gli ostacoli a forma di scatola senza collisioni, e i ricercatori hanno concluso che il loro sistema è sia intuitivo e sicuro, con un alto margine di sicurezza in esercizio.

I ricercatori hanno anche confrontato le prestazioni del loro approccio all’architettura FocusTrack nel sistema Mavic Air 2 , concludendo che supera quest’ultimo essendo in grado di valutare e agire su precise intenzioni dell’utente.

La tecnologia di tracciamento oculare è stata ampiamente studiata in campi come la raccolta di dati sui veicoli autonomi per sistemi SDV basati sull’apprendimento automatico e nella ricerca sui modelli di attenzione dei piloti, tra gli altri settori. Nel luglio di quest’anno, un team di ricerca dalla Bulgaria ha pubblicato i risultati delle osservazioni dei piloti di Unmanned Aerial Vehicle (UAV) che hanno stabilito che la fase di atterraggio di un volo è la più impegnativa per i principianti.