Secondo le stime fornite dall’organizzazione di ricerca Epoch AI, Google ha raggiunto una capacità operativa senza precedenti, superando giganti come Microsoft grazie a una visione strategica lungimirante focalizzata sull’indipendenza hardware. Il dato più significativo di questa ascesa non risiede nel numero assoluto di GPU acquistate da fornitori esterni, ma nella crescita esponenziale delle TPU (Tensor Processing Unit), i chip proprietari sviluppati internamente che oggi rappresentano il vero motore della potenza di calcolo di Mountain View.

Per uniformare il confronto tra le diverse architetture hardware dei vari hyperscaler, è stata adottata l’unità di misura H100e (H100 Equivalent), che converte le prestazioni di chip eterogenei nelle capacità di una singola GPU NVIDIA H100. In base a questo parametro, Google dispone di una potenza totale di circa 5,2 milioni di H100e, una cifra che le permette di controllare circa un quarto della capacità di calcolo cumulativa mondiale per l’IA. Analizzando la composizione di questa infrastruttura, emerge chiaramente il peso dei chip proprietari: le TPU contribuiscono per circa 3,9 milioni di H100e, surclassando di tre volte la componente basata su chip NVIDIA, che si attesta a 1,3 milioni. Questa diversificazione pone Google in una posizione di netto vantaggio rispetto a Microsoft, che pur vantando 3,6 milioni di H100e, rimane fortemente dipendente da NVIDIA, la quale fornisce oltre 3,2 milioni delle sue unità.

La superiorità tecnica rivendicata da Google non riguarda solo la quantità di silicio, ma l’integrazione profonda di quello che il CEO di Google Cloud, Thomas Kurian, definisce un approccio “full-stack”. Possedere l’intera catena del valore — dai laboratori di ricerca interni come DeepMind, che collaborano allo sviluppo delle TPU da oltre dodici anni, fino ai data center e ai modelli linguistici — consente a Google di ottimizzare i costi operativi in modo drastico. Non dovendo destinare una quota massiccia del fatturato all’acquisto di chip da terze parti, l’azienda può reinvestire le risorse per accelerare ulteriormente l’innovazione. Questa efficienza economica si riflette nei risultati finanziari: con un fatturato previsto per il 2025 superiore ai 70 miliardi di dollari, Google sta crescendo a ritmi più sostenuti rispetto ai suoi diretti concorrenti nel settore cloud.

L’efficacia della TPU come alternativa alle GPU tradizionali è confermata dall’adozione di massa nel settore: nove delle dieci principali aziende di intelligenza artificiale al mondo utilizzano attualmente queste unità proprietarie. Resta esclusa OpenAI, vincolata da accordi di esclusiva con l’infrastruttura di Microsoft, una limitazione che tuttavia evidenzia il carattere distintivo dell’offerta Google. La capacità di Google di gestire autonomamente la qualità dei propri sistemi, integrando hardware e software in un ecosistema chiuso ma estremamente performante, trova un parallelo competitivo solo nella stessa NVIDIA, che tuttavia opera principalmente come fornitore per terzi piuttosto che come gestore di un servizio cloud integrato di tale portata.

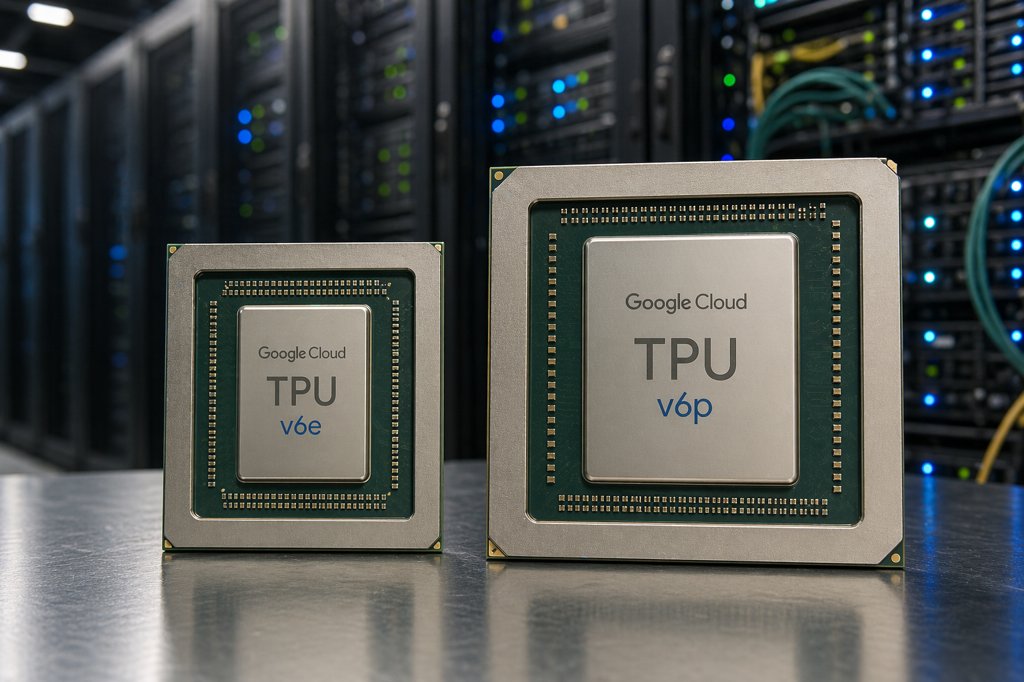

Infine, l’evoluzione hardware continua a spingere i confini delle prestazioni con la presentazione della settima e ottava generazione di chip proprietari. Il lancio delle TPU 8t, ottimizzate per l’addestramento di modelli complessi, e delle TPU 8i, potenziate nella memoria per gestire carichi di inferenza massivi, consolida ulteriormente la barriera tecnologica eretta da Google. Mentre altre aziende del settore IA affrontano le sfide legate alla redditività e alla dipendenza da capitali esterni o IPO, l’indipendenza infrastrutturale di Google appare come il fattore decisivo per la sopravvivenza e il dominio nel mercato globale, trasformando la potenza di calcolo da una spesa variabile e incerta in una risorsa strategica controllata e scalabile.