Distribuisci i modelli ML più velocemente con Google Cloud

Google Cloud ha sempre avuto l'”apertura” al centro della sua filosofia di design.

Passare dalla fase del prototipo alla produzione in intelligenza artificiale e apprendimento automatico è uno dei compiti più impegnativi. La ricerca mostra che oltre l’87% dei progetti di scienza dei dati non arriva mai alla produzione per motivi quali l’utilizzo di vari framework, linguaggi ed ecosistemi, oltre alla carenza di elaborazione specializzata per la formazione su larga scala e carichi di lavoro variabili sul servizio di machine learning, e alla necessità di una maggiore intelligenza gestione infra.

In questo contesto, Google, che crede fermamente che il framework/piattaforma MLOps sia fondamentale per garantire un time-to-market più rapido e ripetibile per i modelli ML, ha annunciato la sua piattaforma ML di punta (Vertex AI). Soddisfa tutte le esigenze della scienza dei dati, dalla sperimentazione (con Managed Notebooks) e formazione (utilizzando framework di pipeline ML scalabili) alla distribuzione (GKE autoscaling ++) e alla gestione e monitoraggio dei modelli in modo sistematico, scalabile e unificato.

Concorrenza a bizzeffe

Si prevede che il mercato globale del machine learning-as-a-service (MLaaS) raggiungerà i 302,66 miliardi di dollari entro il 2030 , crescendo a un CAGR del 36,2% dal 2021 al 2030. La crescita è innescata dalla maggiore domanda di soluzioni basate su cloud , cloud computing, crescita del mercato dell’IA e del cognitive computing, aumento dell’adozione di soluzioni analitiche, maggiori aree di applicazione e altro.

All’avanguardia, Google Cloud aiuta i clienti a comprendere meglio la catena di approvvigionamento e i prodotti grazie ai dati. Inoltre, aiutano anche a eseguire le applicazioni (sia esistenti che nuove, utilizzando un’architettura aperta) e riuniscono le persone per migliorare la produttività e la creatività, assicurando che i sistemi, gli utenti e i dati siano protetti.

Google Cloud crede nella democratizzazione del ML in tutta l’organizzazione. In questo sforzo, fornisce le sue capacità ML in tre modi distinti:

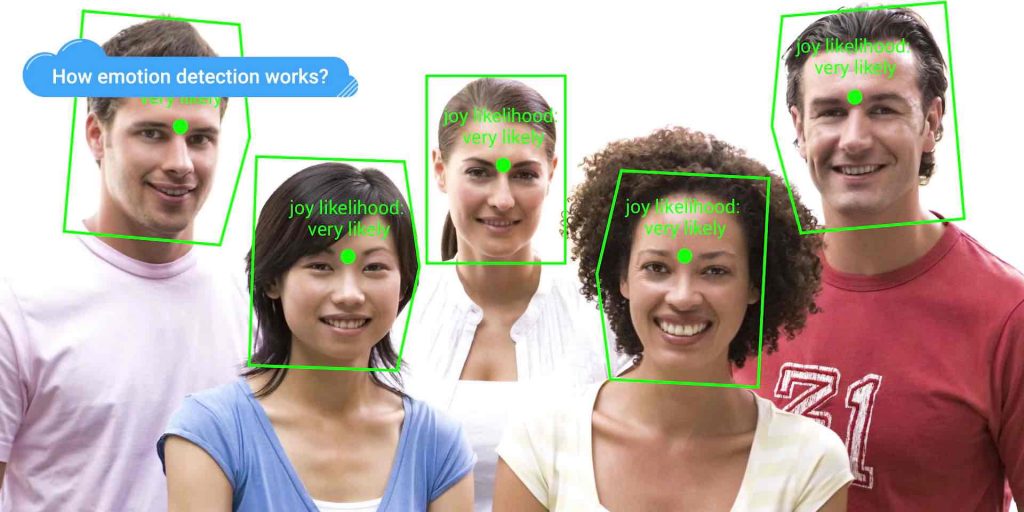

API: Google Cloud fornisce API alle aziende, dove possono incorporare i modelli direttamente nelle loro applicazioni. Ad esempio, includi Video AI, Google Cloud Vision API, Speech-to-text API, Cloud Document AI API, ecc.

AutoML: aiuta le aziende a creare modelli personalizzati per i propri dati. Grazie alle funzionalità di ML a codice zero in AutoML, le organizzazioni (soprattutto gli analisti aziendali) possono creare comodamente modelli all’avanguardia.

Piattaforma AI: per le organizzazioni che desiderano adottare la scienza dei dati come elemento di differenziazione strategico, Google Cloud offre ai data scientist gli strumenti più sofisticati. Google Cloud supporta tutti i più diffusi framework ML (TensorFlow, PySpark, PyTorch, scikit-learn, ecc.). Inoltre, le aziende possono utilizzare le TPU per costruire modelli complessi della scala di BERT (regolazione di miliardi di parametri) nel giro di poche ore/giorni. In altre parole, questo potrebbe durare settimane e mesi altrove.

BQML: per i team che conoscono bene SQL, BQML, le funzionalità di machine learning integrate di Google Cloud stanno sbloccando il suo potenziale per milioni di analisti di dati perché consente loro di creare e rendere operativi i modelli direttamente da BigQuery, utilizzando un semplice SQL.

Il futuro di MLaaS – collaborazione strategica

Google Cloud ha diversi miglioramenti pianificati in futuro per i servizi ML. La società prevede di estendere la raccomandazione AI oltre la vendita al dettaglio in alcuni degli altri domini come i media e l’intrattenimento. Inoltre, introdurrebbero funzionalità come la formazione per consentire una maggiore personalizzazione dei modelli predefiniti in base ai dati dei clienti.

Di recente, Google Cloud ha lanciato il suo TPU v4 all’avanguardia per i suoi clienti aziendali. Questi chip ad alte prestazioni hanno guidato lo sviluppo dei suoi modelli di linguaggio di grandi dimensioni. Ora è disponibile per i suoi clienti.

I clienti che hanno utilizzato TPU v4 di recente hanno assistito a risultati sorprendenti. Ad esempio, Erik Nijkamp, il ricercatore presso Salesforce, ha affermato che l’accesso a TPU v4 ha consentito loro di ottenere innovazioni nella programmazione dell’IA conversazionale con il loro progetto CodeGen, un modello di linguaggio autoregressivo da 16 miliardi di parametri che trasforma semplici istruzioni in inglese in eseguibili codice.

Ha affermato che l’osservazione empirica determina le grandi dimensioni di questo modello e che il ridimensionamento del numero di parametri del modello proporzionale al numero di campioni di addestramento sembra migliorare le prestazioni del modello. Questo fenomeno è anche noto come “legge di scala”.

“TPU v4 è una piattaforma eccezionale per questo tipo di formazione sull’apprendimento automatico, che offre prestazioni significative rispetto ad altre alternative hardware di intelligenza artificiale comparabili”, ha affermato Nijkamp.

La ricerca LG AI ha recentemente collaborato con Google Cloud per testare TPU v4 prima della commercializzazione. Hanno utilizzato l’ultimo supercomputer di apprendimento automatico di Google per addestrare le capacità multimodali di LG, LG EXAONE, un’intelligenza artificiale super gigante con una scala di 300 miliardi di parametri.

LG EXAONE è stato addestrato con TPU v4 e un’enorme quantità di dati, oltre 600 miliardi di corpus di testo e 250 milioni di immagini – dotate di capacità multimodali – con l’obiettivo di superare gli esperti umani in termini di comunicazione, creatività, produttività e altro. “Non solo le prestazioni di TPU v4 hanno superato le altre architetture di elaborazione migliori della categoria, ma anche il supporto orientato al cliente è andato oltre le nostre aspettative”, ha affermato Kyunghoon Bae, capo della ricerca sull’intelligenza artificiale di LG.

Ingegneria dei dati per il gioco multi-cloud

Google Cloud fornisce tecnologie attraverso intelligenza artificiale, machine learning, analisi e database. È stato determinante nell’aiutare organizzazioni come Exabeam, Deutsche Bank e PayPal ad abbattere i silos, aumentare l’agilità, ricavare più valore dai dati e innovare più velocemente.

Negli ultimi anni, il metodo multi-cloud sta diventando più popolare dell’approccio a cloud singolo perché offre alle organizzazioni flessibilità, capacità e alternative di prezzo notevolmente maggiori. Allo stesso tempo, molte aziende ritengono che un approccio multi-cloud sia un modo per affrontare i problemi principali del cloud computing.

Il multi-cloud è un approccio sempre più popolare; a parte la flessibilità, le capacità e il prezzo, un paio di fattori chiave per l’adozione di un approccio multi-cloud sono la diversificazione del rischio e lo sfruttamento delle migliori capacità offerte da ciascun CSP.

Sebbene sembri una decisione strategica ovvia nella progettazione dell’architettura tecnologica, una nota cautelativa da tenere in considerazione sono le sfide di integrazione e la gravità dei dati che sono inevitabili in qualsiasi cloud in anticipo nella scelta della tecnologia. Questo aiuta a evitare costose riprogettazioni in una fase successiva e aiuta a controllare i costi in uscita che potresti dover sostenere per operare in modo efficace attraverso i cloud.

Al centro di tutto ciò che fanno, il team ritiene che Google abbia sempre avuto l'”apertura” al centro della sua filosofia di progettazione. È fondamentale per il loro DNA, come si vede anche dai loro contributi a fonti aperte come GKE e Tensorflow. Google ha oltre 20.000 progetti e 2 milioni di righe di codice hanno contribuito all’open source. Questa filosofia è stata anche alla base del modo in cui l’azienda ha progettato le sue offerte cloud: prodotti come Anthos, Dataplex, BQ Omni di BigQuery, ecc., sono buoni esempi.

Per chi non lo sapesse, Anthos è progettato per aiutare i team a gestire, orchestrare e governare le proprie app su più cloud. Dataplex consente ai team di governare i dati e creare un repository di metadati centrale indipendentemente dal cloud su cui si trovano i dati. BigQuery, uno dei loro prodotti di analisi di maggior successo, ha recentemente lanciato BQ Omni per fungere da wrapper in grado di eseguire query sui dati indipendentemente dal cloud su cui risiedono.

Google cloud è un provider cloud veramente incentrato sul cliente. L’azienda lavora con la tecnologia e l’architettura dei dati del cliente, indipendentemente dal fatto che utilizzi la tecnologia sottostante di Google Cloud o quella di qualcun altro.