Gli scienziati informatici dei Paesi Bassi e della Spagna hanno determinato come un sistema di deep learning apprende meglio quando è distratto . L’intelligenza artificiale (AI) è finalizzata al riconoscimento delle immagini e può imparare a riconoscere l’ambiente circostante. Il team è stato in grado di semplificare il processo di apprendimento dopo aver forzato il sistema a concentrarsi sulle caratteristiche secondarie.

Reti neurali convoluzionali

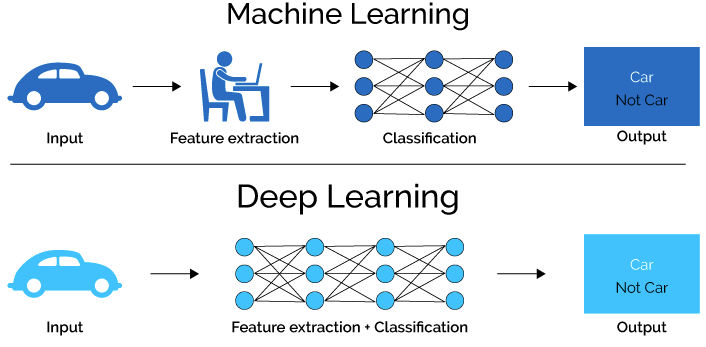

Il sistema di deep learning si basa su reti neurali convoluzionali (CNN), che sono una forma di deep learning per i sistemi di intelligenza artificiale.

Estefanía Talavera Martinez è docente e ricercatrice presso il Bernoulli Institute for Mathematics, Computer Science and Artificial Intelligence dell’Università di Groningen nei Paesi Bassi.

“Queste CNN hanno successo, ma non capiamo appieno come funzionano”, afferma Talavera Martinez.

Talavera Martinez ha utilizzato la CNN per analizzare le immagini provenienti da fotocamere indossabili mentre studiava il comportamento umano. Parte del suo lavoro si è concentrato sullo studio delle interazioni umane con il cibo, quindi ha deciso di fare in modo che il sistema riconosca i diversi ambienti in cui le persone incontrano il cibo.

“Ho notato che il sistema ha commesso errori nella classificazione di alcune immagini e avevo bisogno di sapere perché questo è accaduto”, ha detto.

Ha fatto uso di mappe di calore e ha analizzato quali parti delle immagini sono state utilizzate dalla CNN per identificare l’ambientazione.

“Ciò ha portato all’ipotesi che il sistema non stesse esaminando abbastanza dettagli”, ha detto.

Un esempio è stato quello di un sistema di intelligenza artificiale che ha imparato da solo a usare le tazze per identificare una cucina. In questo esempio, l’intelligenza artificiale potrebbe classificare erroneamente aree come soggiorni e uffici, che spesso hanno anche tazze.

Talavera Martinez e il suo team hanno quindi deciso di sviluppare una soluzione. I suoi colleghi includevano David Morales e Beatriz Remeseiro, entrambi in Spagna. La soluzione proposta era di distrarre il sistema dai suoi obiettivi primari.

Sviluppare la soluzione

Il team ha addestrato la CNN con un set di immagini standard di aerei o automobili e ha identificato quali parti delle immagini sono state utilizzate per la classificazione tramite mappe di calore. Queste parti delle immagini sono state quindi sfocate nel set di immagini e il set di immagini è stato utilizzato per un secondo ciclo di allenamento.

“Questo costringe il sistema a cercare altrove gli identificatori. E usando queste informazioni extra, diventa più fine nella sua classificazione”, ha detto Talavera Martinez.

Il nuovo sistema ha funzionato bene nei set di immagini standard e ha avuto successo nelle immagini raccolte dalle fotocamere indossabili.

“Il nostro regime di allenamento ci dà risultati simili ad altri approcci, ma è molto più semplice e richiede meno tempo di calcolo”, afferma.

I precedenti tentativi di aumentare la classificazione a grana fine si sono concentrati sulla combinazione di diversi insiemi di CNN, ma l’approccio di nuova concezione è molto più leggero.

“Questo studio ci ha dato un’idea migliore di come apprendono queste CNN e questo ci ha aiutato a migliorare il programma di formazione”, ha affermato Talavera Martinez.