Secondo quanto riferito, una spia ha utilizzato un’immagine del profilo generato da AI per connettersi con le fonti su LinkedIn

Un raro esempio di falsi di intelligenza artificiale che imbrogliano le persone allo stato selvatico

Negli ultimi anni, l’aumento dei falsi di IA ha messo molta gente molto preoccupata, con esperti che hanno avvertito che questa tecnologia potrebbe essere usata per diffondere bugie e disinformazione online. Ma le prove concrete di questo avvenimento sono state fin qui sottilissime , motivo per cui un nuovo rapporto della Associated Press offre una lettura così interessante.

L’ AP dice di aver trovato la prova di una che sembra essere una potenziale aspirante utilizzando un’immagine del profilo generato da AI per ingannare i contatti su LinkedIn.

La pubblicazione dice che il profilo falso, dato il nome di Katie Jones, era connesso con un certo numero di esperti di politica a Washington. Questi includevano una sparpagliata di figure governative come un aiutante del senatore, un vice assistente segretario di stato e Paul Winfree, un economista attualmente in attesa di un seggio nella Federal Reserve.

Usare LinkedIn per questo tipo di spionaggio a basso rischio è un fatto comune, con gli Stati Uniti e l’Europa particolarmente preoccupati per le operazioni su larga scala lanciate dalla Cina. Come William Evanina, direttore del Centro nazionale di controspionaggio e sicurezza degli Stati Uniti, ha detto all’AP : “Invece di inviare spie in qualche parcheggio negli Stati Uniti per reclutare un obiettivo, è più efficiente sedersi dietro un computer a Shanghai e inviare richieste di amicizia a 30.000 bersagli. “

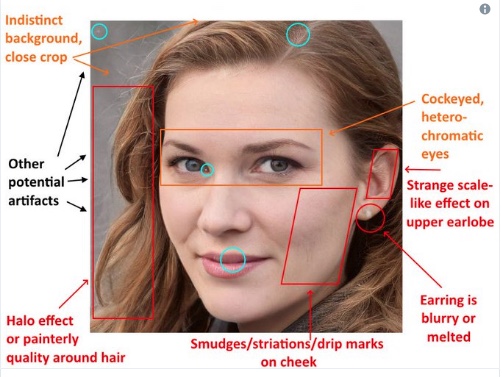

Ma ciò che rende insolito il caso di “Katie Jones” è l’uso di un metodo AI noto come una rete generativa avversaria (o GAN) per creare l’immagine del profilo falso dell’account.

Usare GAN per creare facce false è diventato incredibilmente facile negli ultimi anni, come dimostrato dalla popolarità di siti come ThisPersonDoesNotExist.com . Sebbene le spie che utilizzano LinkedIn potrebbero facilmente catturare immagini di archivio o foto di social media casuali per creare il loro account, utilizzando un falso AI aggiunge un livello di protezione. Poiché ogni immagine è unica, non è possibile risalire a una fonte con una ricerca inversa di immagini per un facile debunking.

E mentre questi falsi sembrano convincenti a colpo d’occhio, si rivelano facilmente quando si osserva un po ‘più vicino. Nel caso di “Katie Jones”, puoi vedere che il viso è leggermente asimmetrico con uno sfondo indistinto. Anche i bordi dei suoi capelli e dell’orecchio sono sfocati e ci sono strane strisce sulla carne. Diversi esperti che l’ AP ha intervistato hanno concluso che l’immagine è stata sicuramente creata utilizzando tecniche di apprendimento automatico.

Un incidente come questo non è la prova, ovviamente, che i falsi AI stanno per distruggere la nostra nozione di verità e prove. Ma mostra che queste preoccupazioni non sono solo teoriche e che questa tecnologia – come qualsiasi altra – lentamente verrà adattata da attori malvagi.

Quando si tratta di spie di LinkedIn, però, il grande pericolo non è in realtà falso di AI, ma semplice disattenzione. Come Paul Winfree, l’economista e aspirante membro del consiglio della Federal Reserve ha dichiarato all’AP : “Sono probabilmente il peggior utente di LinkedIn nella storia di LinkedIn … accetto letteralmente ogni richiesta di amicizia che ottengo.”