Artisti in lotta per il nuovo modello di intelligenza artificiale che può generare opere simili

La diffusione stabile viola la legge sul copyright?

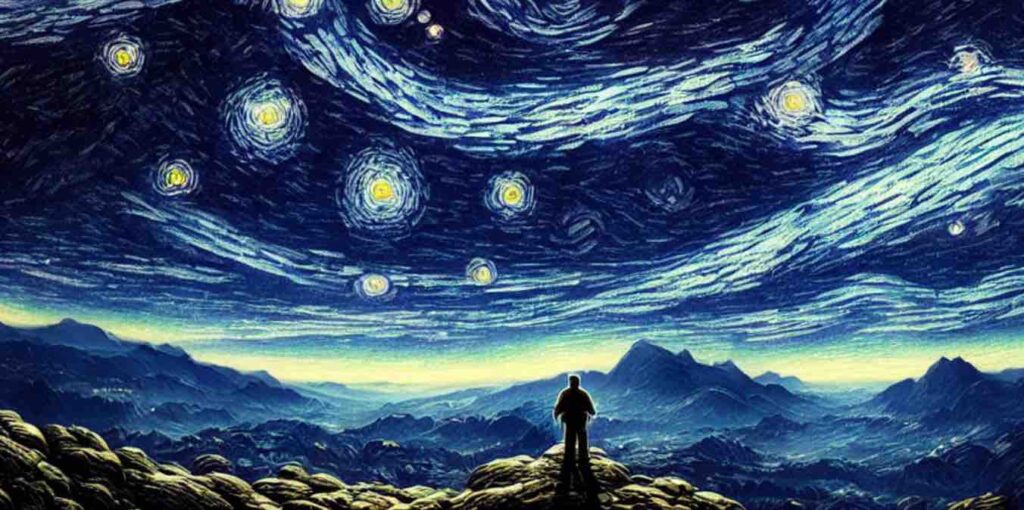

Una nuova controversia si sta formando nel mondo dell’arte, poiché gli artisti tradizionali sono preoccupati per un nuovo modello di intelligenza artificiale chiamato Diffusione stabile. Questo modello, sviluppato dalla startup Stability AI, è addestrato su un set di dati di immagini su scala Internet ed è in grado di generare opere d’arte negli stili di artisti specifici. Alcuni di questi artisti sono legittimamente preoccupati per il loro sostentamento, poiché il modello AI è in grado di creare opere molto simili alle loro.

In effetti, è chiaro da tempo che molti dei nostri lavori saranno sostituiti da macchine intelligenti in futuro. L’abbiamo visto accadere in altri settori, come quello manifatturiero e agricolo. Ma è sorprendente vedere che anche le arti creative non sono immuni da questa tendenza.

Alcuni artisti indignati ora affermano che la diffusione stabile viola il copyright generando opere troppo simili alle loro. Tuttavia, è importante capire che il diritto d’autore protegge un artista solo da qualcun altro che riproduce una delle sue effettive opere d’arte. Non li protegge da qualcun altro che inventa il proprio lavoro nello stesso stile. Quindi, legalmente, va bene che il modello di intelligenza artificiale esamini il lavoro di qualcun altro, assorba i concetti in esso contenuti e quindi applichi quegli stessi concetti, tecniche, colori e stili a argomenti simili per creare opere originali.

In altre parole, come artista, dovresti sapere che il copyright ti protegge solo da qualcun altro che riproduce una delle tue effettive opere d’arte , non da qualcun altro che inventa il proprio lavoro nello stesso stile.

Il fatto che il risultato sia una copia dipende dal fatto che ciò che viene preso dall’opera originale sia una “parte sostanziale” o meno. Stable Diffusion potrebbe copiare una parte sostanziale di un’opera d’arte specifica?

Sebbene in teoria sia possibile un “overfitting”, in cui i modelli di intelligenza artificiale memorizzano parte del loro set di allenamento, il buon senso, supportato dall’esperienza nel mondo reale con questo strumento, concorda sul fatto che la diffusione stabile e altri modelli di intelligenza artificiale contemporanei come DALL-E e Midjourny sono nonin grado di memorizzare sostanzialmente opere d’arte. In effetti, la dimensione del modello di diffusione stabile è solo di un paio di gigabyte, mentre è addestrato su centinaia di terabyte di immagini sorgente. Nelle parole del CEO e fondatore di Stability AI Emad Mostaque, questa è l’immagine collettiva dell’umanità compressa in file grandi pochi gigabyte. Questa compressione immensamente con perdite dall’immagine sorgente al modello, che riduce il volume dei dati di almeno quattro ordini di grandezza, implica che la probabilità di una diffusione stabile memorizzando fedelmente parti “sostanziali” di specifiche opere d’arte è estremamente ridotta.

Dal punto di vista degli artisti, questo è uno sviluppo preoccupante. I loro mezzi di sussistenza dipendono dalla loro capacità di creare opere originali e, se l’IA è in grado di generare opere simili, potrebbe svalutare il loro lavoro. Se un artista propone uno stile nuovo e unico, è solo questione di tempo prima che un modello di intelligenza artificiale possa imparare a generare opere in quello stile altrettanto bene, se non meglio.

Gli artisti sono importanti per la società, poiché ci aiutano a vedere il mondo in modi nuovi e diversi. Ci aiutano a comprendere le nostre emozioni e ad entrare in empatia con gli altri. Se perdiamo l’incentivo economico per creare opere d’arte originali, sarà una grande perdita per l’umanità.

Da questo punto di vista, è possibile che in futuro potremmo aver bisogno di apportare alcune modifiche alla legge sul copyright per proteggere gli artisti da questa nuova minaccia. Quali potrebbero essere questi cambiamenti, tuttavia, è ancora in discussione.