L’azienda di videoconferenza Touchcast utilizza l’intelligenza artificiale per aggiungere contesto alle conversazioni

La videoconferenza sta diventando sempre più una merce in quanto giganti della tecnologia come Microsoft e Google incorporano la funzionalità nei loro servizi gratuiti. Touchcast sta rimanendo un passo avanti ai giganti innovando sui servizi basati sull’intelligenza artificiale per gli utenti premium.

Gli effetti speciali sono importanti, ma la chiave di differenziazione sta nella creazione di più contesto per guidare la prossima ondata di comunicazione, ha detto a VentureBeat il CEO di Touchcast Edo Segal. Touchcast lo fa sfruttando Nvidia Maxine , un kit di sviluppo software per la creazione di applicazioni basate su GPU. L’SDK include varie primitive per cose come la rimozione dello sfondo alimentata dall’intelligenza artificiale, la simulazione del contatto visivo e la misurazione della posa del corpo nello sport.

“Il fatto che un’azienda come Nvidia, leader nell’hardware di alimentazione dell’IA, abbia la lungimiranza di investire nella ricerca e sviluppo dal punto di vista concettuale e software aiuta le aziende come Touchcast ad accelerare il time to market e concentrarsi sulla costruzione sulle spalle dei giganti, “Ha detto Segal.

Nvidia Maxine stabilisce una nuova base di funzionalità da cui innovare. “Ci permette di concentrarci su altre aree in cui non c’è ancora lavoro da fare mentre tracciamo questa frontiera”, ha detto Segal.

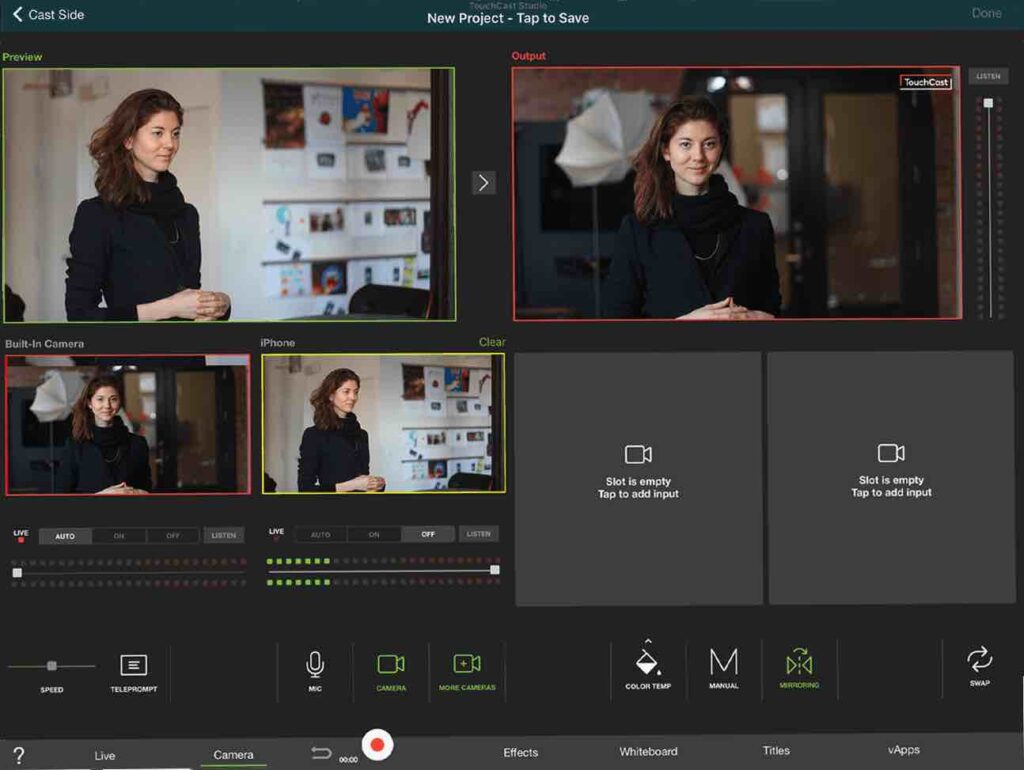

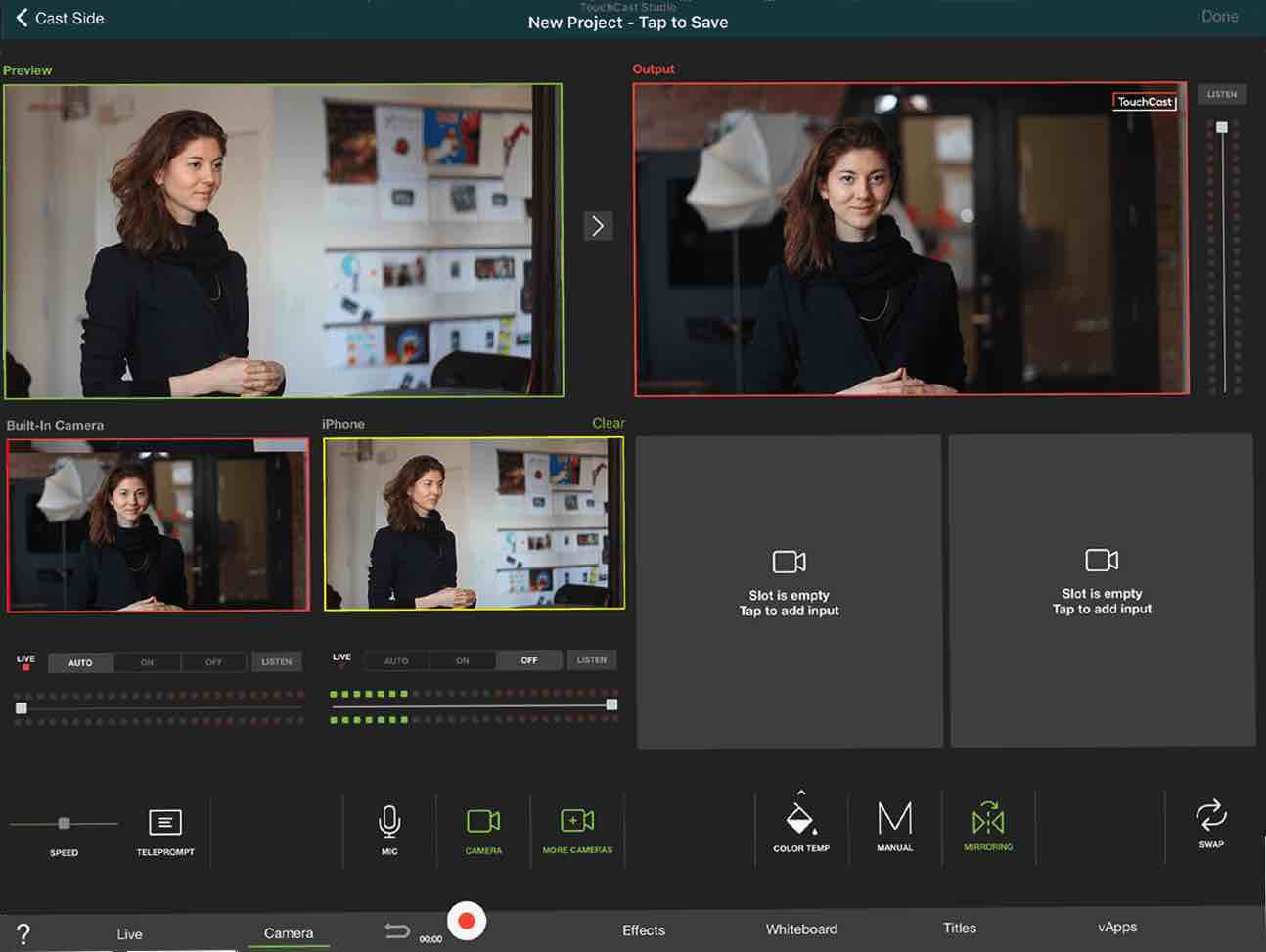

Migliori effetti di immagine

Un grande obiettivo è ridurre lo sforzo necessario per creare eventi di qualità. I presentatori dal vivo possono essere teletrasportati virtualmente in set di realtà mista senza uno schermo verde. La segmentazione semantica live utilizza l’intelligenza artificiale per separare una persona dallo sfondo in alta qualità, consentendo di posizionare automaticamente le persone in un set di realtà mista. “Questo letteralmente richiedeva giorni o settimane di lavoro e rendering e ora viene eseguito dal vivo”, ha detto Segal.

L’upscaling neurale può pulire un’immagine di base della webcam e ridimensionarla su uno schermo 4K ultra HD. Funziona in modo simile a un artista a cui viene chiesto di dipingere un murale da una piccola immagine intuendo come potrebbero riempire le parti mancanti. Un’altra nuova funzionalità chiamata inquadratura automatica può mantenere un altoparlante centrato nella vista anche quando si muove.

L’età dell’inferenza

Le parole possono essere trascritte, tradotte e duplicate automaticamente in più lingue. Maxine permette che tutto ciò avvenga in una frazione di secondo in modo che l’audio appaia sincronizzato con l’altoparlante. Un’altra nuova funzionalità è la possibilità di suddividere un video e organizzarlo meglio con riepiloghi, sommario e articoli in forma abbreviata. Un discorso può essere suddiviso per temi e avere titoli e descrizioni generati dalla macchina per ogni sezione.

“L’umanità ha perso da tempo la sua capacità di impegnarsi in contenuti di lunga durata e, creando questa visualizzazione dell’articolo AI, permettiamo allo spettatore di scorrere rapidamente il contenuto nello stesso modo in cui potresti fare con un post sul blog”, ha detto Segal.

Segal è anche entusiasta del potenziale della ricerca semantica vettoriale per contribuire a portare un nuovo contesto alla scoperta dei contenuti. “Riteniamo che la prossima generazione di ricerca e scoperta si evolverà in flussi di informazioni ambientali contestualizzati all’attività che stai eseguendo”, ha affermato. Ha lavorato su questo problema per decenni e ne ha scritto nel 2009.

La ricerca semantica vettoriale funziona più come il sistema di memoria associativa umana piuttosto che come le tradizionali ricerche di parole chiave booleane. Inizia traducendo il contenuto in concetti in uno spazio multidimensionale in modo tale che i concetti strettamente correlati siano rappresentati più vicini gli uni agli altri.

La videoconferenza è un mercato affollato, ma Segal crede che stia ancora crescendo perché anche l’idea di cosa costituisca una piattaforma di comunicazione è in espansione. I progressi precedenti si sono concentrati su algoritmi di compressione e riduzione del rumore migliori, ma non hanno fatto molto per aiutare le persone a dare un senso al materiale comunicato. Segal è entusiasta delle funzionalità che non sono facili da vedere ma che aiutano a rendere le informazioni più accessibili, come il modo in cui le reti neurali possono aggiungere immediatamente contesto e curare ciò che comunichiamo per rendere le informazioni migliori e più pertinenti.

Queste innovazioni introdurranno “l’era delle inferenze” che potrebbe aumentare la comprensione, l’accessibilità e la comprensione, ha affermato Segal.