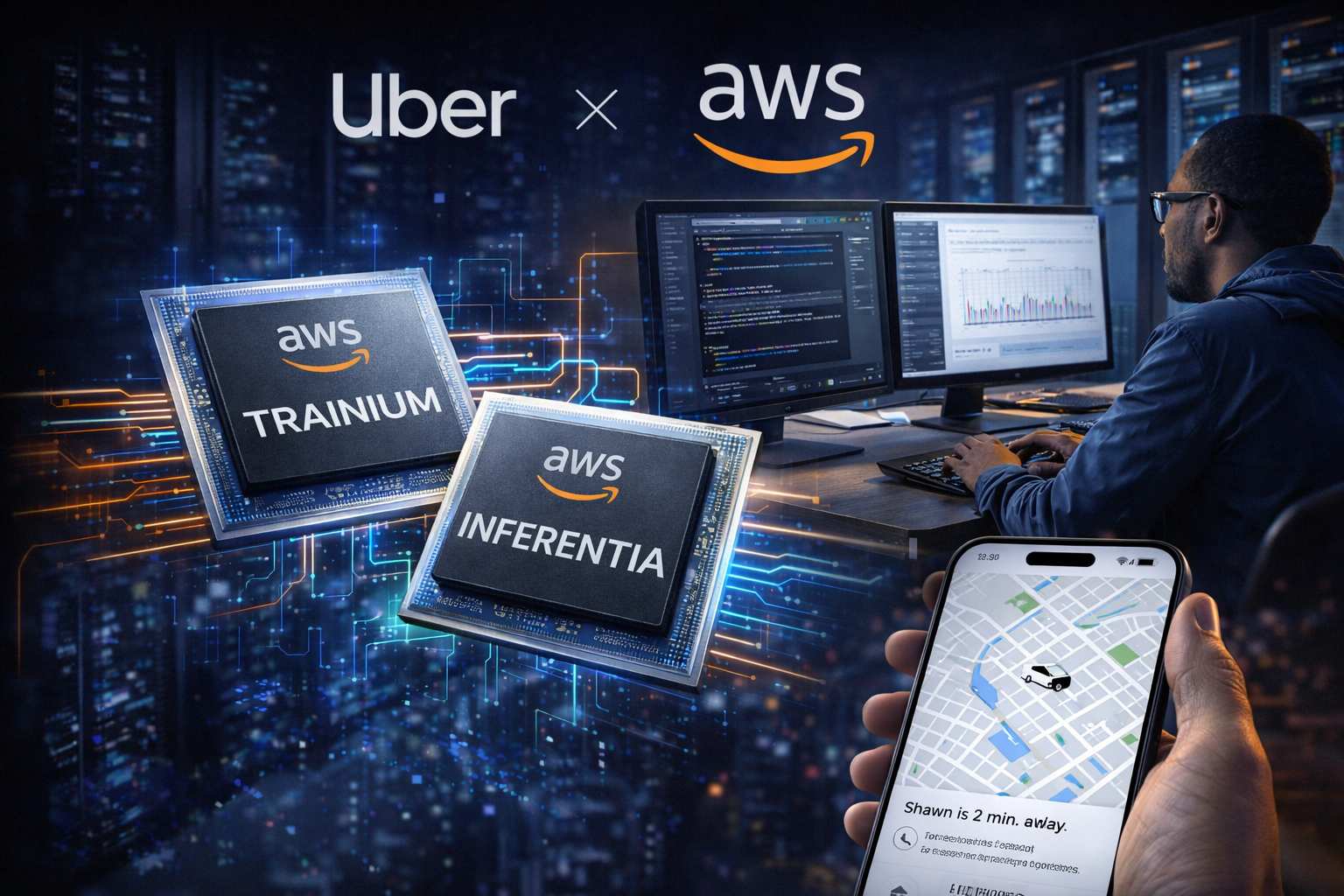

La collaborazione strategica tra Uber e Amazon Web Services segna un passaggio fondamentale nell’ottimizzazione delle operazioni su larga scala attraverso l’adozione di silicio personalizzato per carichi di lavoro ad alta intensità computazionale. Uber ha deciso di migrare una parte significativa delle proprie capacità di elaborazione dei viaggi e di addestramento dei modelli di intelligenza artificiale sui chip AWS Trainium e AWS Inferentia. Questa scelta non risponde solo a una necessità di riduzione dei costi operativi, ma si inserisce in una visione tecnica precisa che punta a massimizzare l’efficienza energetica e la velocità di inferenza in un ecosistema dove ogni millisecondo può influenzare la logistica di milioni di spostamenti globali.

L’architettura di AWS Trainium è stata progettata specificamente per l’addestramento di modelli di deep learning complessi, offrendo un’alternativa ad alte prestazioni rispetto alle GPU tradizionali. Per Uber, questo si traduce nella possibilità di addestrare i propri algoritmi di previsione della domanda e di ottimizzazione dei percorsi con una scalabilità superiore, sfruttando l’interconnessione ad alta velocità tra i nodi di calcolo. La natura specifica di questi chip permette di gestire set di dati massivi riducendo i tempi di iterazione dei modelli, un fattore critico per un’azienda che deve costantemente aggiornare le proprie logiche di mercato in base a variabili dinamiche come il traffico, il meteo e la disponibilità dei conducenti.

Parallelamente, l’impiego dei chip AWS Inferentia si focalizza sulla fase di distribuzione dei modelli, ovvero il momento in cui l’intelligenza artificiale deve rispondere in tempo reale alle richieste degli utenti. L’elaborazione dei viaggi richiede una latenza estremamente bassa per garantire che il calcolo del prezzo e l’abbinamento tra passeggero e veicolo avvengano istantaneamente. Inferentia è ottimizzato per carichi di lavoro di inferenza ad alto throughput, permettendo a Uber di gestire volumi di richieste simultanee senza compromettere la stabilità del servizio, mantenendo al contempo un costo per inferenza sensibilmente inferiore rispetto alle istanze basate su processori general-purpose.

Il passaggio al silicio di AWS rappresenta inoltre un’evoluzione nel modo in cui Uber gestisce il proprio stack tecnologico nel cloud. Integrando i chip personalizzati di Amazon, l’azienda può sfruttare il framework Neuron, che facilita la compilazione e l’ottimizzazione dei modelli esistenti sviluppati in PyTorch o TensorFlow per le architetture Trainium e Inferentia. Questo strato software permette una transizione fluida dei carichi di lavoro senza richiedere una riscrittura completa degli algoritmi, garantendo che l’innovazione ingegneristica possa procedere senza ostacoli strutturali, migliorando al contempo l’impatto ambientale delle operazioni digitali grazie al miglior rapporto tra prestazioni e watt consumati offerto dai chip dedicati.